Por favor, dale me gusta, comparte, comenta y suscríbete. Ayuda a hacer crecer el boletín sin que te cueste dinero. Gracias por leer.

En la Parte I, argumenté que la IA ya puede hacer investigación en ciencias sociales mejor que la mayoría de los profesores. En la Parte II, respondí a más de mil reacciones, concediendo donde los críticos tenían razón, pero sin ceder en mi argumento central: el statu quo académico ya estaba roto, y la IA simplemente está forzando el ajuste de cuentas.1 En esta Parte III, escrita en colaboración con IA y colegas durante el último mes, paso del diagnóstico a lo que los académicos pueden y no pueden hacer al respecto.

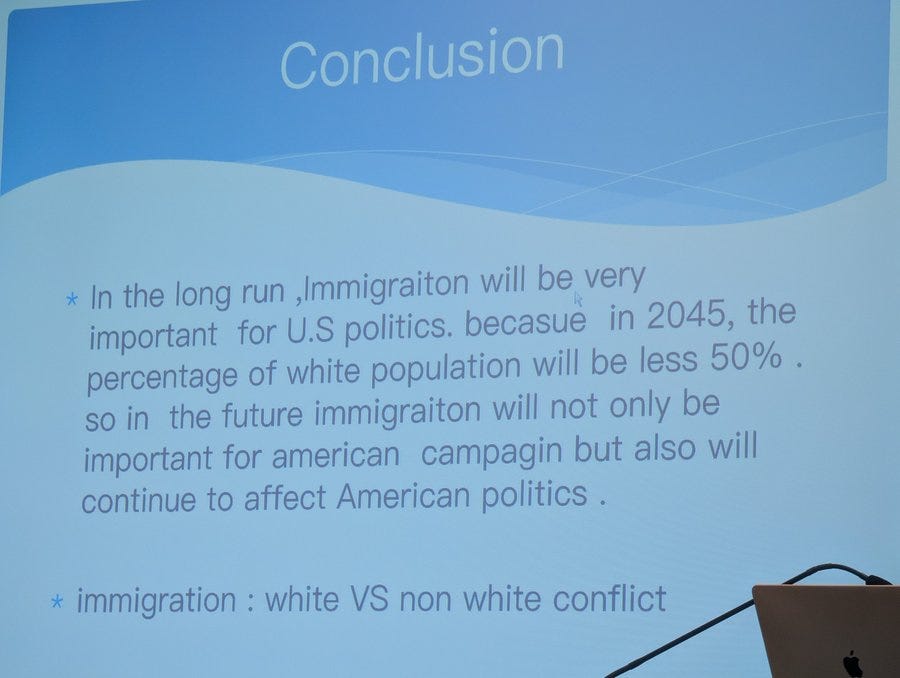

La causa próxima, bastante improbable, de esta tercera entrega sobre IA fue visitar la Convención Anual 2026 de la International Studies Association (ISA) en Columbus, Ohio — una conferencia multidisciplinaria de primer nivel que reúne a los principales profesionales de los estudios internacionales del mundo. O eso me dijeron. Lo que realmente presencié fueron presentaciones tan precarias que apenas habrían obtenido una nota aprobatoria en cualquiera de mis clases: argumentos sin tesis ni coherencia, errores gramaticales que cualquier corrector ortográfico detectaría, ponentes leyendo sus diapositivas como si encontraran sus propios argumentos deficientes por primera vez. Todo sin ninguna participación de IA, a juzgar por la presencia de errores tipográficos e inconsistencias. No eran solo estudiantes de posgrado; eran personas con doctorado, titularidad y presupuestos de investigación.

Si el slop de la IA es la crisis de la que todos advierten, me gustaría saber cómo llamar a lo que vi en ISA o en la mayoría de las grandes conferencias de ciencias sociales.2 El contraste era imposible de ignorar: estaba sentado escuchando esas presentaciones en el preciso momento en que recibía amenazas de muerte y llamados a despedirme en línea por sugerir que la IA puede hacer investigación mejor que la mayoría de los profesores. Esa yuxtaposición cristalizó el argumento de este artículo.

21. La mayor parte del “slop” siempre ha sido y sigue siendo slop humano.

Mi primera tesis fue lo más provocador que he dicho, y la he ajustado solo ligeramente desde entonces: la IA agéntica ya puede realizar la mayoría de las tareas de investigación en ciencias sociales mejor que la mayoría de los profesores a nivel global. Sigo manteniéndola. En mi reciente entrevista con el Chronicle, lo formularon de forma más directa: “AI Is a Better Researcher Than You.” Si todavía no lo crees, hablemos en unos años.

Pero la otra cara es igual de importante. Si la IA puede producir resultados de investigación mejores que los profesores, eso también es un juicio condenatorio sobre lo que esos profesores producían y siguen produciendo sin IA.

“Slop” fue la palabra del año 2025 de Merriam-Webster, definida como contenido digital de baja calidad producido por IA. Pero la conferencia de ISA fue un recordatorio de que la gran mayoría del slop siempre ha sido slop humano. El sistema de revistas académicas y las grandes conferencias en gran parte de las humanidades y las ciencias sociales fueron fábricas de slop mucho antes de que alguien tuviera una suscripción a ChatGPT. Sí, lo digo en serio: la mayor parte de la investigación es slop.3

Parte de ella es también lo que el filósofo Harry Frankfurt llamaría “bullshit”: trabajo indiferente a si sus afirmaciones son verdaderas, especialmente en temas políticamente cargados como la inmigración, donde los investigadores parten de la conclusión de izquierda y trabajan hacia atrás. Pero el slop va más allá del bullshit. Incluye también trabajos que no afirman nada, trabajos que pretenden tener valor artesanal y simplemente fracasan. El investigador que encuentra un conjunto de datos antes de tener una pregunta y luego busca resultados significativos dignos de publicar está produciendo slop. Estos investigadores existían mucho antes de la IA. Solo que eran más lentos.

22. Los académicos alucinaban y hacían trampa antes de la IA.

Las preocupaciones sobre la alucinación y el fraude que la gente plantea respecto a la IA en el ámbito académico describen problemas que la preceden por décadas, si no por siglos. Un enorme proyecto publicado en Nature este mes (del que fui una pequeña parte) puso a prueba cientos de artículos de ciencias sociales: solo cerca de la mitad de las afirmaciones estadísticamente significativas se replicaron, y los tamaños del efecto medianos se redujeron drásticamente. Este estudio confirma lo que el estudio de la Open Science Collaboration de 2015 encontró en psicología, donde aproximadamente dos tercios de los hallazgos no se replicaron, y lo extiende a otros campos.

No llamábamos “alucinaciones” a eso antes de la IA. Lo llamábamos “ciencia”. Si se piensa bien, la alucinación y la inspiración no son tan diferentes como parecen. Ambas implican generar combinaciones que van más allá del insumo. Lo llamamos alucinación cuando el resultado es erróneo y un avance cuando es correcto.

Mientras tanto, los académicos citan rutinariamente artículos que no han leído más allá del resumen.4 Al menos las tasas de alucinación de la IA se rastrean y mejoran. Las tasas de alucinación humana en el ámbito académico no se rastrean en absoluto. Simplemente las llamamos “contribuciones a la literatura”. Y si eres evaluador de pares, ni siquiera tienes que alucinar por tu cuenta: basta con escribir “por favor, cíteme” y seguir adelante.

Hay investigación genuinamente excelente. Pero antes de preocuparnos por el fraude asistido por IA, reflexionemos un momento sobre el fraude humano. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely: la lista de casos de fraude de alto perfil no para de crecer, y estos son solo quienes fueron descubiertos. Más allá de la fabricación directa, el p-hacking, el HARKing (formular hipótesis después de conocer los resultados) y la presentación selectiva de datos fueron durante años tan comunes que apenas se consideraban mala conducta. Hemos avanzado en la comprensión de estas prácticas, pero siguen siendo lo suficientemente frecuentes como para influir en lo que se publica. Y más allá de todo esto, los profesores titulares siempre han puesto su nombre en artículos escritos principalmente por estudiantes de doctorado, y libros enteros han sido ensamblados por equipos de asistentes de investigación bajo el nombre de un académico famoso. Nada de esto se consideraba trampa hasta que la IA hizo el proceso más barato y más visible.

23. La metáfora del “loro estocástico” describe mejor a los humanos que a la IA.

Uno de los eslóganes más influyentes en el debate sobre la IA5 siempre ha funcionado como un cliché que cierra el pensamiento. Como señaló Cate Hall en esta publicación, es una acuñación poderosa: agradable de pronunciar, conceptualmente eficiente, y ha colonizado permanentemente la mente de muchas personas pese a no ser cierta para los modelos actuales. Una auténtica obra de arte lingüística. También es empíricamente falsa: todos los grandes modelos de frontera desde GPT-4 han sido entrenados con entradas no textuales, y la lógica del argumento original requiere entrenamiento exclusivamente con texto para funcionar.

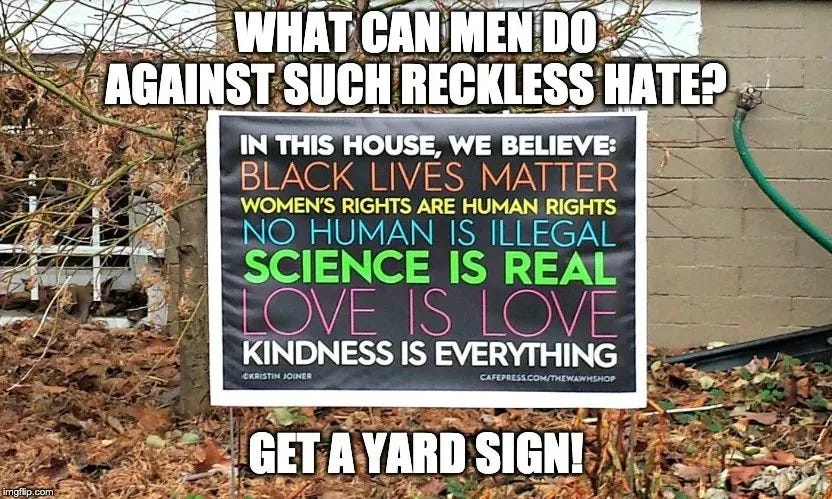

Ahora considera algo completamente diferente pero aún muy familiar: los carteles de jardín “In This House We Believe”. Science Is Real. Love Is Love. No Human Is Illegal, etc. Puedes creer cada línea y aun así no tener ninguna postura política coherente sobre ninguno de estos temas. ¿Qué implica “no human is illegal” para la política de control migratorio: fronteras abiertas, amnistía, algo más? El cartel no lo dice, porque decirlo requeriría confrontar contradicciones. Es un juramento de lealtad, no un argumento.

La gente se ha burlado de este cartel durante años.

Pero el punto más profundo es que eso es exactamente lo que se le critica a la IA: producir declaraciones superficiales y reconfortantes que comunican pertenencia en lugar de significado. Resulta que los humanos llevan haciendo eso con o sin IA desde que tenemos jardines donde poner carteles.

El cartel de jardín no es una excepción. Es como la mayoría de las personas parecen relacionarse con la mayoría de los temas: adoptar la posición del grupo, repetirla y seguir adelante. El contenido de lo que se argumenta importa mucho más que la forma en que se enmarca, pero enmarcar es más fácil, y por eso domina el discurso público, desde los hilos de Twitter hasta las presentaciones en conferencias.

Lo viví de primera mano en ISA, donde colegas con titularidad presentaron trabajos que equivalían al equivalente académico de un cartel de jardín, con algunas regresiones mal identificadas para darle apariencia de ciencia. La crítica del loro estocástico pretendía disminuir a la IA. Terminó siendo una descripción más acertada de la vida intelectual humana de lo que nadie pretendía.

24. Sí, los adultos con pleno consentimiento pueden usar IA para escribir. Prohibirlo no funciona.

En la Parte II señalé que los detectores de IA a menudo no son muy útiles y crean más problemas de los que resuelven. Pero el problema más profundo es el impulso detrás de ellos: la creencia de que la participación de la IA es inherentemente contaminante, independientemente de lo que produzca. Quinn Que presenta un caso fascinante de que la obsesión con los detectores de escritura de IA es análoga a aplicar la “regla de una gota de sangre”, el principio de la clasificación racial estadounidense del siglo XIX: cualquier rastro de IA contamina la obra completa, independientemente de su calidad o la intención del autor.

Al principio era escéptico de la analogía, pero es bastante acertada. En la visión del activista anti-IA, cualquier palabra que no hayas escrito tú mismo es una polución moral. Aunque usar IA para escribir no es técnicamente “ilegal”, existe básicamente una regla de una gota que determina si eres un escritor legítimo o un fraude, una buena persona o una mala. De ahí las condenas y las amenazas de muerte hacia personas como yo que divulgamos nuestro uso de IA por “externalizar nuestro pensamiento a la máquina”.

Como argumenté en la Parte I, gran parte de la oposición a la IA es protección de estatus disfrazada de principio. Andy Masley va más lejos y argumenta que el pánico moral en torno a los chatbots puede tener una fuente más allá del proyecto de estatus: algo más cercano a la superstición (“los chatbots son demoníacos”), la sensación de que el texto producido por IA está espiritualmente contaminado, de que hay algo malo o incluso malvado en una máquina que puede escribir, independientemente de lo que escriba.6

Incluso Megan McArdle, que recientemente declaró con honestidad su uso de IA y desencadenó entre los periodistas la misma conversación que los académicos habían tenido en Bluesky unos meses antes, se sintió obligada a defenderse insistiendo en que “la IA no tocó el texto final”. La admiro por haber alzado la voz. Pero ¿por qué tendría que ser siquiera un problema la cuestión del texto final? Si el trabajo es bueno y el proceso se divulga, lo demás es preferencia estética disfrazada de ética. ¿Dónde empieza la impureza? ¿En Google? ¿En el autocorrector? ¿En el corrector ortográfico? ¿En las transcripciones?

Y dejando todo eso de lado: salvo un escenario al estilo Dune de una catástrofe de IA seguida de que la humanidad se coordine para prohibir la tecnología, la escritura de no ficción ampliamente asistida por IA es casi inevitable en equilibrio, dados los incentivos existentes. La otra cara que vale la pena mencionar es que, aunque logres escribir bien enteramente por tu cuenta sin “contaminación de IA”, tampoco vas a recibir ninguna recompensa por esa pureza muy pronto.

25. No usar las últimas herramientas de IA en tu investigación y escritura es negligencia profesional.

Matthew Yglesias argumentó recientemente que los grandes modelos de lenguaje están infrautilizados en el periodismo. Su argumento aplica igualmente a los académicos: el propósito de la investigación es el resultado útil, no el proceso mediado por humanos. El rigor debe estar en el pensamiento y la verificación, no en si un humano o una máquina escribió las oraciones o presionó enter al ejecutar las regresiones en R. Como bien lo expresó Hollis Robbins, los profesores probablemente deberían estar probando modelos de IA antes del desayuno (básicamente ser como Scott Cunningham).

El uso más mundano de la IA es detectar errores. Considera el titular del New York Times del 3 de abril de 2026: “A North American Treaty Organization Without America?” El nombre correcto es, por supuesto, la North Atlantic Treaty Organization. El Times publicó una corrección al día siguiente. Algunos especularon que el error lo causó la IA. Nunca lo sabremos y, francamente, no importa. Cualquier flujo de trabajo con un LLM suficientemente inteligente habría detectado el error en segundos. Una rutina automática sencilla para todos los titulares — “¿Contiene algún error? Verifica contra dos fuentes independientes” — le habría ahorrado al Times un ciclo noticioso de vergüenza.

Pero la verificación de hechos es el piso, no el techo. El uso más interesante es hacer cosas que antes no eran posibles. Mi ahora coautora, Kelsey Piper, recientemente le pidió a Codex que construyera un sitio web interactivo para ayudarla a entender de verdad un artículo de ciencia política que estaba reseñando, y luego realizó ella misma la tarea de la manera en que lo habían hecho los participantes del estudio. La IA no solo comprime el tiempo que lleva producir un resultado. Reduce el costo del tipo de participación activa que la mayoría de los investigadores omiten: construir la cosa uno mismo, someter a prueba de estrés un argumento, reejecutar un análisis tal como lo hicieron los participantes. Eso es lo que requiere la comprensión profunda.

Lo mismo aplica en el ámbito académico. La mitad de las presentaciones de ISA que presencié en Columbus podrían haberse mejorado significativamente con una pasada rápida por ChatGPT: revisar gramática, afinar argumentos, detectar vacíos lógicos. Estas herramientas son gratuitas o casi gratuitas. Elegir no usarlas es optar por entregar un trabajo peor del que se es capaz, especialmente si la vocación es informar al público. Pero tanto los periodistas como los académicos no deberían usar la IA solo para corregir errores tipográficos en titulares. Deberían usarla para construir visualizaciones interactivas, someter argumentos a prueba de estrés y comprender de verdad los temas complejos sobre los que escriben.

¿Pero qué hay de la escritura en sí? Quizás hayas visto una respuesta común ante cualquiera que use IA en su escritura: “¿Por qué debería leer el artículo y no el prompt que lo generó?” Suena razonable, ¿verdad? Pues no, si lo piensas un poco.

¿Por qué comer la comida en lugar de leer la lista de compras? ¿Por qué ver un gráfico en lugar del script de ggplot? ¿Por qué leer el libro en lugar de las notas del autor? El prompt no te da ningún conocimiento nuevo. El resultado sí. Ese es precisamente el punto. Como argumenté en la Parte II, personas diferentes con distintas experiencias, datos y contexto (manifestados en sus archivos claude.md) producen resultados completamente distintos a partir del mismo prompt. Es una cuestión de habilidad.

Lo entiendo: puede resultar extraño dedicar más tiempo a leer algo de lo que el autor dedicó a producirlo. Pero ya hemos estado aquí antes. Un gráfico que tardó segundos en generarse en R puede llevar minutos leer con atención. Nadie exige ni fantasea con ver solo el código en lugar del gráfico. Evalúan el gráfico y lo que dice — el nuevo conocimiento que antes no existía.

26. Los LLM pueden, en efecto, producir conocimiento nuevo.

Como documentó recientemente John Burn-Murdoch, los chatbots de IA orientan de forma consistente a los usuarios hacia el consenso de los expertos, lo opuesto de lo que hacen las redes sociales. Las herramientas no solo te ayudan a escribir mejor. Usadas activamente, te ayudan a pensar con más cuidado.7 De este modo, los LLM podrían incluso revertir el auge del populismo. Pero verificar hechos no es lo mismo que producir conocimiento nuevo.

Antes de preguntarnos si los LLM pueden producir ideas genuinamente nuevas (hay buenos ejemplos de ello), deberíamos preguntarnos cuántos humanos lo hacen. La mayoría de los académicos pasan sus carreras recombinando ideas existentes en variaciones menores, aplicando los mismos métodos a conjuntos de datos ligeramente distintos, produciendo trabajo incremental que nadie fuera de su subdisciplina leerá jamás. El pensamiento original es extraordinariamente difícil y escaso en cualquier generación. No lo digo como insulto a ninguno de mis colegas (ni a mí mismo). Pero el listón que los LLM necesitan superar es más bajo de lo que nos gusta admitir.8

Mi amigo Robert Kubinec, brillante metodólogo político y autor de ficción publicado9 en la Universidad de Carolina del Sur, parece ser bastante escéptico sobre gran parte del entusiasmo por la IA. Argumenta que “los LLM nunca crean conocimiento, que solo existe en los cerebros humanos. Solo pueden comparar un conjunto de conocimiento con otro.” Respeto a Bob, así que está bien que no estemos de acuerdo. Mi respuesta: la pregunta filosófica sobre la autoconciencia es real, pero es ortogonal a la práctica. Independientemente de si el modelo “comprende” algo, el resultado o contiene información nueva útil para los humanos o no.10

El ejemplo más sugerente reciente es Claude Mythos, el nuevo modelo de frontera de Anthropic. En pocas semanas de pruebas, identificó miles de vulnerabilidades de seguridad previamente desconocidas en los principales sistemas operativos y navegadores, incluida una que había pasado inadvertida durante 27 años. Llámalo como quieras, pero “comparar un conjunto de conocimiento con otro” no alcanza a describirlo.

Las mejores teorías conceptuales en ciencias sociales ya son recombinaciones de ideas existentes. Anthony Downs construyó su teoría de la elección racional trasplantando la maximización de la utilidad microeconómica a la política y literalmente llamó a su libro An Economic Theory of Democracy. Baumgartner y Jones tomaron prestado el equilibrio puntuado de la biología evolutiva y lo aplicaron a la elaboración de políticas. El análisis de redes sociales importó en bloque la teoría de grafos de las matemáticas. Axelrod fusionó el dilema del prisionero con la selección de aptitud evolutiva. Alexander Wendt fue más lejos y aplicó la teoría cuántica a las relaciones internacionales en Quantum Mind and Social Science — un movimiento que muchos encontraron (con razón) ridículo, pero que Cambridge University Press publicó de todas formas. Las ciencias sociales raramente inventan desde cero. Traducen entre dominios, y la traducción es la contribución teórica.

Eso es estructuralmente idéntico a lo que hacen los LLM: recombinar patrones y conceptos entre contextos. A veces el resultado es una tontería. A veces es productivo. Lo mismo ocurre con la recombinación humana. La RI cuántica de Wendt ha sido criticada como una mera metáfora que se hace pasar por física, pero como mencioné antes, Cambridge University Press la publicó. Si eso cuenta como producción de conocimiento, es difícil ver por qué las recombinaciones generadas por LLM no lo serían.

Para su crédito, Bob concedió el punto práctico incluso manteniendo el filosófico: “la pregunta es cómo usar esta capacidad para avanzar el conocimiento.” Exactamente. Como dije en la Parte I: dejen de debatir si los LLM “verdaderamente comprenden” mientras las personas con más en juego ya están usando las herramientas para mejorar su trabajo.

27. Para los críticos, el modelo mental del usuario de IA sigue anclado en 2023, que ya es una eternidad.

Recordemos cómo llegamos a este punto. Los estudiantes se entusiasmaron con el uso de IA antes que sus profesores, usando los primeros modelos públicos y gratuitos como ChatGPT 3.5. El resultado es que muchos profesores e intelectuales todavía imaginan al usuario típico de IA como un estudiante universitario que intenta hacer trampa en un ensayo, o como un asistente que falla al entregar slop generado por IA. Eso quizás siga describiendo gran parte del uso casual de IA en el mundo. No describe cómo los mejores investigadores en la mayoría de los campos están trabajando con estas herramientas, ni cómo opera en realidad cualquiera que intente usar la IA de manera responsable y reflexiva.

Stefan Schubert señaló esto mejor que nadie: subestimamos la racionalidad de los demás, suponiendo que aplican las nuevas herramientas de forma mucho más irreflexiva de lo que realmente lo hacen. Hay un vasto espacio entre pedirle a ChatGPT que escriba un artículo completo y escribir cada palabra uno mismo. Cuando escribes “tú mismo”, ya estás usando atajos. No investigas en profundidad cada referencia que haces. Buscas una estadística en Google y confías en el número del titular. Hojeas un resumen y citas el artículo. Si tienes recursos, externalizas la verificación a un asistente de investigación o a un verificador de hechos. La IA te permite hacer gran parte de esto de manera más sistemática, automatizada y económica.

Como muchos, Derek Thompson cree con razón que escribir es pensar y que externalizar el proceso completo de escritura a la IA deja la mente vacía. Pero, si bien mucha escritura es pensamiento, pensar no es solo escribir. Hacer arte es pensar. Hablar también es pensar. Como argumenta Dina Pisareva, hacer prompts también es pensar, si tienes un buen interlocutor socrático al otro lado del intercambio.

Thompson también reconoce que toda escritura siempre ha implicado recurrir a ideas, datos, edición y verificación de hechos exteriores al escritor. La línea entre asistencia legítima e internalización ilegítima siempre ha sido borrosa, y la IA no creó esa borrosidad. Solo hizo imposible ignorarla. La conclusión del propio Thompson: “Deberíamos ser honestos y abiertos sobre esa borrosidad en lugar de declarar que todo el que tiene una ventana de Claude abierta forma parte de la slopclass.”

¿Dónde deja eso a la divulgación? Muchas buenas personas y las mejores revistas académicas proponen la divulgación completa del uso de IA como solución. Pero la divulgación no es sostenible en términos de teoría de juegos: quienes divulgan cargan con costos reputacionales mientras que los usuarios secretos se aprovechan sin costo alguno, por lo que el equilibrio empuja hacia la no divulgación. Personas como Megan McArdle y yo somos prueba viviente de este problema. Y el mejor encuadre, como lo plantea Ryan Briggs, es que la IA complementa la experiencia: asistentes de investigación automatizados que revisan tu trabajo, formalizan argumentos sobre la marcha y recopilan datos a demanda. Es un multiplicador que permite a las personas capaces pensar mejor y más rápido.

Mi intuición es que el único caso en que la divulgación es genuinamente debida es cuando la audiencia tiene una expectativa razonable de un trabajo producido enteramente por humanos, y esa expectativa es parte de lo que está pagando. La mejor analogía es un concierto en vivo, en el caso estrecho de la escritura personal o creativa: si asistes esperando una actuación en vivo y el artista está haciendo playback, ese es un agravio legítimo. Más precisamente, la divulgación se debe cuando la no divulgación induciría a error a la audiencia sobre lo que está recibiendo. Un periodista que publica bajo su firma promete responsabilidad y originalidad, no la procedencia de cada pulsación de tecla. Un memorialista promete ambas cosas. La prueba es en qué pone su nombre el autor, no si se utilizó alguna herramienta.

Pero la ciencia y el periodismo no son espectáculos en vivo. Se trata de descubrir y compartir conocimiento nuevo. Nadie divulga que usó el corrector ortográfico, asistentes de investigación o una búsqueda en Google. Las normas para la escritura creativa y el arte serán diferentes, con razón, porque las audiencias allí están pagando en parte por la experiencia humana de crear la obra. Las humanidades probablemente terminarán en algún punto intermedio a través de un proceso largo y contencioso, con muchas amistades rotas en el camino. Pero para la investigación y el periodismo, “divulgar todo” no nos lleva adonde necesitamos ir. Lo que los lectores deberían valorar es la precisión y si el autor asume plena responsabilidad por lo que aparece en la página. La procedencia es una señal mucho más débil que cualquiera de las dos.

28. Nadie sabe nada, yo incluido. Está bien — lo iremos resolviendo juntos.

Al principio evité hablar con periodistas sobre IA porque no soy experto en ello en ningún sentido significativo. Pero cada vez me doy más cuenta de que nadie es experto en todo esto, no de verdad, y esperar a que aparezca uno es la manera de terminar sin ninguna norma en absoluto. Sigo evitando dar cualquier consejo más allá de instalar Claude Code (o la herramienta agéntica de tu elección) y conversar con ella para resolver un problema que tengas a mano.

Como de costumbre, Arthur Spirling fue directo al respecto: las cuentas académicas sobre IA que constantemente ofrecen “consejos” a colegas y estudiantes de doctorado, como si estuvieran en los laboratorios desarrollando los modelos, son tediosas. Son espectadores, como el resto de nosotros.11 Incluso las personas en los laboratorios no tienen idea de cuán buenos se volverán los modelos más allá de unos pocos meses.

Así que estamos en una posición incómoda: alguien tiene que empezar a establecer las normas del nuevo entorno de trabajo, y las personas que lo hagan inevitablemente serán personas que no comprenden completamente para qué están estableciendo normas. Eso es extraño e incómodo. También es como probablemente han funcionado la mayoría de las otras transiciones institucionales, aunque a un ritmo mucho más lento.

Pasamos por una versión de esto que parece una eternidad atrás, cuando los profesores tuvieron que aceptar que vigilar el uso de IA por parte de los estudiantes de manera completa y meticulosa no era ni productivo ni posible. Lo mismo es cierto ahora para los investigadores. Puedes auditar las partes que realmente importan, como el código de replicación, y los LLM ya lo hacen más fácil. La procedencia es lo único que no puedes auditar, y es lo que no deberíamos estar dedicando energía de todas formas. Hay que seguir los incentivos y construir sistemas que aseguren que las herramientas se usen bien, no fingir que no se están usando.

En una nota relacionada sobre la docencia, he estado de licencia, por lo que también he evitado dar consejos aquí. Dadas las muchas preguntas que he recibido, soy más pesimista sobre los efectos de la IA en la docencia que en la investigación. Por ejemplo, aunque uso la IA de forma abierta y extensiva en mi investigación y escritura, planeo prohibir todos los dispositivos electrónicos en mis clases sustantivas y reimplantar los exámenes escritos y orales en persona.

Estas no son posiciones contradictorias. El aula es precisamente donde los estudiantes necesitan desarrollar las habilidades cognitivas que hacen productiva la colaboración con IA más adelante. No se puede dirigir de forma significativa una herramienta de IA si nunca aprendiste a pensar sin ella. La preocupación por la atrofia de habilidades de la Parte II es más válida aquí: los estudiantes necesitan internalizar los fundamentos antes de externalizarlos. La investigación es donde se despliegan las mejores herramientas disponibles para producir un resultado valioso. La docencia es donde se asegura que la próxima generación pueda usar esas herramientas bien.12

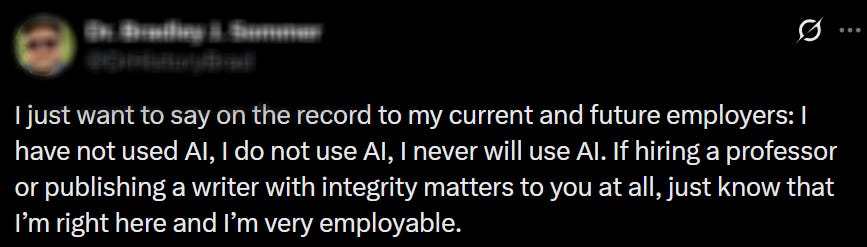

29. El mejor trabajo ocurre cuando humanos e IA colaboran.

Todavía veo a muchas personas comprometerse a no usar IA en su escritura. Esto tiene tanto sentido como comprometerse a no aceptar ayuda de asistentes de investigación o coautores. Por eso me comprometo a lo contrario: usaré los últimos LLM, y cualquier otra herramienta o coautor humano disponible, para mejorar al máximo mi investigación o la forma en que la comunico. De ese modo, si mi nombre está en algo, puedes estar seguro de que refleja mi mejor criterio.

Muchos académicos, especialmente en las humanidades, parecen seguir creyendo que importa cuánto tiempo se dedica al trabajo. Pero la teoría del valor trabajo popular está equivocada en economía, y lo está aquí también. Si eres de los raros que quieren pasar años realizando todas las pruebas de robustez manualmente con matrices invertidas a mano en lugar de ejecutar unos comandos de R, o traduciendo o transcribiendo manuscritos originales de forma manual, eso es asunto tuyo. No me importó mucho si esos profesores de estudios internacionales en ISA dedicaron 10 o 100 horas a sus presentaciones de slop humano. El trabajo es bueno o no lo es.

Dicho esto, hay algunas normas que vale la pena establecer. Cuando escribes “creo” o “siento”, ese primera persona debería ser genuinamente tuyo. El pronombre “yo” lleva implícita la promesa de una voz humana detrás. Una afirmación factual, como el nombre correcto de la OTAN, no le importa quién la escribió. Pero la convicción personal sí importa. Piensa en un concierto en vivo: el público paga por una actuación real, no por un playback. Cuando usas “yo”, el lector tiene derecho a esperar que lo digas en serio. Eso no requiere literalmente escribir (o dictar) cada palabra tú mismo. Puedes dirigir el modelo, trabajar a partir de tus notas y revisarlo con atención, pero sí requiere que la convicción sea tuya.

Este artículo, por ejemplo, fue escrito de manera abierta y orgullosa mediante una conversación iterativa de ida y vuelta con Claude Code, basada en mis ideas originales, conversaciones con colegas, y sugerencias útiles de colegas académicos y no académicos.13 La Parte I experimentó con las capacidades de la IA sin edición humana. La Parte II reflejó una voz 100% humana. La Parte III, que estás leyendo ahora, combina mi voz con las capacidades de la IA, completando el círculo. Te dejo a ti decidir cuál fue la mejor.

¿Dónde conservan entonces los humanos una ventaja? Como argumenta Yiqing Xu, probablemente en entornos abiertos donde los datos de entrenamiento aún no existen y en tareas que requieren interacción humana directa. Esto puede cambiar pronto. Pero elegimos esta carrera porque encontramos sentido en descubrir cosas, no solo porque todavía seamos mejores en ello. Por eso no veo ninguna contradicción en externalizar la mayor parte del trabajo rutinario a la IA (o a los asistentes de investigación, si tienes valores tradicionales) y enfocarse en lo que nos da más sentido: formular preguntas importantes sobre el mundo y responderlas con las mejores herramientas disponibles.

30. El riesgo real en la ciencia es el slop humano a velocidad de IA. Todavía podemos prevenirlo.

La IA amplifica lo que le aportas. Si le traes curiosidad genuina y preguntas difíciles, te ayudará a producir algo que vale la pena leer. Si no le traes nada, producirás nada más rápido.

Pero hay razones para el optimismo. Los mismos hallazgos de Nature que revelaron cuán rota está la reproducibilidad también mostraron que las revistas con intercambio obligatorio de datos y código tenían tasas de reproducibilidad significativamente más altas. La IA ya puede acelerar esto: nada salvo la inercia impide que los editores de revistas instituyan verificaciones automáticas de reproducibilidad y verificación obligatoria de código como condición de envío. Estos sistemas pueden configurarse como cuasi-deterministas, con muy poco margen de error, y los autores siempre pueden impugnar un rechazo automático si consideran que el flujo de trabajo agéntico interno no logró determinar cómo reproducir su código.

De manera más ambiciosa, la IA reduce el costo de hacer el tipo de trabajo a gran escala e intensivo en datos que antes requería ser Raj Chetty con un equipo de 30 asistentes de investigación y acceso a todos los conjuntos de datos administrativos del país, o ser Daron Acemoglu… con papel y lápiz. Un investigador joven con Codex puede ahora intentar proyectos que habrían sido logísticamente imposibles hace cinco años. El listón para lo que se publica debería subir, porque el listón para lo que puede producirse ya lo ha hecho.

El estándar no ha cambiado: si pones tu nombre en algo, lo respaldas. Juzga la calidad del resultado, no del proceso. La conversación sobre el slop de la IA es una distracción de la pregunta más difícil, una que deberíamos haber estado haciendo mucho antes de que llegaran los chatbots: ¿por qué hemos tolerado tanto slop humano desde el principio?

***

Mi objetivo cuando publiqué la Parte I era simple: llevar a la discusión pública la conversación que ya estaba ocurriendo a puerta cerrada y en mensajes privados. Aun así, sigo escuchando lo mismo de mis colegas: “Alex, sabemos que usas IA, nosotros también lo hacemos, pero ¿no puedes simplemente callarte al respecto?”

Entiendo el temor de que la IA se use de forma irresponsable, produciendo más slop del que previene. Pero si lo piensas bien, “cállate al respecto” no es más que abogar por la hipocresía universal como norma profesional. Parte de lo que quería era que la incertidumbre que todos experimentan sobre sus flujos de trabajo y sus futuros alcanzara un equilibrio más estable. Eso requiere conversación honesta, no silencio.

Y ya está ocurriendo. Emily Oster compartió recientemente el consejo de Isaiah Andrews sobre IA para los estudiantes de doctorado en economía del MIT, calificándolo de algo que debería circular a todas las cohortes de doctorado. Como señaló Andy Hall, lo más importante al respecto no era ningún consejo en particular sino que académicos de alto perfil enviaran una señal clara: esto es algo que debes tomarte en serio. Incluso Dylan Matthews, una de las personas más reflexivas en el periodismo, admitió recientemente que los defensores de la IA han tenido razón muchas veces.

El cambio es real. Los académicos ya están medio despiertos, y no van a volver atrás. Los aspirantes a estudiantes de posgrado y los académicos jóvenes deben avanzar con cautela pero abrazar plenamente el aprendizaje y el uso de herramientas de IA. Los académicos, intelectuales y escritores que se nieguen a involucrarse no serán recompensados por su pureza. Simplemente serán superados por colegas que aportan el mismo rigor intelectual, la misma curiosidad, y mejores herramientas.

Debo reconocer que, juntas, esas dos publicaciones se convirtieron en lo más leído que he escrito (con o sin Claude). Las personas en conferencias de inmigración o cualquier otra, sin mencionar a los administradores universitarios de todo el país, ahora me piden consejos sobre IA en lugar de perspectivas sobre inmigración o ciencia política. Esto dice algo sobre la seriedad con la que tomamos las cosas en este campo, y también que debería empezar a cobrar más por mis charlas y consultoría. ↩

No pretendo señalar a ISA de manera injusta. Los organizadores trabajaban bajo limitaciones reales, había muchos paneles excelentes y académicos serios en la conferencia, y he escrito en otros lugares sobre formas concretas de mejorar las conferencias académicas. ↩

Esa es probablemente la afirmación que recibió más rechazo de los primeros lectores de este artículo. Algunos argumentan que mi uso de “slop” estira demasiado el concepto, que el slop de IA (sobreproducido, pulido pero vacío) y el trabajo académico deficiente (descuidado, infraproducido) son modos de fracaso distintos. Normalmente detesto el estiramiento conceptual en la escritura científica, pero genuinamente no creo que eso sea lo que está ocurriendo aquí. Lo que vi en ISA fue trabajo sobreproducido y sin sentido que parecía científico pero no añadía nada al conocimiento humano. Eso es “slop” por cualquier definición. ↩

Puedo atestiguar que muchas citas de mi propio trabajo han sido reinterpretaciones creativas de lo que realmente encontré: hallazgos simplificados, conclusiones invertidas, lo que indica casi con certeza que quienes me citaron no han leído mi trabajo. ↩

“Loro estocástico” proviene de un artículo de 2021 coescrito por la lingüista Emily Bender, que argumenta que los grandes modelos de lenguaje producen texto prediciendo secuencias de palabras probables sin comprensión. ↩

Dean W. Ball va aún más lejos y argumenta que gran parte de la negación de la IA por parte de la izquierda descansa en una cosmovisión donde la industria tecnológica está compuesta de “idiotas superficiales” cuyos logros son siempre superficiales, siempre basados en algún gran robo. Esta heurística puede haber funcionado con las criptomonedas. No funciona con herramientas que millones de investigadores y escritores están usando discretamente para hacer mejor trabajo. ↩

Digo “usadas activamente” porque hay evidencia real de que la dependencia pasiva y acrítica de la IA puede degradar las habilidades de pensamiento crítico, especialmente para tareas rutinarias. Esa es una preocupación real, y por eso argumento más adelante que el aula es donde los estudiantes necesitan construir los fundamentos antes de externalizarlos. ↩

Como argumentó Hollis Robbins hace un año, los únicos académicos que conservarán valor en la era de la IA son los que trabajan en las fronteras del conocimiento. Con el paso del tiempo, ese argumento parece cada vez menos escandaloso. ↩

Todos deberían revisar the Bayesian Hitman. Sin duda sacudirá tus priors. ↩

Como Alison Gopnik y colegas argumentaron recientemente en Science, los LLM se entienden mejor como tecnologías culturales — como la escritura, la imprenta y las bibliotecas — o herramientas que habilitan nuevas formas de producción de conocimiento, aunque ellas mismas no “piensen”. ↩

La excepción que confirma la regla son Aniket Panjwani y Scott Cunningham, que han dedicado meses publicando relatos detallados de primera mano de cómo es realmente hacer investigación con Claude Code. Al menos para mí, ese tipo de relato fue genuinamente útil e instrumental para sacar adelante mi serie sobre IA. ↩

Hay una preocupación legítima al acecho aquí: los estudiantes de doctorado que intentan aprender los fundamentos ahora compiten por espacio en revistas con profesores que tienen legiones de agentes de IA. Eso es real, y por eso la respuesta pedagógica no es “prohibir la IA para siempre.” La respuesta es el andamiaje: aprender a pensar sin la herramienta primero, luego usarla con criterio. ↩

Agradezco especialmente a Steven Adler, Ryan Briggs, Tina Marsh Dalton, Josh Gellers, Jimmy Alfonso Licon, Igor Logvinenko, Ilia Murtazashvili, Kyle Saunders, Dina Pisareva, Quinn Que ❁, Ben Radford, Mike Riggs, Hollis Robbins, Jim Walsh, Sean Westwood, Yiqing Xu y Emma Zhang por sus sugerencias y objeciones. ↩