Пожалуйста, ставьте лайки, делитесь, комментируйте и подписывайтесь. Это помогает развивать рассылку без финансовых вложений с вашей стороны. Спасибо за чтение.

В Части I я утверждал, что ИИ уже способен выполнять задачи в области исследований социальных наук лучше, чем большинство профессоров. В Части II я отреагировал на более чем тысячу откликов: согласился с критиками там, где они были правы, но остался при своём в главном — академический статус-кво был уже сломан, а ИИ лишь ускорил неизбежное столкновение с реальностью.1 В этой Части III, написанной в сотрудничестве с ИИ и коллегами на протяжении последнего месяца, я перехожу от диагноза к тому, что учёные могут и чего не могут с этим поделать.

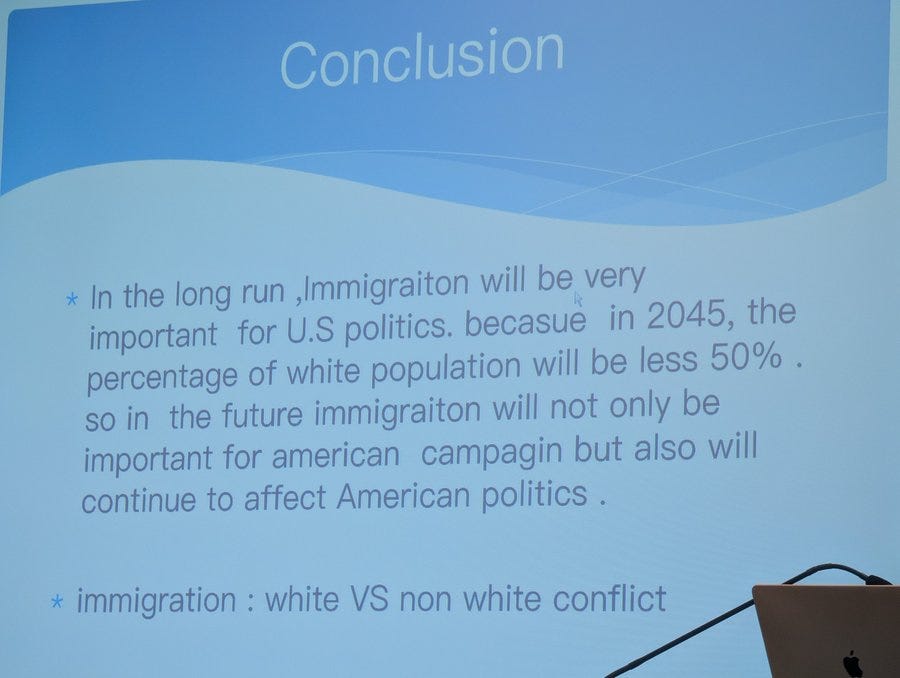

Неожиданным поводом для этого третьего эссе об ИИ послужило посещение Ежегодной конвенции Международной ассоциации исследований (ISA) 2026 года в Колумбусе, Огайо — ведущей мультидисциплинарной конференции ведущих профессионалов в области международных исследований. По крайней мере, так мне говорили. На деле я стал свидетелем презентаций настолько слабых, что они с трудом тянули бы на «удовлетворительно» в любом из моих курсов: аргументы без тезиса и логики, грамматические ошибки, которые поймал бы любой проверяльщик орфографии, докладчики, читавшие с собственных слайдов, словно встречавшие собственные слабые аргументы впервые. И всё это без всякого участия ИИ, насколько я мог судить по наличию опечаток и противоречий. Речь шла не только об аспирантах, но и о людях с учёными степенями, должностями и исследовательскими бюджетами.

Если ИИ-слоп — это тот кризис, о котором все предупреждают, мне интересно, как назвать то, что я увидел на ISA или на большинстве других крупных конференций по социальным наукам.2 Контраст было невозможно игнорировать: я сидел на этих презентациях именно в тот момент, когда онлайн в мой адрес сыпались угрозы убийством и призывы меня уволить за то, что я посмел утверждать: ИИ способен проводить исследования лучше большинства профессоров. Это сопоставление и стало кристаллизацией аргумента для данного текста.

21. Большинство «слопа» всегда было и остаётся человеческим слопом.

Мой первый тезис был самым провокационным из всего, что я когда-либо говорил, и с тех пор я скорректировал его лишь незначительно: агентный ИИ уже способен выполнять большинство исследовательских задач в социальных науках лучше, чем большинство профессоров в глобальном масштабе. Я по-прежнему при своём. В недавнем интервью Chronicle сформулировали это прямее: «ИИ — лучший исследователь, чем вы». Если вы всё ещё в это не верите, поговорим через несколько лет.

Но обратная сторона не менее важна. Если ИИ способен производить исследовательский результат лучше профессоров, это также свидетельство качества результата, который те профессора производили и продолжают производить без ИИ.

«Слоп» был Словом 2025 года по версии Merriam-Webster — низкокачественный цифровой контент, созданный ИИ. Но конференция ISA напомнила мне: подавляющее большинство слопа всегда было человеческим. Система академических журналов и крупные конференции в значительной части гуманитарных и социальных наук были фабриками слопа задолго до того, как кто-либо оформил подписку на ChatGPT. Да, я действительно имею в виду, что большинство исследований — это слоп.3

Часть из них — то, что философ Гарри Франкфурт назвал бы «чушью»: работы, безразличные к тому, соответствуют ли их утверждения действительности, особенно на политически острых темах — таких как иммиграция, — где исследователи начинают с леволиберального вывода и рассуждают в обратном направлении. Но слоп шире, чем чушь. Он включает и работы, вообще не претендующие на утверждение, и работы, которые должны обладать художественной ценностью и просто её не имеют. Исследователь, находящий набор данных прежде, чем у него есть вопрос, а затем перебирающий результаты в поисках значимых для публикации, производит слоп. Такие исследователи существовали задолго до ИИ. Они просто работали медленнее.

22. Учёные галлюцинировали и жульничали до ИИ.

Опасения по поводу галлюцинаций и мошенничества в академической среде, которые люди связывают с ИИ, описывают проблемы, существовавшие ещё несколько десятилетий, если не столетий, назад. Масштабный новый проект, опубликованный в Nature в этом месяце (в котором я принял небольшое участие), проверил сотни работ по социальным наукам: только около половины статистически значимых утверждений воспроизвелись, а медианные размеры эффектов резко сократились. Это исследование подтверждает то, что выявило исследование Open Science Collaboration 2015 года в одной только психологии — примерно две трети результатов не реплицировались — и распространяет эти выводы на другие области.

До ИИ мы не называли это «галлюцинациями». Мы называли это «наукой». Если задуматься, галлюцинация и вдохновение на самом деле не так различны, как кажется. И то и другое предполагает генерацию сочетаний, выходящих за рамки исходных данных. Мы называем это галлюцинацией, когда результат неверен, и прорывом — когда верен.

Между тем учёные регулярно цитируют статьи, которые они не читали дальше аннотации.4 По меньшей мере частота галлюцинаций ИИ отслеживается и снижается. Частота человеческих галлюцинаций в академической среде не отслеживается вовсе. Мы просто называем их «вкладом в литературу». А если вы рецензент, то вам и самому галлюцинировать не нужно: достаточно написать «пожалуйста, процитируйте меня» — и дело сделано.

Некоторые исследования подлинно превосходны. Но прежде чем беспокоиться о мошенничестве с использованием ИИ, стоит на минуту обратиться к человеческим его разновидностям. Дидерик Стапель, Марк Хаузер, Франческа Джино, Дэн Ариели — список громких дел о мошенничестве продолжает пополняться, и это лишь те, кого поймали. Помимо прямой фабрикации, p-хакинг, HARKing (выдвижение гипотез после получения результатов) и избирательная публикация годами были настолько распространены, что едва воспринимались как нарушение. Мы достигли реального прогресса в понимании этих практик, но они по-прежнему достаточно распространены, чтобы влиять на то, что публикуется. Помимо всего этого, старшие профессора всегда ставили свои имена на статьях, написанных главным образом аспирантами, а целые книги собирались командами научных ассистентов под именем известного учёного. Ничто из этого не считалось мошенничеством до тех пор, пока ИИ не сделал этот процесс дешевле и очевиднее.

23. Метафора «стохастического попугая» лучше описывает людей, чем ИИ.

Один из самых влиятельных лозунгов в дискуссии об ИИ5 всегда функционировал как клише, прерывающее мысль. Как заметила Кейт Холл, это удачная формулировка: приятна на слух, концептуально экономна и прочно обосновалась в головах многих людей, хотя к современным моделям неприменима. Подлинный лингвистический шедевр. При этом она эмпирически неверна: каждая крупная фронтирная модель начиная с GPT-4 обучалась на нетекстовых данных, а собственная логика исходного аргумента работает только при условии обучения исключительно на тексте.

Теперь представьте нечто совершенно иное, но при этом очень знакомое: таблички «В нашем доме верят» на американских лужайках. Наука реальна. Любовь есть любовь. Ни один человек не является нелегальным и т. д. Можно соглашаться с каждым пунктом и при этом не иметь ни одной последовательной политической позиции ни по одному из этих вопросов. Что подразумевает «ни один человек не является нелегальным» применительно к правоприменительной политике: открытые границы, амнистия, что-то ещё? Табличка этого не говорит, потому что сказать — значит столкнуться с противоречиями. Это клятва верности, а не аргумент.

Над этой табличкой смеялись годами.

Но суть глубже: именно это и ставят в вину ИИ — что он производит поверхностные, приятные высказывания, сигнализирующие о принадлежности, а не о смысле. Как выясняется, люди занимались этим с ИИ и без него, пока у них были лужайки, где можно ставить таблички.

Табличка на лужайке — не исключение. Именно так большинство людей, похоже, и подходит к большинству вопросов: принимают позицию своей группы, повторяют её и идут дальше. Содержание того, что вы отстаиваете, имеет куда большее значение, чем формулировка, но формулировать легче — поэтому она и господствует в публичном дискурсе, от тредов в Twitter до конференционных докладов.

Я убедился в этом воочию на ISA, где штатные коллеги представляли работы, эквивалентные академическому варианту таблички на лужайке — с несколькими неправильно идентифицированными регрессиями для придания видимости науки. Критика «стохастического попугая» была призвана умалить ИИ. В итоге она оказалась более точным описанием человеческой интеллектуальной жизни, чем кто-либо намеревался.

24. Да, дееспособные взрослые могут использовать ИИ для письма. Полицейские меры не работают.

В Части II я отметил, что детекторы ИИ зачастую малополезны и создают больше проблем, чем решают. Но глубинная проблема — в самом импульсе за ними стоящем: убеждении, что участие ИИ изначально является загрязнением, независимо от того, что оно производит. Квинн Кью выдвигает увлекательный аргумент: одержимость детекторами ИИ-текста сродни применению «правила одной капли» — принципа из американской расовой классификации XIX века: любой след участия ИИ оскверняет всю работу, независимо от её качества или намерения автора.

Поначалу я скептически относился к этой аналогии, но она весьма точна. В глазах антиИИ-активиста любое слово, написанное не вами самими, является нравственным осквернением. Хотя использование ИИ для письма технически не «незаконно», действует своего рода правило одной капли: либо ты законный писатель, либо мошенник, либо хороший человек, либо плохой. Отсюда и осуждение, и угрозы убийством в адрес таких людей, как я, раскрывших своё использование ИИ, — за «делегирование мышления машине».

Как я утверждал в Части I, значительная часть оппозиции ИИ — это защита статуса, замаскированная под принцип. Энди Мэсли идёт дальше, утверждая, что паника вокруг чат-ботов может иметь источник помимо борьбы за статус. Этот источник ближе к суеверию («чат-боты демоничны»): ощущение, что текст, созданный ИИ, духовно осквернён, что в машине, способной писать, есть нечто неправильное или даже злое — вне зависимости от того, что она пишет.6

Даже Меган Макардл, недавно с честью раскрывшая своё использование ИИ и породившая среди журналистов ту же дискуссию, которую учёные вели в Bluesky несколькими месяцами ранее, почувствовала себя обязанной защититься, настаивая на том, что «ИИ не касался готового текста». Я восхищаюсь тем, что она высказалась. Но почему вообще вопрос о готовом тексте должен иметь значение? Если работа хороша и процесс раскрыт, всё остальное — эстетические предпочтения, рядящиеся в этику. Где начинается нечистота? Google-поиск? Автокоррекция? Проверка орфографии? Транскрипции?

И даже отвлекаясь от всего этого: если только не наступит сценарий в стиле «Дюны» — катастрофа ИИ, после которой человечество скоординируется и запретит технологию, — повсеместное написание нон-фикшна с помощью ИИ в условиях равновесия почти неизбежно, учитывая нынешние стимулы. Стоит добавить и обратную сторону: даже если вам и удастся писать хорошо полностью без «загрязнения ИИ», никто в ближайшее время не будет награждать вас за эту чистоту.

25. Не использовать новейшие инструменты ИИ в своих исследованиях и письме — это халатность.

Мэтью Иглесиас недавно утверждал, что большие языковые модели недоиспользуются в журналистике. Его аргумент применим и к учёным: цель исследования — полезный результат, а не опосредованный человеком процесс. Строгость должна быть в мышлении и верификации, а не в том, человек или машина набирал предложения или нажимал Enter при запуске регрессий в R. Как метко выразилась Холлис Роббинс, профессора, вероятно, должны тестировать модели ИИ до завтрака (в общем, быть как Скотт Каннингем).

Самый рутинный способ применения ИИ — поиск ошибок. Возьмём заголовок New York Times от 3 апреля 2026 года: «Североамериканская организация договора без Америки?» Правильное название, разумеется — Североатлантическая организация договора. Times опубликовала исправление на следующий день. Некоторые высказали предположение, что ошибка была вызвана ИИ. Мы никогда этого не узнаем, и, откровенно говоря, это неважно. Любой достаточно умный LLM-рабочий процесс поймал бы ошибку за секунды. Простая автоматическая проверка всех заголовков — «Содержит ли это какие-либо ошибки? Проверьте по двум независимым источникам» — избавила бы Times от целого цикла новостей о конфузе.

Но проверка фактов — это пол, а не потолок. Интереснее использовать ИИ для того, что раньше было невозможно. Моя нынешняя соавтор Келси Пайпер недавно попросила Codex создать ей интерактивный сайт, чтобы по-настоящему разобраться в рецензируемой ею статье по политологии, а затем самостоятельно выполнила задание так, как это делали участники исследования. ИИ не просто сокращает время на производство результата. Он снижает стоимость того типа активного погружения, который большинство исследователей пропускает: создать вещь самому, проверить аргумент на прочность, воспроизвести анализ так, как это делали участники. Это и есть то, что требует по-настоящему глубокого понимания.

То же применимо и к академической среде. Половина презентаций ISA, которые я слушал в Колумбусе, могла бы быть существенно улучшена беглым прогоном через ChatGPT: проверка грамматики, уточнение аргументов, выявление логических пробелов. Эти инструменты бесплатны или почти бесплатны. Отказ от их использования — это выбор сдавать работу хуже, чем ты способен, особенно если твоё призвание — информировать общество. Но журналисты и учёные не должны использовать ИИ только для поиска опечаток в заголовках. Им следует использовать его для создания интерактивных визуализаций, проверки аргументов на прочность и подлинного понимания сложных вещей, о которых они пишут.

Но что насчёт самого письма? Вы, возможно, встречали распространённую реакцию на тех, кто использует ИИ в своих текстах: «Почему мне читать статью, а не промпт, который её породил?» Звучит разумно, правда? Нет, если немного подумать.

Зачем есть блюдо, если можно прочитать список продуктов? Зачем смотреть на график вместо ggplot-скрипта? Зачем читать книгу вместо авторских заметок? Промпт не даёт вам новых знаний. Результат — даёт. Вот весь смысл. Как я утверждал в Части II, разные люди с разной экспертизой, данными и контекстом (как это отражается в их файлах claude.md) производят принципиально разные результаты из одного и того же промпта. Это вопрос мастерства.

Понимаю: бывает странно тратить на чтение чего-то больше времени, чем автор потратил на создание. Но мы уже бывали здесь. График, сгенерированный за секунды в R, можно внимательно читать минутами. Никто не требует и не мечтает видеть только код вместо графика. Оценивают сам график и то, что он говорит — новые знания, недоступные прежде.

26. LLM могут действительно производить новые знания.

Как недавно задокументировал Джон Бёрн-Мёрдок, чат-боты на основе ИИ последовательно подталкивали пользователей к экспертному консенсусу — прямо противоположно тому, что делают социальные сети. Эти инструменты помогают не только лучше писать. При активном использовании они помогают мыслить тщательнее.7 Таким образом, LLM могут даже обратить вспять рост популизма. Но проверка фактов — не то же самое, что производство новых знаний.

Прежде чем спрашивать, могут ли LLM производить подлинно новые идеи (есть хорошие примеры этого), стоит задаться вопросом: сколько людей это делают? Большинство учёных посвящают карьеру рекомбинации существующих идей в незначительных вариациях, применению тех же методов к слегка отличающимся наборам данных, производству инкрементальных работ, которые никто за пределами их субдисциплины никогда не прочитает. Оригинальное мышление исключительно трудно и редко в любом поколении. Я не имею в виду ничего обидного для своих коллег (или себя). Но планка, которую нужно преодолеть LLM, ниже, чем мы признаём.8

Мой друг Роберт Кубинек, блестящий политический методолог и опубликованный автор художественной прозы9 из Университета Южной Каролины, похоже, скептически относится ко многим заявлениям об ИИ. Он утверждает, что «LLM никогда не создают знание, [которое] существует только в человеческих мозгах. Они могут лишь сопоставлять один набор знаний с другим». Я уважаю Боба, поэтому мы можем расходиться во мнениях. Мой ответ: философский вопрос о самосознании реален, но он ортогонален практическому. Понимает ли модель что-либо или нет, результат либо содержит новую информацию, полезную людям, либо нет.10

Наиболее показательный недавний пример — Claude Mythos, новая фронтирная модель Anthropic. За несколько недель тестирования она выявила тысячи ранее неизвестных уязвимостей безопасности в основных операционных системах и браузерах, включая одну, не обнаруживавшуюся 27 лет. Как бы вы это ни назвали, формулировка «сопоставить один набор знаний с другим» этого явно не покрывает.

Лучшие концептуальные теории в социальных науках уже являются рекомбинациями существующих идей. Энтони Даунс построил свою теорию рационального выбора, перенеся максимизацию полезности из микроэкономики в теорию голосования, и буквально назвал свою книгу Экономическая теория демократии. Баумгартнер и Джонс заимствовали прерывистое равновесие из эволюционной биологии и применили его к изучению политики. Анализ социальных сетей целиком импортировал теорию графов из математики. Аксельрод объединил дилемму заключённого с эволюционным отбором по приспособленности. Александр Вендт пошёл дальше и применил квантовую теорию к международным отношениям в Quantum Mind and Social Science — шаг, который многие (справедливо) сочли нелепым, но который Cambridge University Press всё же опубликовал. Социальные науки редко изобретают с нуля. Они переводят между областями, и перевод и есть теоретический вклад.

Это структурно идентично тому, что делают LLM: рекомбинируют паттерны и концепции в разных контекстах. Иногда результат — бессмыслица. Иногда — продуктивен. То же самое верно и для человеческой рекомбинации. Квантовые международные отношения Вендта были раскритикованы как метафора, маскирующаяся под физику, — но, как было отмечено выше, Cambridge University Press её опубликовал. Если это считается производством знания, трудно понять, почему рекомбинации, созданные LLM, таковыми не являются.

К чести Боба, он согласился с практическим аргументом, сохранив философский: «вопрос в том, как использовать эту возможность для продвижения знания». Именно. Как я сказал в Части I: перестаньте спорить о том, «по-настоящему ли понимают» LLM, пока люди с наибольшими ставками уже используют эти инструменты для улучшения своей работы.

27. У критиков ментальная модель пользователя ИИ застряла в 2023 году — а это целая эпоха назад.

Вспомним, как мы сюда попали. Студенты начали с энтузиазмом использовать ИИ раньше своих профессоров, пользуясь самыми первыми публичными бесплатными моделями типа ChatGPT 3.5. В результате многие профессора и интеллектуалы по-прежнему представляют типичного пользователя ИИ как студента, пытающегося списать эссе, или как ассистента, сдавшего провальный ИИ-слоп. Это может по-прежнему описывать много повседневного использования ИИ по всему миру. Это не описывает, как ведущие исследователи в большинстве областей работают с этими инструментами и как в действительности функционирует тот, кто пытается использовать ИИ ответственно и осознанно.

Стефан Шуберт лучше всего это сформулировал: мы недооцениваем рациональность других людей, предполагая, что они применяют новые инструменты значительно более бездумно, чем это есть на самом деле. Между просьбой к ChatGPT написать целую статью и самостоятельным написанием каждого слова — огромное пространство возможностей. Когда вы пишете «сами», вы уже используете shortcuts. Вы не проводите глубокого исследования по каждой упоминаемой ссылке. Вы гуглите статистику и доверяете числу в заголовке. Вы просматриваете аннотацию и цитируете статью. При наличии ресурсов вы поручаете верификацию ассистенту или фактчекеру. ИИ позволяет делать многое из этого более систематично, автоматизированно и дёшево.

Как и многие, Дерек Томпсон справедливо считает, что письмо — это мышление, и что полное делегирование процесса письма ИИ опустошает ум. Но хотя большая часть письма есть мышление, мышление — не только письмо. Создание искусства — это мышление. Разговор — тоже мышление. Как утверждает Дина Писарева, составление промптов — тоже мышление, если на другой стороне диалога достойный Сократов собеседник.

Томпсон также признаёт, что всё письмо всегда предполагало обращение за пределы собственного ума за идеями, фактами, редактурой и проверкой. Граница между законной помощью и незаконным аутсорсингом всегда была размытой, и ИИ эту размытость не создал. Он лишь сделал её невозможной для игнорирования. Собственный вывод Томпсона: «Нам следует честно и открыто говорить об этой размытости, а не объявлять всех, у кого открыто окно Claude, частью класса слопа».

Что же остаётся от раскрытия использования ИИ? Многие добросовестные люди и ведущие академические журналы предлагают полное раскрытие использования ИИ в качестве решения. Но раскрытие не является устойчивым в теоретико-игровом смысле: те, кто раскрывает, несут репутационные издержки, тогда как скрывающие пользуются этим бесплатно, — поэтому равновесие смещается к нераскрытию. Такие люди, как Меган Макардл и я, — живое тому доказательство. И более точная формулировка, как выражается Райан Бриггс, состоит в том, что ИИ дополняет экспертизу: автоматизированные ассистенты, проверяющие вашу работу, формализующие аргументы на ходу, собирающие данные по требованию. Это мультипликатор, позволяющий способным людям мыслить лучше и быстрее.

Мне кажется, раскрытие действительно необходимо лишь тогда, когда аудитория имеет обоснованное ожидание полностью созданной человеком работы и это ожидание — часть того, за что она платит. Лучшая аналогия — живой концерт в узком случае личного или творческого письма: если вы пришли ждать живого выступления, а артист поёт под фонограмму, это законная претензия. Точнее, раскрытие необходимо тогда, когда его отсутствие вводило бы аудиторию в заблуждение относительно того, что она получает. Журналист, публикующий материал под своим именем, обещает ответственность и оригинальность — не провенанс каждого нажатия клавиши. Мемуарист обещает и то и другое. Критерий — то, под чем автор ставит своё имя, а не то, использовался ли какой-либо инструмент.

Но наука и журналистика — не живые шоу. Они про открытие и распространение новых знаний. Никто не раскрывает использование проверки орфографии, ассистентов или Google-поиска. Нормы для творческого письма и искусства будут иными, и справедливо: аудитория там отчасти платит за человеческий опыт создания вещи. Гуманитарные науки, вероятно, займут промежуточное положение в ходе долгого и острого процесса, в котором пострадает немало дружеских отношений. Но для исследований и журналистики «раскрывать всё» не ведёт нас туда, куда нужно. Читателей должны заботить точность и то, берёт ли автор полную ответственность за написанное. Провенанс — куда более слабый сигнал, чем любое из двух.

28. Никто ничего не знает — я в том числе. Это нормально — разберёмся вместе.

Поначалу я избегал говорить с журналистами об ИИ, потому что я не эксперт в этой теме ни в каком значимом смысле. Но всё больше понимаю: никто на самом деле не является экспертом в том, чем всё это является, и ожидание появления такого эксперта — верный способ остаться вовсе без норм. Я по-прежнему уклоняюсь от любых советов, кроме одного: установить Claude Code (или любой другой агентный инструмент по вашему выбору) и попросить его решить стоящую перед вами конкретную задачу.

Как обычно, Артур Спирлинг был прямолинеен по этому поводу: академические аккаунты об ИИ, постоянно раздающие «советы» коллегам и аспирантам, как будто они работают в лабораториях, разрабатывающих модели, — утомительны. Они наблюдатели, как и все мы.11 Даже люди в лабораториях не знают, насколько хорошими станут модели уже через несколько месяцев.

Таким образом, мы в неловком положении: кто-то должен начать формировать нормы нового рабочего пространства, и люди, занимающиеся этим, неизбежно будут теми, кто не до конца понимает, для чего они эти нормы выстраивают. Это странно и некомфортно. Так же, по всей видимости, работало большинство других институциональных переходов — только с гораздо более медленным темпом.

Мы прошли через версию этого, кажущуюся сегодня эпохой назад: профессора вынуждены были признать, что полный и тщательный контроль за использованием ИИ студентами ни продуктивен, ни возможен. То же самое теперь верно для исследователей. Вы можете проверять части, которые действительно важны, — например, код репликации, а LLM уже облегчают эту задачу. Провенанс — это единственное, что вы не можете проверить, и именно это не стоит наших усилий. Нужно следовать стимулам и выстраивать системы, обеспечивающие грамотное использование инструментов, — а не притворяться, что ими вовсе не пользуются.

По смежной теме — преподавание: я находился в отпуске, поэтому здесь тоже уклонялся от советов. Учитывая многочисленные вопросы, которые я получаю, я настроен пессимистичнее в отношении влияния ИИ на преподавание, чем на исследования. Например, хотя я открыто и широко использую ИИ в своих исследованиях и письме, я планирую запретить все электронные устройства на своих содержательных курсах и вернуть очные письменные и устные экзамены.

Это не противоречивые позиции. Аудитория — это именно то место, где студентам нужно развивать когнитивные навыки, которые сделают взаимодействие с ИИ продуктивным позднее. Нельзя осмысленно направлять инструмент ИИ, если ты никогда не учился мыслить без него. Опасение атрофии навыков из Части II наиболее справедливо именно здесь: студентам нужно усвоить основы прежде, чем их делегировать. Исследование — это место, где вы применяете лучшие доступные инструменты для достижения достойного результата. Преподавание — это место, где вы обеспечиваете способность следующего поколения действительно пользоваться этими инструментами.12

29. Лучшая работа происходит, когда люди и ИИ сотрудничают.

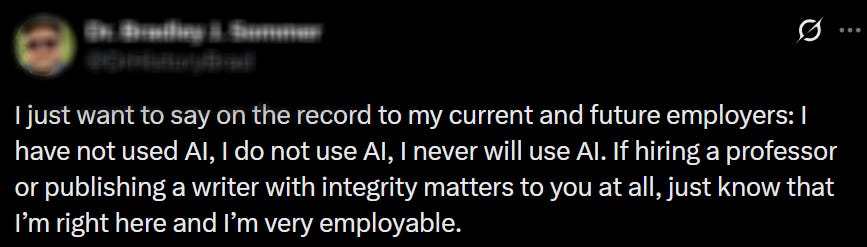

Я до сих пор вижу немало людей, давших обет не использовать ИИ в своём письме. Это примерно так же разумно, как давать обет не принимать помощи от ассистентов или соавторов. Поэтому я даю противоположный обет: я буду использовать новейшие LLM и, разумеется, любые другие доступные инструменты или соавторов-людей, чтобы наилучшим образом улучшить свои исследования или способ их подачи. Таким образом, если моё имя стоит на чём-либо, вы можете быть уверены: это отражает моё собственное наилучшее суждение.

Многие учёные, особенно в гуманитарных науках, по-прежнему, кажется, считают, что важно, сколько времени вы тратите на свою работу. Но народная трудовая теория ценности неверна в экономике — и здесь тоже. Если вы чудак, желающий годами вручную инвертировать матрицы вместо того, чтобы запустить несколько команд в R, или вручную переводить или транскрибировать оригинальные рукописи — это ваш выбор. Меня не слишком волновало, потратили ли те профессора международных исследований на ISA 10 или 100 часов на свои человеческие слоп-презентации. Работа либо хороша, либо нет.

Тем не менее некоторые нормы стоит установить. Когда вы пишете «я считаю» или «я чувствую», это первое лицо должно действительно быть вами. Местоимение «я» несёт в себе молчаливое обещание человеческого голоса за ним. Фактическое утверждение — скажем, правильное название НАТО — не важно, кто его набрал. Но личное убеждение важно. Представьте живой концерт: аудитория платит за настоящее выступление, а не за фонограмму. Когда вы используете «я», читатель вправе ожидать, что вы это имеете в виду. Это не требует буквально набирать (или диктовать) каждое слово самому. Вы можете направлять модель, работать на основе своих заметок, тщательно перечитывать — но убеждение должно быть вашим.

Этот текст, например, открыто и с гордостью написан в итерационном диалоге с Claude Code — на основе моих собственных идей, разговоров с коллегами и ценных предложений со стороны человеческих академических и неакадемических коллег.13 Часть I экспериментировала с возможностями ИИ без редактуры человеком. Часть II отражала стопроцентно человеческий голос. Часть III, которую вы сейчас читаете, соединяет мой голос с возможностями ИИ, замыкая круг. Предоставляю вам решить, какая была лучшей.

Где же у людей остаётся преимущество? Как утверждает Ицин Сюй, вероятно, в открытых средах, где обучающих данных ещё не существует, и в задачах, требующих непосредственного взаимодействия людей. Это может вскоре измениться. Но мы выбрали эту карьеру, потому что нам важно разбираться в вещах, а не только потому, что мы в этом ещё лучше. Поэтому я не вижу никакого противоречия в том, чтобы делегировать большую часть рутинной работы ИИ (или ассистентам, если вы придерживаетесь традиционных ценностей) и сосредоточиться на том, что придаёт наибольший смысл: формулировать важные вопросы о мире и отвечать на них с помощью лучших доступных инструментов.

30. Настоящий риск в науке — человеческий слоп со скоростью ИИ. Мы ещё можем это предотвратить.

ИИ усиливает то, с чем вы к нему приходите. Принесёте подлинное любопытство и серьёзные вопросы — ИИ поможет вам создать нечто стоящее. Не принесёте ничего — и ничто вы произведёте быстрее.

Но есть основания для оптимизма. Те же результаты Nature, раскрывшие неисправность воспроизводимости, также показали: журналы с обязательным открытым доступом к данным и коду имели значимо более высокие показатели воспроизводимости. ИИ уже может ускорить этот процесс: ничто, кроме инерции, не мешает редакторам журналов ввести автоматизированные проверки воспроизводимости и обязательную верификацию кода как условие подачи рукописи. Эти системы можно настроить как квазидетерминированные, с минимальной погрешностью, и авторы всегда могут оспорить автоматический отказ, если считают, что внутренний агентный рабочий процесс не справился с воспроизведением их кода.

Если мыслить масштабнее, ИИ снижает стоимость крупномасштабных, интенсивных по данным исследований, которые прежде требовали быть Раджем Четти с командой из 30 ассистентов и доступом ко всем административным базам данных в стране, или Дароном Аджемоглу — с карандашом и бумагой. Молодой учёный с Codex сегодня может браться за проекты, которые пять лет назад были бы логистически невозможны. Планка для публикаций должна подняться, потому что планка для производства уже поднялась.

Стандарт не изменился: если ты ставишь своё имя на что-то, ты за это отвечаешь. Судите качество результата, а не процесс. Дискуссия об ИИ-слопе отвлекает от более трудного вопроса, который мы должны были задавать задолго до прихода чат-ботов: почему мы так долго мирились с таким количеством человеческого слопа?

***

Моя цель, когда я публиковал Часть I, была простой: вынести разговор, который уже велся за закрытыми дверями и в личных сообщениях, на открытое обсуждение. И всё же я продолжаю слышать одно и то же от коллег: «Алекс, мы знаем, что ты используешь ИИ, мы тоже это делаем — но не мог бы ты просто помолчать об этом?»

Я понимаю страх, что ИИ будет использоваться безответственно и породит больше слопа, чем предотвратит. Но если задуматься, «помолчи об этом» — это просто призыв к всеобщему лицемерию как профессиональной норме. Отчасти я хотел, чтобы неопределённость, которую все переживают в отношении своих рабочих процессов и своего будущего, достигла более стабильного равновесия. А это требует честного разговора, а не молчания.

И он уже происходит. Эмили Остер недавно поделилась советами Исайи Эндрюса об ИИ для аспирантов-экономистов MIT, назвав их тем, что следует распространить среди всех аспирантских когорт. Как отметил Энди Холл, самым важным в них был не какой-либо конкретный совет сам по себе, а то, что видные профессора посылают чёткий сигнал: это то, к чему нужно относиться серьёзно. Даже Дилан Мэттьюс, один из самых вдумчивых людей в журналистике, недавно признал, что сторонники ИИ во многом оказались правы.

Перемена реальна. Учёные уже наполовину проснулись — и назад не вернутся. Начинающим аспирантам и молодым учёным следует действовать осторожно, но в полной мере осваивать и использовать инструменты ИИ. Учёные, интеллектуалы и писатели, отказывающиеся вовлекаться, не будут вознаграждены за свою чистоту. Их просто превзойдут коллеги, обладающие той же интеллектуальной строгостью, тем же любопытством — и лучшими инструментами.

Должен признать: вместе эти два поста стали самым читаемым из всего, что я когда-либо писал (с Claude или без). На конференциях по иммиграции и в других местах, не говоря уже об университетских администраторах по всей стране, люди теперь просят у меня советов по ИИ, а не по иммиграции или политологии. Это говорит кое-что о том, насколько серьёзно мы относимся к вещам в этой области, а также о том, что мне стоит начать брать больше за свои лекции и консультации. ↩

Я не хочу несправедливо выделять ISA. Организаторы работали в условиях реальных ограничений, на конференции было немало отличных секций и серьёзных учёных, и я написал в другом месте о конкретных способах улучшить академические конференции. ↩

Вероятно, именно это утверждение вызвало наибольшее сопротивление у ранних читателей этого текста. Некоторые полагают, что моё использование слова «слоп» чрезмерно расширяет это понятие: мол, ИИ-слоп (перепроизведённый, отполированный, но пустой) и плохая академическая работа (небрежная, недопроизведённая) — это разные режимы провала. Обычно я не одобряю концептуальных растяжений в научном письме, но искренне не думаю, что здесь это происходит. То, что я видел на ISA, — это перепроизведённая бессмысленная работа, выглядящая как наука, но не добавляющая ничего к человеческому знанию. Это «слоп» по любому определению. ↩

Могу засвидетельствовать: многие цитирования моих работ представляли собой творческое переосмысление того, что я в действительности обнаружил: выводы упрощались, заключения переворачивались — что почти наверняка указывает на то, что цитировавшие меня не читали мои работы. ↩

«Стохастический попугай» — формулировка из статьи 2021 года лингвистки Эмили Бендер и соавторов; она утверждала, что большие языковые модели производят текст, предсказывая вероятные последовательности слов, без какого-либо понимания. ↩

Дин У. Болл идёт ещё дальше, утверждая, что значительная часть отрицания ИИ левыми опирается на мировоззрение, в котором технологическая индустрия состоит из «пустых болванов», чьи достижения всегда поверхностны и всегда основаны на некоем масштабном воровстве. Эта эвристика, возможно, работала для крипто. Для инструментов, которые миллионы исследователей и писателей тихо используют для улучшения своей работы, она не работает. ↩

Я говорю «при активном использовании», потому что есть реальные свидетельства того, что пассивная, некритическая зависимость от ИИ может ослаблять навыки критического мышления — особенно в рутинных задачах. Это реальная проблема, и именно поэтому я утверждаю ниже, что аудитория — это место, где студентам нужно заложить основы, прежде чем их делегировать. ↩

Как утверждала Холлис Роббинс год назад, единственные учёные, которые сохранят ценность в эпоху ИИ, — это те, кто работает на переднем крае знания. Чем больше времени проходит, тем менее возмутительным кажется этот аргумент. ↩

Всем стоит ознакомиться с «Байесовским киллером». Он точно пересмотрит ваши априорные оценки. ↩

Как недавно утверждали Элисон Гопник и коллеги в журнале Science, LLM лучше всего понимать как культурные технологии — подобно письму, печати и библиотекам, то есть инструментам, открывающим новые формы производства знания, даже если они сами по себе не «мыслят». ↩

Исключение, подтверждающее правило, — Аникет Панджвани и Скотт Каннингем, опубликовавшие на протяжении месяцев подробные первоначальные отчёты о том, как реально выглядит исследовательская работа с Claude Code. По крайней мере для меня этот вид материала был искренне полезен и инструментально важен для создания моей серии об ИИ. ↩

Здесь скрывается справедливое опасение: аспиранты, осваивающие основы, теперь конкурируют за место в журналах с профессорами, имеющими легионы ИИ-агентов. Это реально, и именно поэтому ответ в преподавании — не «запретить ИИ навсегда». Ответ — строительные леса: сначала научись мыслить без инструмента, затем используй его осознанно. ↩

Я особенно благодарен Стивену Адлеру, Райану Бриггсу, Тине Марш Далтон, Джошу Геллерсу, Джимми Альфонсо Ликону, Игорю Логвиненко, Илье Муртазашвили, Кайлу Сондерсу, Дине Писаревой, Квинн Кью, Бену Рэдфорду, Майку Риггсу, Холлис Роббинс, Джиму Уолшу, Шону Уэствуду, Ицин Сюй и Эмме Чжан за их полезные предложения и критику. ↩