Por favor, curta, compartilhe, comente e assine. Isso ajuda a fazer o boletim crescer sem custo financeiro para você. Obrigado pela leitura.

Na Parte I, argumentei que a IA já consegue fazer pesquisa em ciências sociais melhor do que a maioria dos professores. Na Parte II, respondi a mais de mil reações, reconhecendo onde os críticos tinham razão, mas mantendo minha tese principal: o status quo acadêmico já estava quebrado, e a IA apenas forçou o acerto de contas.1 Nesta Parte III, escrita colaborativamente com IA e colegas ao longo do último mês, deixo o diagnóstico de lado e passo a tratar do que os acadêmicos podem — e não podem — fazer a respeito.

A causa imediata bastante improvável desta terceira parte sobre IA foi a visita à Convenção Anual de 2026 da International Studies Association (ISA) em Columbus, Ohio — uma das mais importantes conferências multidisciplinares de profissionais em estudos internacionais do mundo. Ao menos era o que me diziam. O que eu de fato presenciei foram apresentações tão precárias que mal tirariam um C em qualquer das minhas aulas: argumentos sem tese nem coerência, erros gramaticais que qualquer corretor automático detectaria, apresentadores lendo os próprios slides como se estivessem descobrindo seus argumentos ruins pela primeira vez. Tudo sem qualquer envolvimento aparente de IA — a julgar pela presença de erros de digitação e inconsistências. E não eram apenas estudantes de pós-graduação: eram pessoas com doutorado, estabilidade funcional e verbas de pesquisa.

Se o conteúdo de baixa qualidade gerado por IA é a crise que todos alertam, gostaria de saber como chamar o que vi na ISA ou na maioria dos grandes congressos de ciências sociais.2 O contraste era impossível de ignorar: eu estava sentado naquelas apresentações exatamente no momento em que recebia ameaças de morte e pedidos de demissão online por sugerir que a IA consegue fazer pesquisa melhor do que a maioria dos professores. Essa justaposição cristalizou o argumento deste texto.

21. A maior parte do “slop” sempre foi — e ainda é — slop humano.

Minha primeira tese foi a afirmação mais provocadora que já fiz, e a ajustei apenas levemente desde então: a IA agêntica já consegue realizar a maioria das tarefas de pesquisa em ciências sociais melhor do que a maioria dos professores no mundo. Continuo mantendo essa posição. Em minha entrevista recente ao Chronicle, eles foram ainda mais diretos: “AI Is a Better Researcher Than You.” Se você ainda não acredita nisso, vamos conversar daqui a alguns anos.

Mas o outro lado da moeda é igualmente importante. Se a IA consegue produzir resultados de pesquisa melhores do que os professores, isso também é uma condenação do que esses professores produziam — e ainda produzem — sem IA.

“Slop” foi a Palavra do Ano de 2025 do Merriam-Webster, definida como conteúdo digital de baixa qualidade produzido por IA. Mas a conferência da ISA foi um lembrete de que a grande maioria do slop sempre foi slop humano. O sistema de periódicos acadêmicos e os grandes congressos em boa parte das humanidades e ciências sociais eram fábricas de slop muito antes de qualquer pessoa ter uma assinatura do ChatGPT. Sim, estou dizendo mesmo que a maioria das pesquisas é slop.3

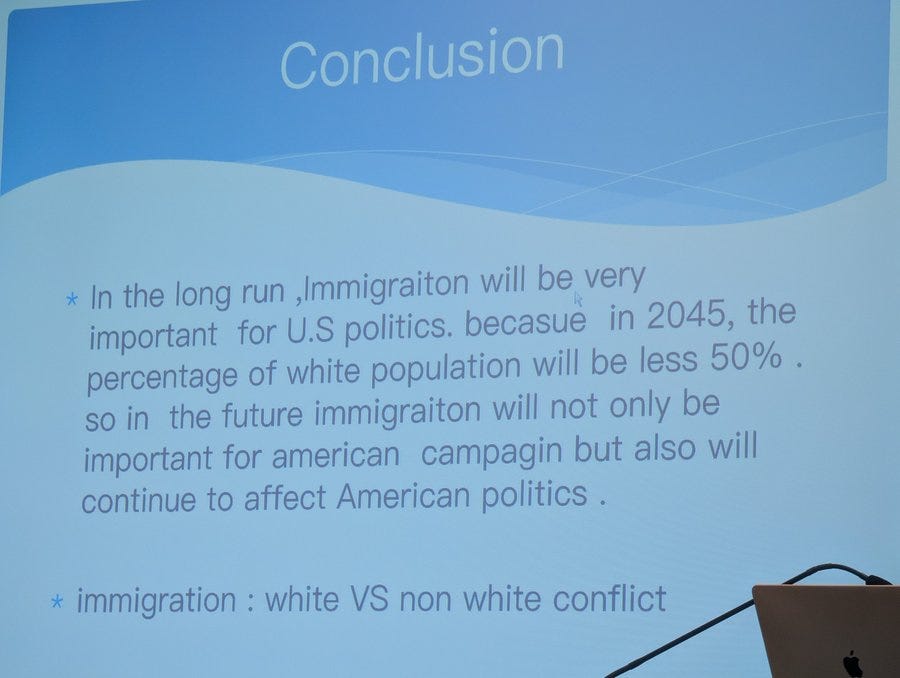

Parte disso também é o que o filósofo Harry Frankfurt chamaria de “bullshit”: trabalho que é indiferente à veracidade de suas afirmações, especialmente em temas politicamente carregados como imigração, onde pesquisadores partem da conclusão de esquerda e trabalham de trás para frente. Mas slop é mais amplo do que bullshit. Inclui também trabalhos que não fazem afirmação alguma, trabalhos que deveriam ter valor artesanal e simplesmente fracassam. O pesquisador que encontra um conjunto de dados antes de ter uma pergunta e garimpa resultados significativos que valham a publicação está produzindo slop. Esses pesquisadores existiam muito antes da IA. Eram apenas mais lentos.

22. Os acadêmicos já alucinavam e trapaceavam antes da IA.

As preocupações com alucinação e trapaça que as pessoas levantam sobre a IA na academia descrevem problemas que a precedem por décadas, se não por séculos. Um grande novo projeto publicado na Nature este mês (do qual participei de forma modesta) testou centenas de artigos de ciências sociais: apenas cerca de metade das afirmações estatisticamente significativas se replicaram, com tamanhos de efeito medianos reduzindo-se drasticamente. Esse estudo confirma o que o Open Science Collaboration de 2015 encontrou apenas em psicologia — onde cerca de dois terços dos resultados não se replicaram — e estende essa conclusão a outras áreas.

Antes da IA, não chamávamos isso de “alucinações”. Chamávamos de “ciência”. Se você parar para pensar, alucinação e inspiração não são tão diferentes quanto parecem. Ambas envolvem gerar combinações que vão além dos dados de entrada. Chamamos de alucinação quando o resultado está errado, e de descoberta quando está certo.

Enquanto isso, acadêmicos rotineiramente citam artigos que não leram além do resumo.4 Pelo menos as taxas de alucinação da IA são monitoradas e estão melhorando. As taxas de alucinação humana na academia não são monitoradas de forma alguma. Simplesmente as chamamos de “contribuições à literatura”. E se você é parecerista, nem precisa alucinar por conta própria: basta escrever “por favor, me cite” e seguir em frente.

Algumas pesquisas são genuinamente excelentes. Mas antes de nos preocuparmos com trapaça assistida por IA, vale a pena confrontar a trapaça humana por um momento. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely: a lista de casos de fraude de alto perfil não para de crescer, e esses são apenas os que foram descobertos. Além da fabricação pura e simples, p-hacking, HARKing (formular hipóteses depois de conhecer os resultados) e relato seletivo foram por anos tão comuns que mal eram considerados má conduta. Avançamos bastante na compreensão dessas práticas, mas elas continuam disseminadas o suficiente para moldar o que é publicado. Além de tudo isso, professores sênior sempre colocaram seus nomes em artigos escritos principalmente por estudantes de pós-graduação, e livros inteiros foram montados por equipes de assistentes de pesquisa trabalhando sob o nome de um acadêmico famoso. Nada disso era considerado trapaça — até a IA tornar o processo mais barato e mais evidente.

23. A metáfora do “papagaio estocástico” descreve melhor os humanos do que a IA.

Um dos slogans mais influentes no debate sobre IA5 sempre funcionou como um clichê que encerra o pensamento. Como Cate Hall observou, é uma expressão poderosa: agradável de pronunciar, conceptualmente eficiente, e colonizou permanentemente a mente de muitas pessoas — apesar de não ser verdade para os modelos atuais. Uma genuína obra de arte linguística. Também é empiricamente falsa: todo grande modelo de fronteira desde o GPT-4 foi treinado com dados não textuais, e a própria lógica do argumento original exige treinamento exclusivamente em texto para funcionar.

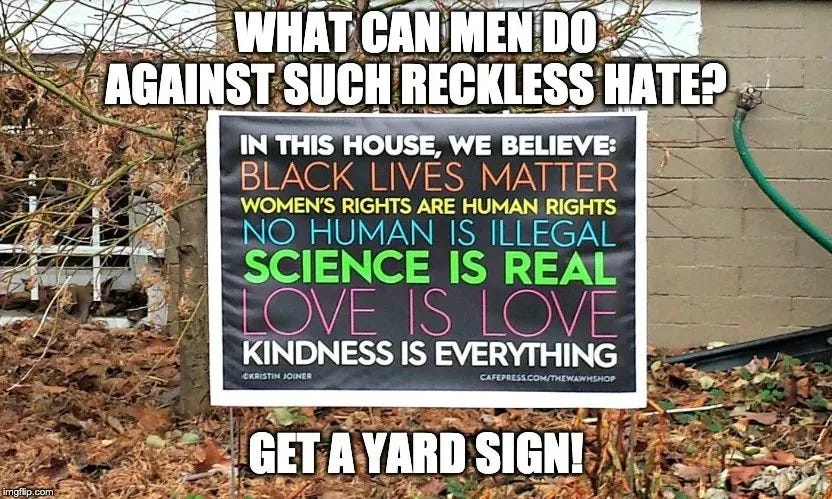

Agora considere algo completamente diferente, mas ainda muito familiar: as placas de jardim “In This House We Believe”. Science Is Real. Love Is Love. No Human Is Illegal, etc. Você pode acreditar em cada linha e ainda assim não ter nenhuma posição coerente de política em nenhum desses temas. O que “nenhum ser humano é ilegal” implica para a política de fiscalização: fronteiras abertas, anistia, outra coisa? A placa não diz, porque dizer exigiria confrontar contradições. É um juramento de lealdade, não um argumento.

Há anos as pessoas zombam dessa placa.

Mas o ponto mais profundo é que isso é exatamente do que a IA é criticada: produzir afirmações rasas e tranquilizadoras que comunicam pertencimento em vez de significado. Acontece que os humanos fazem isso com ou sem IA desde que temos gramados para colocar placas.

A placa de jardim não é exceção. É como a maioria das pessoas parece se engajar com a maioria dos temas: adotar a posição do grupo, repeti-la, seguir em frente. O conteúdo do que você argumenta importa muito mais do que como você o enquadra, mas o enquadramento é mais fácil — por isso domina o discurso público, de threads no Twitter a apresentações em congressos.

Vi isso de perto na ISA, onde colegas titulados apresentaram trabalhos que equivaliam ao equivalente acadêmico de uma placa de jardim, completos com algumas regressões mal identificadas para dar aparência de ciência. A crítica do papagaio estocástico pretendia diminuir a IA. Acabou sendo uma descrição mais precisa da vida intelectual humana do que qualquer um pretendia.

24. Sim, adultos conscientes podem usar IA para escrever. Fiscalizar isso não funciona.

Na Parte II, observei que os detectores de IA frequentemente não são muito úteis e criam mais problemas do que resolvem. Mas o problema mais profundo é o impulso por trás deles: a crença de que o envolvimento da IA é inerentemente contaminante, independentemente do que produz. Quinn Que apresenta um argumento fascinante de que a obsessão com detectores de escrita por IA é semelhante à aplicação de uma “regra da gota de sangue” — o princípio da classificação racial americana do século XIX: qualquer traço de envolvimento da IA contamina o trabalho como um todo, independentemente da qualidade ou da intenção do autor.

Inicialmente fui cético em relação à analogia, mas ela está bastante correta. Na visão do ativista anti-IA, qualquer palavra que você não escreveu por conta própria é uma poluição moral. Embora usar IA para escrever não seja tecnicamente “ilegal”, existe basicamente uma regra da gota de sangue que determina se você é um escritor legítimo ou um fraude, uma boa pessoa ou uma má. Daí as condenações e as ameaças de morte a pessoas como eu, que divulgam o uso de IA por “terceirizar o pensamento para a máquina”.

Como argumentei na Parte I, grande parte da oposição à IA é proteção de status disfarçada de princípio. Andy Masley vai além, argumentando que o pânico moral em torno dos chatbots pode ter uma origem além do projeto de status. Essa origem é algo mais próximo da superstição (“chatbots são demoníacos”): a sensação de que o texto produzido por IA é espiritualmente contaminado, que há algo errado ou até maligno em uma máquina que consegue escrever, independentemente do que escreve.6

Mesmo Megan McArdle, que recentemente divulgou honrosamente seu uso de IA e gerou entre jornalistas a mesma conversa que acadêmicos estavam tendo no Bluesky alguns meses antes, sentiu-se compelida a se defender insistindo que “a IA não tocou o texto final”. Admiro sua coragem em se manifestar. Mas por que a questão do texto final deveria ser um problema? Se o trabalho é bom e o processo é divulgado, o restante é preferência estética disfarçada de ética. Onde começa a impureza? Na busca no Google? No autocorretor? No verificador ortográfico? Nas transcrições?

E mesmo deixando tudo isso de lado: salvo algum cenário estilo Duna de catástrofe com IA seguida de coordenação da humanidade para banir a tecnologia, a escrita de não-ficção amplamente assistida por IA é quase inevitável no equilíbrio, dados os incentivos existentes. O lado oposto que vale mencionar é que, mesmo que você consiga escrever bem inteiramente por conta própria sem “poluição da IA”, ninguém vai recompensá-lo por essa pureza tão cedo.

25. Não usar as ferramentas de IA mais recentes em sua pesquisa e escrita é negligência.

Matthew Yglesias argumentou recentemente que os modelos de linguagem de grande escala são subutilizados no jornalismo. Seu ponto se aplica também aos acadêmicos: o objetivo da pesquisa é o resultado útil, não o processo mediado por humanos. O rigor deve estar no pensamento e na verificação, não em se um humano ou uma máquina digitou as frases ou pressionou enter ao rodar as regressões no R. Como Hollis Robbins colocou bem, os professores provavelmente deveriam testar modelos de IA antes do café da manhã (basicamente ser como Scott Cunningham).

O uso mais mundano da IA é detectar erros. Considere a manchete do New York Times de 3 de abril de 2026: “A North American Treaty Organization Without America?” O nome correto é, claro, a Organização do Tratado do Atlântico Norte. O Times publicou uma correção no dia seguinte. Alguns especularam que o erro foi causado por IA. Nunca saberemos, e francamente não importa. Qualquer fluxo de trabalho com LLM suficientemente inteligente teria detectado o erro em segundos. Uma rotina automática simples para todas as manchetes — “Há algum erro aqui? Verifique em duas fontes separadas” — teria poupado ao Times um ciclo de notícias constrangedor.

Mas a verificação de fatos é o piso, não o teto. O uso mais interessante é fazer coisas que antes não eram possíveis. Minha agora co-autora, Kelsey Piper, recentemente pediu ao Codex que construísse um site interativo para ajudá-la a realmente entender um artigo de ciência política que estava analisando, e depois realizou a tarefa por conta própria do jeito que os participantes do estudo haviam feito. A IA não apenas comprime o tempo necessário para produzir um resultado. Ela reduz o custo do tipo de engajamento ativo que a maioria dos pesquisadores pula: construir a coisa você mesmo, testar um argumento sob pressão, reanalisar os dados da forma como os participantes o fizeram. É isso que a compreensão mais profunda de fato exige.

O mesmo se aplica à academia. Metade das apresentações da ISA que assisti em Columbus poderiam ter sido significativamente melhoradas por uma passagem rápida pelo ChatGPT: verificar a gramática, apertar os argumentos, detectar lacunas lógicas. Essas ferramentas são gratuitas ou quase gratuitas. Optar por não usá-las é uma escolha de entregar um trabalho pior do que você é capaz — especialmente se sua missão é informar o público. Mas jornalistas e acadêmicos não deveriam usar IA apenas para detectar erros de digitação em manchetes. Deveriam usá-la para construir visualizações interativas, testar argumentos e realmente compreender as coisas complicadas sobre as quais estão escrevendo.

Mas e quanto à escrita em si? Você deve ter visto uma resposta comum a quem usa IA na escrita: “Por que eu deveria ler o artigo e não o prompt que o gerou?” Parece razoável, não é? Bem, não, se você pensar um pouco.

Por que comer a refeição em vez de ler a lista de compras? Por que olhar um gráfico em vez do script em ggplot? Por que ler o livro em vez das notas do autor? O prompt não traz conhecimento novo. O resultado traz. Esse é o ponto todo. Como argumentei na Parte II, pessoas diferentes com experiências, dados e contextos diferentes (manifestados em seus arquivos claude.md) produzem resultados completamente distintos a partir do mesmo prompt. É uma questão de habilidade.

Entendo: pode parecer estranho gastar mais tempo lendo algo do que o autor gastou produzindo. Mas já passamos por isso antes. Um gráfico que levou segundos para ser gerado no R pode exigir minutos de leitura cuidadosa. Ninguém exige nem sonha em ver apenas o código em vez do gráfico. Avaliam o gráfico e o que ele diz — o conhecimento novo que antes não existia.

26. Os LLMs podem de fato produzir conhecimento novo.

Como documentado recentemente por John Burn-Murdoch, os chatbots de IA consistentemente conduzem os usuários em direção ao consenso especializado — o oposto do que as redes sociais fazem. As ferramentas não apenas ajudam a escrever melhor. Usadas ativamente, ajudam a pensar com mais cuidado.7 Dessa forma, os LLMs podem até reverter a ascensão do populismo. Mas verificar fatos não é a mesma coisa que produzir conhecimento novo.

Antes de perguntar se os LLMs conseguem produzir ideias genuinamente novas (há bons exemplos disso), deveríamos perguntar quantos humanos o fazem. A maioria dos acadêmicos passa a carreira recombinando ideias existentes em variações menores, aplicando os mesmos métodos a conjuntos de dados ligeiramente diferentes, produzindo trabalhos incrementais que ninguém fora de sua subárea jamais lerá. O pensamento original é extraordinariamente difícil e raro em qualquer geração. Não digo isso como insulto a nenhum colega (nem a mim mesmo). Mas a barra que os LLMs precisam superar é mais baixa do que gostamos de admitir.8

Meu amigo Robert Kubinec, um brilhante metodologista político e autor de ficção publicado9 na University of South Carolina, parece ser bastante cético em relação a boa parte da euforia com IA. Ele argumenta que “os LLMs nunca criam conhecimento, [que] só existe em cérebros humanos. Eles só conseguem comparar um conjunto de conhecimento com outro.” Respeito o Bob, então tudo bem discordarmos. Minha resposta: a questão filosófica sobre autoconsciência é real, mas é ortogonal à questão prática. Independentemente de o modelo “compreender” algo ou não, o resultado ou contém informação nova útil para humanos ou não contém.10

O exemplo mais sugestivo recente é o Claude Mythos, o novo modelo de fronteira da Anthropic. Em algumas semanas de testes, ele identificou milhares de vulnerabilidades de segurança até então desconhecidas nos principais sistemas operacionais e navegadores, incluindo uma que havia passado despercebida por 27 anos. Chame isso do que quiser, mas “comparar um conjunto de conhecimento com outro” não cobre bem o caso.

As melhores teorias conceituais em ciências sociais já são recombinações de ideias existentes. Anthony Downs construiu sua teoria da escolha racional transplantando a maximização de utilidade microeconômica para as votações e literalmente chamou seu livro de An Economic Theory of Democracy. Baumgartner e Jones tomaram emprestado o equilíbrio pontuado da biologia evolutiva e o aplicaram à formulação de políticas públicas. A análise de redes sociais importou integralmente a teoria dos grafos da matemática. Axelrod fundiu o dilema do prisioneiro com a seleção evolutiva por aptidão. Alexander Wendt foi ainda mais longe e aplicou a teoria quântica às relações internacionais em Quantum Mind and Social Science — um movimento que muitos consideraram (com razão) ridículo, mas que a Cambridge University Press publicou assim mesmo. As ciências sociais raramente inventam do zero. Elas traduzem entre domínios, e a tradução é a contribuição teórica.

Isso é estruturalmente idêntico ao que os LLMs fazem: recombinar padrões e conceitos entre contextos. Às vezes o resultado é nonsense. Às vezes é produtivo. O mesmo vale para a recombinação humana. A teoria quântica de Wendt em relações internacionais foi criticada como uma mera metáfora disfarçada de física, mas, como mencionado acima, a Cambridge University Press a publicou. Se isso conta como produção de conhecimento, é difícil ver por que as recombinações geradas por LLMs não contariam.

Para seu crédito, Bob concedeu o ponto prático mesmo mantendo o filosófico: “a questão é como usar essa capacidade para avançar o conhecimento.” Exatamente. Como disse na Parte I: parem de debater se os LLMs “realmente compreendem” enquanto as pessoas com mais em jogo já estão usando as ferramentas para melhorar seu trabalho.

27. Para os críticos, o modelo mental do usuário de IA está preso em 2023 — que é uma eternidade atrás.

Lembre-se de como chegamos aqui. Os estudantes se entusiasmaram com o uso de IA antes de seus professores, usando os primeiros modelos públicos e gratuitos como o ChatGPT 3.5. O resultado é que muitos professores e intelectuais ainda imaginam o usuário típico de IA como um estudante de graduação tentando trapacear em uma redação, ou como um assistente fracassando ao enviar conteúdo gerado por IA. Isso ainda pode descrever muito do uso casual de IA pelo mundo. Não descreve como os principais pesquisadores na maioria das áreas estão trabalhando com essas ferramentas, nem como qualquer pessoa que tenta usar IA de forma responsável e consciente realmente opera.

Stefan Schubert tocou melhor nesse ponto: subestimamos a racionalidade dos outros, supondo que eles aplicam novas ferramentas de forma muito mais irrefletida do que realmente fazem. Há um vasto espaço entre pedir ao ChatGPT que escreva um artigo inteiro e escrever cada palavra sozinho. Quando você escreve “por conta própria”, já está usando atalhos. Não faz pesquisa aprofundada sobre cada referência que menciona. Você pesquisa uma estatística no Google e confia no número da manchete. Você escaneia um resumo e cita o artigo. Se você tem recursos, terceiriza a verificação para um assistente de pesquisa ou um verificador de fatos. A IA permite fazer muito disso de forma mais sistemática, automatizada e barata.

Como muitos, Derek Thompson acredita com razão que escrever é pensar e que terceirizar todo o processo de escrita para a IA deixa a mente vazia. Mas, embora grande parte da escrita seja pensamento, o pensamento não se resume à escrita. Fazer arte é pensar. Conversar também é pensar. Como Dina Pisareva argumenta, formular prompts também é pensar, se você tiver um bom parceiro socrático do outro lado da troca.

Thompson também reconhece que toda escrita sempre envolveu recorrer a fontes externas para ideias, fatos, edição e verificação. A linha entre assistência legítima e terceirização ilegítima sempre foi nebulosa, e a IA não criou essa nebulosidade. Apenas tornou impossível ignorá-la. A própria conclusão de Thompson: “Devemos ser honestos e abertos sobre essa nebulosidade, em vez de declarar que todo mundo com uma janela do Claude aberta faz parte da slopclass.”

Onde isso deixa a questão da divulgação? Muitas pessoas bem-intencionadas e grandes periódicos acadêmicos sugerem a divulgação completa do uso de IA como solução. Mas a divulgação não é sustentável em termos de teoria dos jogos: quem divulga arca com custos reputacionais enquanto quem não divulga carona no sistema, de modo que o equilíbrio empurra em direção à não-divulgação. Pessoas como Megan McArdle e eu somos provas vivas desse problema. E o enquadramento mais adequado, como Ryan Briggs coloca, é que a IA complementa a expertise: assistentes de pesquisa automatizados verificando seu trabalho, formalizando argumentos à medida que avança, coletando dados sob demanda. É um multiplicador que permite que pessoas capazes pensem melhor e mais rápido.

Minha percepção é que o único caso em que a divulgação é genuinamente devida é quando o público tem uma expectativa razoável de trabalho produzido integralmente por humanos, e essa expectativa faz parte do que está pagando. A melhor analogia é um show ao vivo, no caso específico da escrita pessoal ou criativa: se você vai a um show esperando uma performance ao vivo e o artista está fazendo playback, essa é uma queixa legítima. Mais precisamente, a divulgação é devida quando a não-divulgação induziria o público ao erro sobre o que está recebendo. Um jornalista publicando sob sua assinatura está prometendo responsabilidade e originalidade, não a proveniência de cada tecla pressionada. Um memoirista promete ambas. O teste é pelo que o autor coloca seu nome, não se uma ferramenta foi utilizada.

Mas ciência e jornalismo não são shows ao vivo. Tratam de descobrir e compartilhar conhecimento novo. Ninguém divulga que usou corretor ortográfico, assistentes de pesquisa ou uma busca no Google. As normas para a escrita criativa e as artes serão diferentes — com razão, porque nesses casos o público está em parte pagando pela experiência humana de criar a coisa. As humanidades provavelmente chegarão a algum meio-termo por meio de um processo longo e contencioso, com muitas amizades sendo rompidas no caminho. Mas para pesquisa e jornalismo, “divulgar tudo” não nos leva aonde precisamos ir. O que os leitores deveriam se importar é com a precisão e com o fato de o autor assumir plena responsabilidade pelo que está na página. A proveniência é um sinal muito mais fraco do que qualquer um desses dois.

28. Ninguém sabe nada — eu incluído. Tudo bem — vamos descobrir juntos.

Inicialmente evitei falar com jornalistas sobre IA porque não sou especialista no assunto em nenhum sentido significativo. Mas estou percebendo cada vez mais que ninguém é especialista no que quer que seja tudo isso, não de verdade, e esperar que um apareça é a receita para não ter norma alguma. Ainda evito dar qualquer conselho além de instalar o Claude Code (ou a ferramenta agêntica de sua preferência) e conversar com ele para resolver um problema concreto que você tem em mãos.

Como de costume, Arthur Spirling foi direto ao ponto: as contas de acadêmicos-de-IA que constantemente oferecem “conselhos” a colegas e estudantes de doutorado, como se estivessem nos laboratórios desenvolvendo os modelos, são tediosas. São espectadores, como todos nós.11 Mesmo as pessoas nos laboratórios não têm ideia de quão bons os modelos ficarão além de alguns meses.

Portanto, estamos em uma posição desconfortável: alguém precisa começar a estabelecer as normas do novo ambiente de trabalho, e as pessoas que farão isso serão inevitavelmente pessoas que não entendem completamente aquilo para o qual estão criando normas. É estranho e desconfortável. É também como a maioria das outras transições institucionais provavelmente funcionou — só que em um ritmo muito mais lento.

Passamos por uma versão disso que parece uma eternidade atrás, quando os professores tiveram que aceitar que fiscalizar o uso de IA pelos alunos de forma plena e meticulosa não era nem produtivo nem possível. O mesmo agora vale para os pesquisadores. Você pode auditar as partes que realmente importam, como o código de replicação, e os LLMs já tornam isso mais fácil. Proveniência é a única coisa que você não pode auditar, e é a coisa na qual não deveríamos gastar energia de qualquer jeito. Você tem que seguir os incentivos e construir sistemas que garantam que as ferramentas sejam usadas bem, não fingir que não estão sendo usadas.

Em nota relacionada sobre o ensino, tenho tirado licença, então evitei dar conselhos também nessa área. Dadas as muitas perguntas que recebi, sou mais pessimista sobre os efeitos da IA no ensino do que na pesquisa. Por exemplo, embora eu use IA de forma aberta e extensiva em minha pesquisa e escrita, planejo proibir todos os dispositivos eletrônicos nas minhas aulas substantivas e retomar provas escritas e orais presenciais.

Essas não são posições contraditórias. A sala de aula é precisamente onde os alunos precisam desenvolver as habilidades cognitivas que tornam a colaboração com IA produtiva mais tarde. Você não consegue orientar uma ferramenta de IA de forma significativa se nunca aprendeu a pensar sem ela. A preocupação com a atrofia de habilidades da Parte II é mais válida aqui: os alunos precisam internalizar os fundamentos antes de terceirizá-los. A pesquisa é onde você usa as melhores ferramentas disponíveis para produzir um resultado valioso. O ensino é onde você garante que a próxima geração consiga realmente usar bem essas ferramentas.12

29. O melhor trabalho acontece quando humanos e IA colaboram.

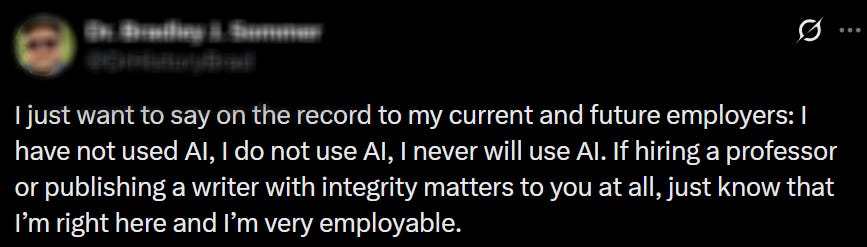

Ainda vejo muita gente se comprometendo a não usar IA em sua escrita. Isso faz tanto sentido quanto se comprometer a não aceitar ajuda de assistentes de pesquisa ou coautores. Então eu faço o compromisso oposto: vou usar os LLMs mais recentes — e, aliás, qualquer outra ferramenta disponível ou coautor humano — para melhorar ao máximo minha pesquisa ou a forma como a comunico. Dessa forma, se meu nome está nela, você pode ter certeza de que reflete meu melhor julgamento.

Muitos acadêmicos, especialmente nas humanidades, ainda parecem acreditar que importa quanto tempo você passou fazendo seu trabalho. Mas a teoria do valor-trabalho popular está errada na economia, e está errada aqui também. Se você é uma pessoa estranha que quer passar anos rodando todas as suas verificações de robustez manualmente com matrizes invertidas à mão em vez de rodar alguns comandos no R, ou traduzindo e transcrevendo manuscritos originais manualmente, isso é problema seu. Eu não me importei se aqueles professores de estudos internacionais na ISA gastaram 10 ou 100 horas em suas apresentações de slop humano. O trabalho ou é bom ou não é.

Dito isso, algumas normas valem ser estabelecidas. Quando você escreve “eu acredito” ou “eu sinto”, esse “eu” deve genuinamente ser você. O pronome “eu” carrega uma promessa implícita de uma voz humana por trás dele. Uma afirmação factual, como o nome correto da OTAN, não se importa com quem a digitou. Mas a convicção pessoal importa. Pense em um show ao vivo: o público paga por uma performance real, não por playback. Quando você usa “eu”, o leitor tem o direito de esperar que você queira dizer isso. Isso não exige ter digitado (ou ditado) cada palavra você mesmo. Você pode orientar o modelo, trabalhar a partir de suas notas e revisá-lo com cuidado, mas exige que a convicção seja sua.

Este texto, por exemplo, foi escrita de forma aberta e orgulhosa usando uma conversa iterativa de ida e volta com o Claude Code, com base em minhas ideias originais, conversas com colegas e sugestões úteis de colegas acadêmicos e não acadêmicos.13 A Parte I experimentou as capacidades da IA sem edição humana. A Parte II refletiu 100% de voz humana. A Parte III, que você está lendo agora, combina minha voz com as capacidades da IA, completando o círculo. Deixo para você decidir qual foi a melhor.

Então, onde os humanos retêm vantagem? Como Yiqing Xu argumenta, provavelmente em ambientes de fronteira aberta onde os dados de treinamento ainda não existem e em tarefas que exigem interação humana direta. Isso pode mudar em breve. Mas escolhemos essa carreira porque encontramos sentido em descobrir as coisas — não apenas porque ainda somos melhores nisso. Por isso não vejo nenhuma contradição em terceirizar a maior parte do trabalho braçal para a IA (ou para assistentes de pesquisa, se você tem valores tradicionais) e focar no que nos dá mais sentido: formular perguntas importantes sobre o mundo e respondê-las com as melhores ferramentas disponíveis.

30. O real risco na ciência é o slop humano em velocidade de IA. Ainda podemos preveni-lo.

A IA amplifica o que você traz para ela. Traga curiosidade genuína e perguntas difíceis, e a IA ajudará você a produzir algo que vale a pena ler. Traga nada, e você produzirá nada mais rápido.

Mas há motivos para otimismo. As mesmas descobertas da Nature que revelaram o quão quebrada está a reprodutibilidade também mostraram que periódicos com compartilhamento obrigatório de dados e código tinham taxas de reprodutibilidade significativamente maiores. A IA já pode acelerar isso: nada além da inércia impede que editores de periódicos instituam verificações automatizadas de reprodutibilidade e verificação obrigatória de código como condição de submissão. Esses sistemas podem ser configurados como quase-determinísticos, com muito pouca margem para erro, e os autores sempre podem contestar uma rejeição automática se acreditarem que o fluxo de trabalho agêntico interno falhou ao determinar como reproduzir seu código.

De forma mais ambiciosa, a IA reduz o custo de realizar o tipo de trabalho em grande escala e intensivo em dados que antes exigia ser Raj Chetty com uma equipe de 30 assistentes de pesquisa e acesso a todos os conjuntos de dados administrativos do país, ou ser Daron Acemoglu… com lápis e papel. Um pesquisador júnior com Codex agora pode tentar projetos que seriam logisticamente impossíveis cinco anos atrás. A barra para o que é publicado deveria subir, porque a barra para o que pode ser produzido já subiu.

O padrão não mudou: se você coloca seu nome em algo, você responde por ele. Avalie a qualidade do resultado, não o processo. A conversa sobre slop da IA é uma distração da pergunta mais difícil — a que deveríamos ter feito muito antes de os chatbots chegarem: por que toleramos tanto slop humano em primeiro lugar?

***

Meu objetivo quando publiquei a Parte I era simples: trazer para o espaço aberto a conversa que já acontecia nos bastidores e nas DMs. Mesmo assim, continuo ouvindo a mesma coisa de meus colegas: “Alex, sabemos que você usa IA, nós também usamos — mas será que você não pode simplesmente ficar quieto?”

Entendo o medo de que a IA seja usada de forma irresponsável, produzindo mais slop do que previne. Mas se você pensar bem, “fique quieto sobre isso” é simplesmente defender a hipocrisia universal como norma profissional. Parte do que eu queria era que a incerteza que todos estão experimentando sobre seus fluxos de trabalho e seus futuros chegasse a um equilíbrio mais estável. Para isso é necessária conversa honesta, não silêncio.

E já está acontecendo. Emily Oster compartilhou recentemente o conselho de Isaiah Andrews sobre IA para estudantes de doutorado em economia do MIT, chamando-o de algo que deveria ser circulado a todas as turmas de doutorado. Como Andy Hall observou, o mais importante não era nenhum conselho específico em si, mas que professores de alto perfil enviassem um sinal claro: isso é algo que você precisa levar a sério. Até mesmo Dylan Matthews, uma das pessoas mais criteriosas no jornalismo, recentemente admitiu que as pessoas pró-IA acertaram muito.

A mudança é real. Os acadêmicos já estão meio despertos, e não vão voltar atrás. Aspirantes a estudantes de pós-graduação e pesquisadores júniors devem avançar com cautela, mas abraçar plenamente o aprendizado e o uso das ferramentas de IA. Os acadêmicos, intelectuais e escritores que se recusarem a se engajar não serão recompensados por sua pureza. Simplesmente serão superados por colegas que trazem o mesmo rigor intelectual, a mesma curiosidade e ferramentas melhores.

Devo reconhecer que, juntas, aquelas duas publicações se tornaram a coisa mais amplamente lida que já escrevi (com ou sem Claude). Pessoas em conferências de imigração ou em qualquer outra área, sem mencionar administradores universitários de todo o país, agora me pedem conselhos sobre IA em vez de análises sobre imigração ou ciência política. Isso diz algo sobre o quanto levamos as coisas a sério nessa área — e também que eu deveria começar a cobrar mais pelas minhas palestras e consultorias. ↩

Não pretendo criticar a ISA de forma injusta. Os organizadores trabalhavam sob restrições reais, havia muitos painéis excelentes e acadêmicos sérios na conferência, e escrevi em outro lugar sobre formas concretas de melhorar as conferências acadêmicas. ↩

Essa é provavelmente a afirmação que recebeu mais resistência dos primeiros leitores deste texto. Alguns argumentam que meu uso de “slop” estende demais o conceito — que o slop da IA (superproduzido, polido mas vazio) e o trabalho acadêmico ruim (descuidado, subproduzido) são falhas de tipos diferentes. Normalmente detesto o esticamento conceitual na escrita científica, mas genuinamente não acho que é o que está acontecendo aqui. O que vi na ISA foi trabalho superproduzido, sem sentido, que parecia científico mas não acrescentou nada ao conhecimento humano. Isso é “slop” por qualquer definição. ↩

Posso atestar que muitas citações do meu próprio trabalho foram reinterpretações criativas do que eu realmente encontrei: conclusões simplificadas, resultados invertidos — indicando quase certamente que quem me citou não leu meu trabalho. ↩

“Papagaio estocástico” vem de um artigo de 2021 co-autorado pela linguista Emily Bender, argumentando que os grandes modelos de linguagem produzem texto prevendo sequências prováveis de palavras sem compreensão. ↩

Dean W. Ball vai ainda mais longe e argumenta que grande parte da negação da IA pela esquerda repousa em uma visão de mundo onde a indústria de tecnologia é composta de “idiotas fúteis” cujas realizações são sempre superficiais, sempre baseadas em algum grande furto. Essa heurística pode ter funcionado para as criptomoedas. Não funciona para ferramentas que milhões de pesquisadores e escritores estão usando discretamente para fazer um trabalho melhor. ↩

Digo “usadas ativamente” porque há evidências concretas de que a dependência passiva e acrítica da IA pode degradar as habilidades de pensamento crítico, especialmente em tarefas rotineiras. Essa é uma preocupação real, e é por isso que argumento abaixo que a sala de aula é onde os alunos precisam construir os fundamentos antes de terceirizá-los. ↩

Como Hollis Robbins argumentou há um ano, os únicos acadêmicos que reterão valor na era da IA são aqueles que trabalham nas fronteiras do conhecimento. Quanto mais o tempo passa, menos absurdo esse argumento parece. ↩

Vocês deveriam conferir The Bayesian Hitman. Com certeza vai sacudir suas priors. ↩

Como Alison Gopnik e colegas argumentaram recentemente na Science, os LLMs são mais bem compreendidos como tecnologias culturais — como a escrita, a imprensa e as bibliotecas — ou seja, ferramentas que permitem novas formas de produção de conhecimento mesmo que não “pensem” por si mesmos. ↩

A exceção que confirma a regra são Aniket Panjwani e Scott Cunningham, que passaram meses publicando relatos detalhados em primeira mão de como é realmente fazer pesquisa com Claude Code. Pelo menos para mim, esse tipo de texto foi genuinamente útil e fundamental para concluir minha série sobre IA. ↩

Há uma preocupação legítima aqui: estudantes de pós-graduação tentando aprender os fundamentos agora competem por espaço em periódicos com professores que têm legiões de agentes de IA. Isso é real, e é por isso que a resposta para o ensino não é “proibir a IA para sempre”. A resposta é a construção gradual de habilidades — aprenda a pensar sem a ferramenta primeiro, depois use-a com discernimento. ↩

Sou particularmente grato a Steven Adler, Ryan Briggs, Tina Marsh Dalton, Josh Gellers, Jimmy Alfonso Licon, Igor Logvinenko, Ilia Murtazashvili, Kyle Saunders, Dina Pisareva, Quinn Que ❁, Ben Radford, Mike Riggs, Hollis Robbins, Jim Walsh, Sean Westwood, Yiqing Xu e Emma Zhang pelas sugestões úteis e pelo questionamento construtivo. ↩