Vi prego di mettere mi piace, condividere, commentare e iscrivervi. Aiuta a far crescere la newsletter senza alcun contributo economico da parte vostra. Grazie per la lettura.

Nella Parte I ho sostenuto che l’IA è già in grado di fare ricerca nelle scienze sociali meglio della maggior parte dei professori. Nella Parte II ho risposto a oltre mille commenti, riconoscendo dove i critici avevano ragione e confermando la mia tesi principale: lo status quo accademico era già in crisi, e l’IA sta semplicemente accelerando i conti. In questa Parte III, scritta in collaborazione con l’IA e i miei colleghi nell’arco dell’ultimo mese, passo dalla diagnosi a ciò che gli accademici possono e non possono fare al riguardo.1

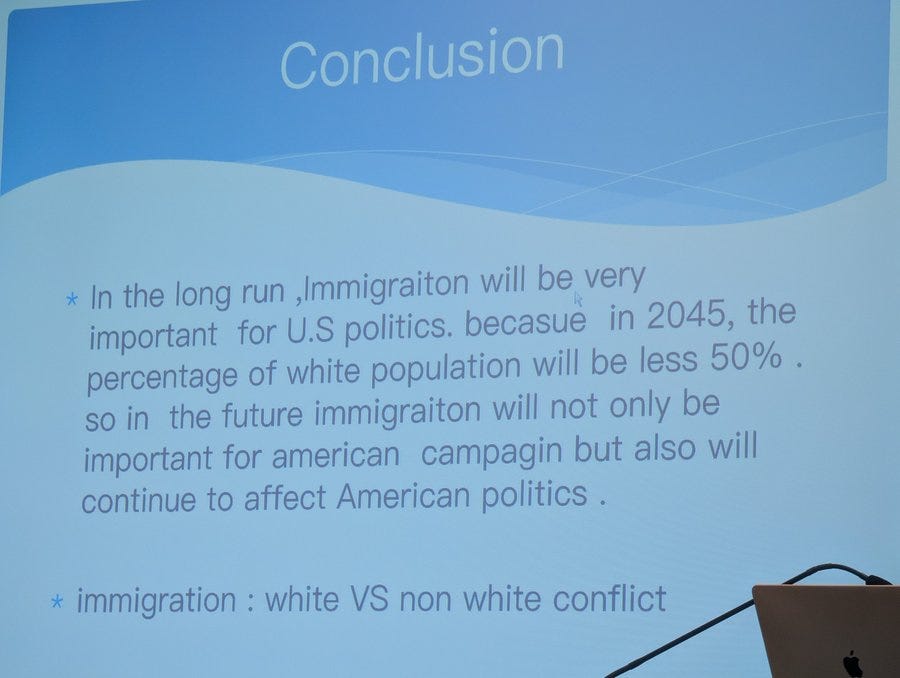

La causa prossima — piuttosto improbabile — di questo terzo capitolo sull’IA è stata la visita alla Convention Annuale 2026 dell’International Studies Association (ISA) a Columbus, Ohio, una conferenza multidisciplinare di prim’ordine frequentata dai principali professionisti degli studi internazionali a livello mondiale. O almeno così mi era stato detto. Quello che ho effettivamente visto erano presentazioni così approssimative da non superare nemmeno un C in uno qualsiasi dei miei corsi: argomenti privi di tesi o coerenza, errori grammaticali che qualsiasi correttore automatico avrebbe individuato, relatori che leggevano i propri slide come se scoprissero per la prima volta le debolezze dei propri ragionamenti. Il tutto senza alcun intervento dell’IA, per quanto potevo capire, a giudicare dalla presenza di refusi e incongruenze. Non si trattava solo di dottorandi, ma di persone con un PhD, una cattedra e fondi di ricerca.

Se il contenuto di bassa qualità generato dall’IA è la crisi di cui tutti parlano, vorrei sapere come chiamare quello che ho visto all’ISA, o alla maggior parte delle grandi conferenze di scienze sociali.2 Il contrasto era impossibile da ignorare: sedevo ad ascoltare quelle presentazioni esattamente nel momento in cui ricevevo minacce di morte e richieste di licenziamento online per aver suggerito che l’IA può fare ricerca meglio della maggior parte dei professori. Quella giustapposizione ha cristallizzato l’argomento centrale di questo articolo.

21. La maggior parte dei “contenuti di bassa qualità” è sempre stata e rimane produzione umana di bassa qualità.

La mia prima tesi è stata la cosa più provocatoria che abbia mai detto, e da allora l’ho ritoccata solo marginalmente: l’IA agentiva è già in grado di svolgere la maggior parte dei compiti di ricerca nelle scienze sociali meglio della maggior parte dei professori a livello globale. Lo confermo. Nella mia recente intervista con la Chronicle, il titolo era ancora più diretto: “AI Is a Better Researcher Than You.” Se non ci credete ancora, ne riparliamo tra qualche anno.

Ma il rovescio della medaglia è altrettanto importante. Se l’IA riesce a produrre risultati di ricerca migliori rispetto ai professori, questo costituisce anche un’accusa nei confronti dei risultati che quei professori producevano e continuano a produrre senza l’IA.

“Slop” è stata la parola dell’anno 2025 del Merriam-Webster, definita come contenuto digitale di bassa qualità prodotto dall’IA. Ma la conferenza ISA ricordava che la stragrande maggioranza dei contenuti mediocri è sempre stata di produzione umana. Il sistema delle riviste accademiche e le grandi conferenze in buona parte delle discipline umanistiche e delle scienze sociali erano fabbriche di scarto ben prima che qualcuno si abbonasse a ChatGPT. Sì, intendo davvero dire che la maggior parte della ricerca è mediocre.3

Parte di essa è anche quello che il filosofo Harry Frankfurt chiamerebbe “bullshit”: lavori indifferenti alla verità delle proprie affermazioni, soprattutto su temi politicamente sensibili come l’immigrazione, dove i ricercatori partono da conclusioni di sinistra e ragionano a ritroso. Ma la mediocrità è più ampia del bullshit. Include anche lavori che non avanzano alcuna tesi, lavori che dovrebbero avere un valore artigianale e semplicemente falliscono. Il ricercatore che trova un dataset prima di avere una domanda, poi raschia i risultati significativi da pubblicare, produce scarto. Questi ricercatori esistevano molto prima dell’IA. Erano solo più lenti.

22. Gli accademici producevano allucinazioni e imbrogli prima dell’IA.

Le preoccupazioni relative ad allucinazioni e imbrogli che le persone sollevano riguardo all’IA in ambito accademico descrivono problemi che precedono l’IA di decenni, se non di secoli. Un massiccio nuovo progetto pubblicato su Nature questo mese (al quale ho contribuito in minima parte) ha testato centinaia di articoli di scienze sociali: solo circa la metà delle affermazioni statisticamente significative si è replicata, con dimensioni degli effetti mediani ridotte drasticamente. Questo studio conferma quanto lo studio Open Science Collaboration del 2015 aveva rilevato in psicologia, dove circa due terzi dei risultati non si erano replicati, e lo estende ad altri campi.

Prima dell’IA non le chiamavamo “allucinazioni”. Le chiamavamo “scienza”. A pensarci bene, allucinazione e intuizione non sono poi così diverse. Entrambe implicano la generazione di combinazioni che vanno oltre gli input. Le chiamiamo allucinazioni quando il risultato è sbagliato, e scoperte quando è giusto.

Nel frattempo, gli accademici citano abitualmente articoli di cui hanno letto solo l’abstract.4 Almeno i tassi di allucinazione dell’IA vengono monitorati e migliorano. I tassi di allucinazione umana in accademia non vengono monitorati affatto. Li chiamiamo semplicemente “contributi alla letteratura.” E se si è revisori anonimi, non serve nemmeno allucinare per conto proprio: basta scrivere “citi pure me” e andare avanti.

Parte della ricerca è genuinamente eccellente. Ma prima di preoccuparci dell’imbroglio assistito dall’IA, ragioniamo un momento su quello umano. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely: la lista dei casi di frode di alto profilo continua a crescere, e questi sono solo coloro che sono stati scoperti. Al di là della fabbricazione vera e propria, il p-hacking, l’HARKing (ipotizzare dopo aver visto i risultati) e la segnalazione selettiva erano per anni così comuni da non essere quasi considerati come illeciti. Abbiamo fatto progressi reali nella comprensione di queste pratiche, ma restano abbastanza diffuse da condizionare ciò che viene pubblicato. E non è tutto: i professori ordinari hanno sempre messo il proprio nome su articoli scritti principalmente da dottorandi, e interi libri sono stati assemblati da team di assistenti di ricerca sotto il nome di un illustre accademico. Nulla di tutto ciò era considerato imbroglio finché l’IA non ha reso il processo più economico e più evidente.

23. La metafora del “pappagallo stocastico” descrive meglio gli esseri umani che l’IA.

Uno degli slogan più influenti nel dibattito sull’IA5 ha sempre funzionato come un cliché che tronca il pensiero. Come ha osservato Cate Hall, è una coniatura potente: piacevole da pronunciare, concettualmente efficiente, e ha colonizzato permanentemente la mente di molti, nonostante non sia vera per i modelli odierni. Un autentico capolavoro linguistico. È anche empiricamente falsa: ogni grande modello di frontiera sviluppato dopo GPT-4 è stato addestrato su input non testuali, e la logica interna dell’argomento originale richiede un addestramento solo testuale per funzionare.

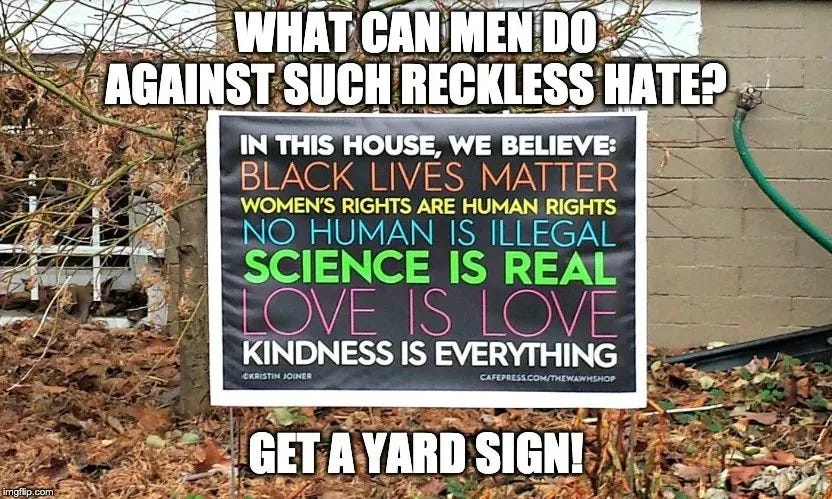

Consideriamo ora qualcosa di completamente diverso ma ancora molto familiare: i cartelli “In This House We Believe”. Science Is Real. Love Is Love. No Human Is Illegal, eccetera. Si può credere a ogni riga e non avere comunque una posizione politica coerente su nessuna di queste questioni. Cosa implica “nessun essere umano è illegale” per le politiche di applicazione della legge: confini aperti, amnistia, qualcos’altro? Il cartello non lo dice, perché dirlo richiederebbe di affrontare le contraddizioni. È un giuramento di fedeltà, non un argomento.

Molti hanno preso in giro questo cartello nel corso degli anni.

Ma il punto più profondo è che si tratta esattamente di ciò per cui l’IA viene criticata: produrre affermazioni superficiali e consolatorie che comunicano appartenenza piuttosto che significato. Si scopre che gli esseri umani lo fanno con o senza l’IA da quando abbiamo avuto dei prati su cui piantare cartelli.

Il cartello non è un caso isolato. È il modo in cui la maggior parte delle persone sembra affrontare la maggior parte dei temi: adottare la posizione del proprio gruppo, ripeterla e andare avanti. La sostanza di ciò che si argomenta conta molto di più del modo in cui la si inquadra, ma il framing è più facile, il che spiega perché domina il discorso pubblico, dai thread su Twitter alle presentazioni a conferenza.

L’ho visto in prima persona all’ISA, dove colleghi con cattedra presentavano lavori che equivalevano all’equivalente accademico di un cartello da giardino, corredati da qualche regressione mal identificata per dargli la patina della scienza. La critica del pappagallo stocastico era pensata per sminuire l’IA. È finita per essere una descrizione migliore della vita intellettuale umana di quanto chiunque avesse previsto.

24. Sì, gli adulti consenzienti possono usare l’IA per scrivere. Controllarla non funziona.

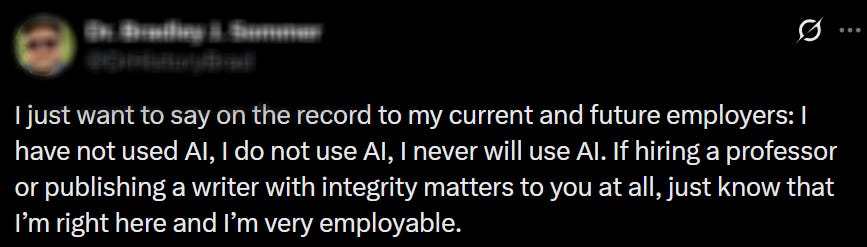

Nella Parte II ho notato che i rilevatori di IA spesso non sono molto utili e creano più problemi di quanti ne risolvano. Ma il problema più profondo è l’impulso che li anima: la convinzione che il coinvolgimento dell’IA sia intrinsecamente contaminante, indipendentemente da ciò che produce. Quinn Que avanza un caso affascinante secondo cui l’ossessione per i rilevatori di scrittura dell’IA è analoga all’applicazione di una “one-drop rule”, il principio della classificazione razziale americana del XIX secolo: qualsiasi traccia di IA contamina l’intero lavoro, indipendentemente dalla qualità o dall’intenzione dell’autore.

Ero inizialmente scettico sull’analogia, ma è piuttosto calzante. Nella visione dell’attivista anti-IA, qualsiasi parola che non si sia scritta da soli è un inquinamento morale. Anche se usare l’IA per scrivere non è tecnicamente “illegale”, vige sostanzialmente una one-drop rule nel determinare se si è uno scrittore legittimo o un impostore, una persona per bene o una persona cattiva. Di qui le condanne e le minacce di morte verso persone come me che dichiarano il proprio uso dell’IA per “aver esternalizzato il loro pensiero alla macchina.”

Come ho sostenuto nella Parte I, gran parte dell’opposizione all’IA è protezione dello status camuffata da principio. Andy Masley va oltre, sostenendo che il panico morale sui chatbot possa avere una radice che va al di là della difesa dello status. Questa radice è qualcosa di più vicino alla superstizione (“i chatbot sono demoniaci”): la sensazione che il testo prodotto dall’IA sia spiritualmente contaminato, che ci sia qualcosa di sbagliato o addirittura di malvagio in una macchina in grado di scrivere, indipendentemente da ciò che scrive.6

Anche Megan McArdle, che di recente ha dichiarato onorevolmente il proprio uso dell’IA suscitando tra i giornalisti la stessa conversazione che gli accademici avevano avuto su Bluesky qualche mese prima, si è sentita costretta a difendersi insistendo sul fatto che “l’IA non ha toccato il testo finale”. La ammiro per essersi esposta. Ma perché la questione del testo finale dovrebbe essere un problema? Se il lavoro è buono e il processo è dichiarato, il resto è preferenza estetica mascherata da etica. Da dove inizia l’impurità? Google search? Il correttore automatico? Il controllo ortografico? Le trascrizioni?

E anche mettendo da parte tutto questo: a meno di uno scenario alla Dune, con una catastrofe dell’IA seguita da un accordo dell’umanità per bandire la tecnologia, la scrittura non-fiction ampiamente assistita dall’IA è quasi inevitabile in equilibrio, dati gli incentivi esistenti. Vale la pena menzionare anche il rovescio della medaglia: anche se riuscite a scrivere bene del tutto autonomamente senza “inquinamento dell’IA”, nessuno vi premierà presto per quella purezza.

25. Non usare i più recenti strumenti di IA nella propria ricerca e nella propria scrittura è una negligenza.

Matthew Yglesias ha recentemente sostenuto che i modelli linguistici di grandi dimensioni sono sottoutilizzati nel giornalismo. Il suo ragionamento si applica anche agli accademici: lo scopo della ricerca è l’output utile, non il processo mediato dall’essere umano. Il rigore deve stare nel pensiero e nella verifica, non nel fatto che sia un essere umano o una macchina ad aver digitato le frasi o premuto invio quando si eseguono le regressioni in R. Come Hollis Robbins ha ben detto, i professori dovrebbero probabilmente testare i modelli di IA prima di colazione (sostanzialmente fare come Scott Cunningham).

L’uso più banale dell’IA è l’individuazione degli errori. Si consideri il titolo del New York Times del 3 aprile 2026: “A North American Treaty Organization Without America?” Il nome corretto è, naturalmente, North Atlantic Treaty Organization. Il Times ha pubblicato una rettifica il giorno seguente. Alcuni hanno ipotizzato che l’errore fosse causato dall’IA. Non lo sapremo mai, e francamente non importa. Qualsiasi workflow LLM sufficientemente efficiente avrebbe individuato l’errore in pochi secondi. Una semplice procedura automatica per tutti i titoli — “Questo contiene errori? Verificare su due fonti separate” — avrebbe risparmiato al Times un intero ciclo di notizie imbarazzante.

Ma il fact-checking è il minimo, non il massimo. L’uso più interessante consiste nel fare cose che prima erano impossibili. La mia ormai co-autrice Kelsey Piper ha di recente fatto costruire a Codex un sito web interattivo per aiutarla a comprendere davvero un articolo di scienza politica che stava revisionando, e poi ha eseguito il compito da sola nel modo in cui i partecipanti allo studio lo avevano fatto. L’IA non comprime solo il tempo necessario a produrre un output. Abbassa il costo del tipo di coinvolgimento attivo che la maggior parte dei ricercatori salta: costruire la cosa da soli, mettere alla prova un argomento, rieseguire un’analisi nel modo in cui i partecipanti l’hanno svolta. È questo che richiede una comprensione più profonda.

Lo stesso vale per l’accademia. La metà delle presentazioni ISA a cui ho assistito a Columbus avrebbe potuto essere migliorata significativamente con un rapido passaggio attraverso ChatGPT: verifica della grammatica, stringere gli argomenti, colmare le lacune logiche. Questi strumenti sono gratuiti o quasi. Scegliere di non usarli significa scegliere di produrre un lavoro peggiore di quello di cui si è capaci, soprattutto se la propria missione è informare il pubblico. Ma giornalisti e accademici non dovrebbero usare l’IA solo per correggere i refusi nei titoli. Dovrebbero usarla per costruire visualizzazioni interattive, mettere alla prova gli argomenti e capire davvero le cose complicate di cui scrivono.

Ma che dire della scrittura in sé? Avrete forse visto una risposta comune a chiunque usi l’IA nella propria scrittura: “Perché dovrei leggere l’articolo invece del prompt che lo ha generato?” Suona ragionevole, vero? Beh, no, a pensarci un po’.

Perché mangiare il piatto invece di leggere la lista della spesa? Perché guardare un grafico invece dello script ggplot? Perché leggere il libro invece degli appunti dell’autore? Il prompt non fornisce nuove conoscenze. L’output sì. Questo è il punto. Come ho sostenuto nella Parte II, persone diverse con competenze, dati e contesti diversi (così come si manifesta nei propri file claude.md) producono output completamente diversi dallo stesso prompt. È una questione di abilità.

Lo capisco: può sembrare strano dedicare più tempo a leggere qualcosa di quanto l’autore abbia impiegato a produrlo. Ma ci siamo già passati. Un grafico che ha richiesto pochi secondi per essere generato in R può richiedere minuti per essere letto attentamente. Nessuno chiede o fantastica di vedere solo il codice invece del grafico. Si valuta il grafico e ciò che dice — la nuova conoscenza che prima non esisteva.

26. Gli LLM possono effettivamente produrre nuova conoscenza.

Come documentato di recente da John Burn-Murdoch, i chatbot di IA orientano costantemente gli utenti verso il consenso degli esperti, al contrario di quanto fa il social media. Questi strumenti non aiutano solo a scrivere meglio. Usati attivamente, aiutano a pensare con più attenzione.7 In questo modo, gli LLM potrebbero persino invertire la crescita del populismo. Ma il fact-checking non è la stessa cosa del produrre nuova conoscenza.

Prima di chiederci se gli LLM possano produrre idee genuinamente nuove (esistono buoni esempi in tal senso), dovremmo chiederci quanti esseri umani lo fanno. La maggior parte degli accademici trascorre la propria carriera ricombinando idee esistenti in variazioni minori, applicando gli stessi metodi a dataset leggermente diversi, producendo lavori incrementali che nessuno al di fuori della propria sottodisciplina leggerà mai. Il pensiero originale è straordinariamente difficile e raro in qualsiasi generazione. Non lo dico come insulto ai miei colleghi (o a me stesso). Ma la soglia che gli LLM devono superare è più bassa di quanto ci piaccia ammettere.8

Il mio amico Robert Kubinec, brillante metodologa politico e autore di narrativa pubblicata9 all’University of South Carolina, sembra essere piuttosto scettico riguardo a gran parte dell’entusiasmo sull’IA. Sostiene che “gli LLM non creano mai conoscenza, [la quale] esiste solo nei cervelli umani. Possono solo confrontare un insieme di conoscenze con un altro.” Ho rispetto per Bob, quindi va bene se non siamo d’accordo. La mia risposta: la questione filosofica sulla consapevolezza è reale, ma è ortogonale a quella pratica. Che il modello “comprenda” o meno qualcosa, l’output contiene o non contiene nuove informazioni utili agli esseri umani.10

L’esempio più suggestivo recente è Claude Mythos, il nuovo modello di frontiera di Anthropic. In poche settimane di test, ha identificato migliaia di vulnerabilità di sicurezza precedentemente sconosciute nei principali sistemi operativi e browser, inclusa una rimasta non rilevata per 27 anni. Qualunque cosa si voglia chiamarlo, “confrontare un insieme di conoscenze con un altro” non rende pienamente giustizia.

Le migliori teorie concettuali nelle scienze sociali sono già ricombinazioni di idee esistenti. Anthony Downs ha costruito la sua teoria della scelta razionale trapiantando la massimizzazione dell’utilità microeconomica nel voto, chiamando letteralmente il suo libro An Economic Theory of Democracy. Baumgartner e Jones hanno preso in prestito l’equilibrio punteggiato dalla biologia evoluzionistica e lo hanno applicato al processo decisionale delle politiche pubbliche. L’analisi delle reti sociali ha importato la teoria dei grafi direttamente dalla matematica. Axelrod ha fuso il dilemma del prigioniero con la selezione della fitness evolutiva. Alexander Wendt ha fatto di più e ha applicato la teoria quantistica alle relazioni internazionali in Quantum Mind and Social Science — una mossa che molti hanno trovato (giustamente) ridicola, ma che la Cambridge University Press ha comunque pubblicato. Le scienze sociali raramente inventano dal nulla. Traducono attraverso i domini, e la traduzione è il contributo teorico.

Questo è strutturalmente identico a ciò che fanno gli LLM: ricombinare pattern e concetti in contesti diversi. A volte il risultato è insensato. A volte è produttivo. Lo stesso vale per la ricombinazione umana. La IR quantistica di Wendt è stata criticata come una mera metafora travestita da fisica, ma come accennato sopra, la Cambridge University Press l’ha pubblicata. Se questo conta come produzione di conoscenza, è difficile capire perché le ricombinazioni generate dagli LLM non lo sarebbero.

Con il suo caratteristico rigore intellettuale, Bob ha concesso il punto pratico pur mantenendo quello filosofico: “la questione è come usare questa capacità per far avanzare la conoscenza.” Esattamente. Come ho detto nella Parte I, smettete di discutere se gli LLM “comprendano davvero” mentre le persone con più in gioco usano già gli strumenti per migliorare il loro lavoro.

27. Per i critici, il modello mentale di un utente di IA è fermo al 2023, che è un’era fa.

Ricordiamo come siamo finiti in questo pasticcio. Gli studenti si sono entusiasmati all’uso dell’IA prima dei loro professori, usando i primissimi modelli pubblici e gratuiti come ChatGPT 3.5. Il risultato è che molti professori e intellettuali immaginano ancora il tipico utente di IA come uno studente universitario che cerca di imbrogliare in un tema o come un assistente che consegna contenuti di bassa qualità generati dall’IA. Questo potrebbe ancora descrivere molti usi casuali dell’IA nel mondo. Non descrive il modo in cui i principali ricercatori nella maggior parte dei campi lavorano con questi strumenti, né il modo in cui chiunque cerchi di usare l’IA in modo responsabile e consapevole opera davvero.

Stefan Schubert ha colto questo aspetto meglio di tutti: sottovalutiamo la razionalità degli altri, assumendo che applichino nuovi strumenti in modo molto più meccanico di quanto non facciano realmente. C’è uno spazio vastissimo tra chiedere a ChatGPT di scrivere un intero articolo e scrivere da soli ogni singola parola. Quando scrivete “da soli”, usate già delle scorciatoie. Non fate ricerche approfondite su ogni riferimento che fate. Cercate una statistica su Google e vi fidate del numero nel titolo. Scorrete un abstract e citate l’articolo. Se avete risorse, esternalizzate la verifica a un assistente di ricerca o a un fact-checker. L’IA vi permette di fare gran parte di questo in modo più sistematico, automatizzato ed economico.

Come molti, Derek Thompson ritiene giustamente che scrivere sia pensare e che esternalizzare completamente il processo di scrittura all’IA lasci la mente vuota. Ma, sebbene molta scrittura sia pensiero, il pensiero non è solo scrittura. Fare arte è pensiero. Anche parlare è pensiero. Come sostiene Dina Pisareva, anche il prompting è pensiero, se si ha un buon interlocutore socratico dall’altra parte dello scambio.

Thompson riconosce anche che tutta la scrittura ha sempre implicato il ricorrere a idee, fatti, revisioni e fact-checking esterni alla mente dello scrittore. Il confine tra assistenza legittima ed esternalizzazione illegittima è sempre stato sfumato, e l’IA non ha creato quella sfumatura. L’ha solo resa impossibile da ignorare. La conclusione di Thompson: “Dovremmo essere onesti e aperti riguardo alla sfumatura piuttosto che dichiarare chiunque abbia una finestra di Claude aperta parte della slopclass.”

Dove ci lascia questo sul tema della trasparenza? Molti colleghi validi e importanti riviste accademiche suggeriscono una dichiarazione completa dell’uso dell’IA come soluzione. Ma la dichiarazione non è sostenibile in senso ludico: chi dichiara sopporta costi reputazionali mentre chi non dichiara ottiene vantaggi gratuiti, quindi l’equilibrio spinge verso la non-dichiarazione. Persone come Megan McArdle e io ne siamo la prova vivente. E il framing migliore, come dice Ryan Briggs, è che l’IA complementa l’expertise: RA automatizzati che verificano il vostro lavoro, formalizzano argomenti mentre procedete, raccolgono dati su richiesta. È un moltiplicatore che consente alle persone capaci di pensare meglio e più velocemente.

Il mio senso è che l’unico caso in cui la dichiarazione è genuinamente dovuta è quando il pubblico ha una ragionevole aspettativa di un lavoro interamente prodotto da esseri umani, e tale aspettativa fa parte di ciò per cui sta pagando. La migliore analogia è un concerto dal vivo nel caso specifico della scrittura personale o creativa: se si va aspettandosi una performance dal vivo e l’artista sta cantando in playback, è una lamentela legittima. Più precisamente, la dichiarazione è dovuta quando la non-dichiarazione indurrebbe in errore il pubblico riguardo a ciò che sta ricevendo. Un giornalista che pubblica sotto un byline promette responsabilità e originalità, non la provenienza dei tasti premuti. Un memoirista promette entrambe. Il test è ciò su cui l’autore mette il proprio nome, non se uno strumento è stato coinvolto.

Ma la scienza e il giornalismo non sono spettacoli dal vivo. Si tratta di scoprire e condividere nuova conoscenza. Nessuno dichiara di aver usato il correttore ortografico, assistenti di ricerca o una ricerca su Google. Le norme per la scrittura creativa e artistica saranno diverse, giustamente, perché lì il pubblico paga in parte per l’esperienza umana del fare la cosa. Le discipline umanistiche probabilmente troveranno una posizione intermedia attraverso un processo lungo e contenzioso, con molte amicizie che si romperanno. Ma per la ricerca e il giornalismo, “dichiarare tutto” non ci porta dove dobbiamo arrivare. Ciò che i lettori dovrebbero avere a cuore è l’accuratezza e il fatto che l’autore si assuma piena responsabilità per ciò che è sulla pagina. La provenienza è un segnale molto più debole di entrambi.

28. Nessuno sa niente, incluso me. Va bene così — lo capiremo insieme.

Inizialmente evitavo di parlare con i giornalisti dell’IA perché non sono un esperto in alcun senso significativo. Ma mi rendo conto sempre di più che nessuno è davvero un esperto di tutto questo, non veramente, e aspettare che ne appaia uno è il modo in cui ci si ritrova senza norme. Continuo a evitare di dare consigli al di là dell’installare Claude Code (o lo strumento agentivo di propria scelta) e di parlargli per risolvere un problema concreto.

Come al solito, Arthur Spirling è stato diretto su questo punto: i profili accademici sull’IA che offrono costantemente “consigli” ai colleghi e ai dottorandi, come se fossero nei laboratori a sviluppare i modelli, sono noiosi. Sono spettatori, come il resto di noi.11 Anche le persone nei laboratori non sanno quanto miglioreranno i modelli oltre qualche mese.

Ci troviamo quindi in una posizione scomoda: qualcuno deve iniziare a stabilire le norme del nuovo ambiente di lavoro, e chi lo fa sarà inevitabilmente qualcuno che non capisce pienamente per cosa sta stabilendo norme. È strano e scomodo. È anche il modo in cui probabilmente hanno funzionato la maggior parte delle altre transizioni istituzionali, solo a un ritmo molto più lento.

Ne abbiamo attraversata una versione che sembra un’era fa, quando i professori hanno dovuto accettare che monitorare pienamente e meticolosamente l’uso dell’IA da parte degli studenti non fosse né produttivo né possibile. Lo stesso vale ora per i ricercatori. Si può verificare le parti che contano davvero, come il codice di replicazione, e gli LLM lo rendono già più facile. La provenienza è l’unica cosa che non si può verificare, ed è quella su cui non dovremmo spendere energie comunque. Bisogna seguire gli incentivi e costruire sistemi che garantiscano che gli strumenti vengano usati bene, non fingere che non vengano usati affatto.

Su una nota correlata riguardo all’insegnamento: ero in congedo, quindi ho evitato anche di dare consigli qui. Date le numerose domande che ho ricevuto, sono più pessimista riguardo agli effetti dell’IA sull’insegnamento che sulla ricerca. Per esempio, pur usando l’IA apertamente ed estensivamente nella mia ricerca e scrittura, intendo vietare tutti i dispositivi elettronici nei miei corsi sostanziali e reintrodurre gli esami scritti e orali in presenza.

Non sono posizioni contraddittorie. L’aula è precisamente il luogo in cui gli studenti devono sviluppare le competenze cognitive che rendono produttiva la collaborazione con l’IA in seguito. Non si può guidare in modo significativo uno strumento di IA se non si è mai imparato a pensare senza di esso. Il problema dell’atrofia delle competenze citato nella Parte II è più valido qui: gli studenti devono interiorizzare i fondamentali prima di esternalizzarli. La ricerca è il luogo in cui si impiegano i migliori strumenti disponibili per produrre un risultato degno. L’insegnamento è il luogo in cui ci si assicura che la prossima generazione sappia effettivamente usare bene quegli strumenti.12

29. Il lavoro migliore avviene quando esseri umani e IA collaborano.

Vedo ancora molti colleghi che si impegnano a non usare l’IA nella propria scrittura. Questo è sensato quanto impegnarsi a non accettare l’aiuto di assistenti di ricerca o co-autori. Quindi, mi impegno nell’opposto: userò gli LLM più recenti, e per questo qualsiasi altro strumento disponibile o co-autore umano, per migliorare al meglio la mia ricerca o il modo in cui la comunico. In questo modo, se il mio nome è sopra, si può essere certi che riflette il mio miglior giudizio personale.

Molti accademici, soprattutto nelle discipline umanistiche, sembrano ancora credere che conti quante ore si dedica al proprio lavoro. Ma la teoria del lavoro del valore nella versione popolare è sbagliata in economia, ed è sbagliata anche qui. Se siete dei tipi particolari che vogliono trascorrere anni a eseguire tutte le verifiche di robustezza manualmente con matrici invertite a mano invece di eseguire pochi comandi R, o a tradurre o trascrivere manualmente manoscritti originali, è una vostra scelta. A me non importava molto se quei professori di studi internazionali all’ISA avessero dedicato 10 o 100 ore alle loro presentazioni di bassa qualità umana. Il lavoro o è buono o non lo è.

Detto questo, ci sono alcune norme che vale la pena stabilire. Quando si scrive “credo” o “sento”, quella prima persona dovrebbe essere genuinamente la propria. Il pronome “io” porta con sé una promessa implicita di una voce umana dietro di esso. Un’affermazione fattuale, come il nome corretto della NATO, non si preoccupa di chi l’ha digitata. Ma la convinzione personale sì. Pensate a un concerto dal vivo: il pubblico paga per una performance reale, non per un playback. Quando si usa “io”, il lettore ha il diritto di aspettarsi che lo si intenda davvero. Questo non richiede di digitare (o dettare) letteralmente ogni parola. Si può guidare il modello, lavorare dai propri appunti e rileggerlo attentamente, ma richiede che la convinzione sia propria.

Questo articolo, per esempio, è stato scritto apertamente e con orgoglio attraverso una conversazione iterativa di scambio con Claude Code, basata sulle mie idee originali, le conversazioni con i colleghi e i suggerimenti utili di colleghi accademici e non accademici.13 La Parte I ha sperimentato le capacità dell’IA senza editing umano. La Parte II rifletteva con voce 100% umana. La Parte III, che state leggendo ora, combina la mia voce con le capacità dell’IA, completando il cerchio. Vi lascio giudicare quale sia stata la migliore.

Dunque, dove conservano un vantaggio gli esseri umani? Come sostiene Yiqing Xu, probabilmente negli ambienti aperti dove i dati di addestramento non esistono ancora e nei compiti che richiedono interazione umana diretta. Questo potrebbe cambiare presto. Ma abbiamo scelto questa carriera perché troviamo significato nello scoprire le cose, non solo perché siamo ancora migliori in questo. È per questo che non vedo alcuna contraddizione nell’esternalizzare all’IA la maggior parte del lavoro di routine (o agli RA, se si preferisce l’approccio tradizionale) e concentrarsi su ciò che ci dà più significato: formulare domande importanti sul mondo e rispondervi con i migliori strumenti disponibili.

30. Il vero rischio nella scienza è la mediocrità umana alla velocità dell’IA. Possiamo ancora prevenirlo.

L’IA amplifica tutto ciò che le si porta. Portatele vera curiosità e domande difficili, e l’IA vi aiuterà a produrre qualcosa che valga la pena leggere. Non portategli nulla, e produrrete nulla più velocemente.

Ma ci sono ragioni per essere ottimisti. Gli stessi risultati di Nature che hanno rivelato quanto sia compromessa la riproducibilità hanno anche mostrato che le riviste con condivisione obbligatoria di dati e codici avevano tassi di riproducibilità significativamente più alti. L’IA può già accelerare questo processo: nulla se non l’inerzia impedisce agli editori di riviste di istituire verifiche automatizzate della riproducibilità e verifica obbligatoria del codice come condizione di invio. Questi sistemi possono essere impostati in modo quasi deterministico, con pochissimo margine di errore, e gli autori possono sempre contestare un rifiuto automatico se ritengono che il workflow agentivo interno non abbia saputo determinare come riprodurre il loro codice.

In modo più ambizioso, l’IA abbassa il costo di fare il tipo di lavoro su larga scala e ad alta intensità di dati che un tempo richiedeva di essere Raj Chetty con un team di 30 assistenti di ricerca e accesso a ogni dataset amministrativo del paese, o essere Daron Acemoglu… con carta e matita. Uno studioso junior con Codex può ora tentare progetti che sarebbero stati logisticamente impossibili cinque anni fa. La soglia per ciò che viene pubblicato dovrebbe alzarsi, perché la soglia per ciò che può essere prodotto si è già alzata.

Lo standard non è cambiato: se ci metti il nome sopra, ne sei responsabile. Valuta la qualità dell’output, non il processo. La conversazione sui contenuti di bassa qualità generati dall’IA è una distrazione dalla domanda più difficile, quella che avremmo dovuto porci molto prima dell’arrivo dei chatbot: perché abbiamo tollerato così tanta mediocrità umana in primo luogo?

***

Il mio obiettivo quando ho pubblicato la Parte I era semplice: portare la conversazione che si svolgeva già dietro le porte chiuse e nei messaggi privati allo scoperto. Eppure continuo a sentire la stessa cosa dai miei colleghi: “Alex, sappiamo che usi l’IA, lo facciamo anche noi, ma non potresti semplicemente stare zitto?”

Capisco la paura che l’IA venga usata in modo irresponsabile, producendo più scarto di quanto ne prevenga. Ma se ci si pensa, “stai zitto” significa solo sostenere l’ipocrisia universale come norma professionale. Parte di ciò che volevo era che l’incertezza che tutti stanno vivendo riguardo ai propri flussi di lavoro e al proprio futuro raggiungesse un equilibrio più stabile. Questo richiede una conversazione onesta, non il silenzio.

E sta già accadendo. Emily Oster ha recentemente condiviso i consigli di Isaiah Andrews sull’IA per i dottorandi in economia al MIT, descrivendoli come qualcosa che dovrebbe essere distribuito a tutte le coorti di dottorato. Come ha notato Andy Hall, la cosa più importante non era nessun consiglio specifico in sé, ma il fatto che docenti di alto profilo inviassero un segnale chiaro: questo è qualcosa che bisogna prendere sul serio. Anche Dylan Matthews, una delle persone più riflessive nel giornalismo, ha recentemente ammesso che le persone favorevoli all’IA hanno avuto spesso ragione.

Il cambiamento è reale. Gli accademici si stanno già svegliando a metà, e non torneranno indietro. Gli aspiranti dottorandi e gli studiosi junior dovrebbero procedere con cautela ma abbracciare pienamente l’apprendimento e l’uso degli strumenti di IA. Gli studiosi, gli intellettuali e gli scrittori che si rifiuteranno di confrontarsi non verranno premiati per la loro purezza. Saranno semplicemente superati dai colleghi che portano lo stesso rigore intellettuale, la stessa curiosità e strumenti migliori.

Devo riconoscere che, insieme, quei due post sono diventati la cosa più letta che abbia mai scritto (con o senza Claude). Persone a conferenze sull’immigrazione o in altri ambiti, per non parlare degli amministratori universitari di tutto il paese, ora mi chiedono consigli sull’IA invece di prendere posizione sull’immigrazione o sulla scienza politica. Questo dice qualcosa su quanto prendiamo sul serio le cose in questo campo, e anche che dovrei iniziare a far pagare di più per i miei interventi e le mie consulenze. ↩

Non voglio prendere di mira ingiustamente l’ISA. Gli organizzatori lavoravano sotto vincoli reali, c’erano molti panel ottimi e studiosi seri alla conferenza, e ho scritto altrove di modi concreti per rendere migliori le conferenze accademiche. ↩

Questa è probabilmente l’affermazione che ha ricevuto più resistenza dai primi lettori di questo articolo. Alcuni sostengono che il mio uso di “slop” estenda il concetto troppo lontano, che lo slop dell’IA (sovra-prodotto, rifinito ma vuoto) e il lavoro accademico scadente (negligente, sotto-prodotto) siano modalità di fallimento diverse. Di solito detesto lo stretching concettuale nella scrittura scientifica, ma davvero non penso che sia ciò che sta accadendo qui. Quello che ho visto all’ISA era lavoro sovra-prodotto e privo di senso che sembrava scientifico ma non aggiungeva nulla alla conoscenza umana. Questa è “mediocrità” per qualsiasi definizione. ↩

Posso attestare che molte citazioni del mio lavoro sono state reinterpretazioni creative di ciò che ho effettivamente trovato: risultati semplificati, conclusioni invertite, il che indica quasi certamente che coloro che mi hanno citato non hanno letto il mio lavoro. ↩

“Pappagallo stocastico” viene da un articolo del 2021 co-autore della linguista Emily Bender, che sostiene che i modelli linguistici di grandi dimensioni producono testo prevedendo probabili sequenze di parole senza comprensione. ↩

Dean W. Ball va ancora oltre e sostiene che gran parte del negazionismo sull’IA da sinistra si basa su una visione del mondo in cui l’industria tecnologica è composta da “sciocchi superficiali” i cui risultati sono sempre superficiali, sempre basati su qualche grande furto. Questa euristica potrebbe aver funzionato per le criptovalute. Non funziona per strumenti che milioni di ricercatori e scrittori stanno usando silenziosamente per fare un lavoro migliore. ↩

Dico “usati attivamente” perché ci sono prove reali che il ricorso passivo e acritico all’IA può degradare le capacità di pensiero critico, soprattutto per i compiti di routine. È una preoccupazione reale, ed è per questo che sostengo di seguito che l’aula è il luogo in cui gli studenti devono costruire le fondamenta prima di esternalizzarle. ↩

Come sosteneva Hollis Robbins un anno fa, gli unici accademici che manterranno valore nell’era dell’IA sono quelli che lavorano alle frontiere della conoscenza. Con il passare del tempo, quell’argomento sembra sempre meno scandaloso. ↩

Dovreste dare un’occhiata a the Bayesian Hitman. Rimetterà in discussione le vostre certezze. ↩

Come Alison Gopnik e colleghi hanno recentemente sostenuto su Science, gli LLM vanno compresi al meglio come tecnologie culturali, come la scrittura, la stampa e le biblioteche, ossia strumenti che consentono nuove forme di produzione della conoscenza anche se non “pensano” da soli. ↩

L’eccezione che conferma la regola sono Aniket Panjwani e Scott Cunningham, che hanno trascorso mesi a pubblicare resoconti dettagliati in prima persona di come appaia concretamente fare ricerca con Claude Code. Almeno per me quel tipo di scritto è stato genuinamente utile e determinante per portare a termine la mia serie sull’IA. ↩

C’è una preoccupazione fondata che si nasconde qui: i dottorandi che cercano di apprendere i fondamentali competono ora per lo spazio sulle riviste con professori che dispongono di legioni di agenti IA. È reale, ed è per questo che la risposta sull’insegnamento non è “vietare l’IA per sempre.” La risposta è la gradualità: imparare prima a pensare senza lo strumento, poi usarlo con giudizio. ↩

Sono particolarmente grato a Steven Adler, Ryan Briggs, Tina Marsh Dalton, Josh Gellers, Jimmy Alfonso Licon, Igor Logvinenko, Ilia Murtazashvili, Kyle Saunders, Dina Pisareva, Quinn Que ❁, Ben Radford, Mike Riggs, Hollis Robbins, Jim Walsh, Sean Westwood, Yiqing Xu ed Emma Zhang per i loro utili suggerimenti e le loro obiezioni. ↩