من فضلك أعجب وشارك وعلّق واشترك. هذا يساعد على تنمية النشرة دون أي مساهمة مالية منك. شكراً لقراءتك.

في الجزء الأول، جادلت بأن الذكاء الاصطناعي يستطيع بالفعل إجراء أبحاث العلوم الاجتماعية بصورة أفضل من معظم الأساتذة. وفي الجزء الثاني، تفاعلت مع أكثر من ألف ردٍّ، معترفاً حيث كان المنتقدون على حق، مع تمسكي بادعائي الرئيسي: إن الوضع الراهن الأكاديمي كان مختلاً أصلاً، والذكاء الاصطناعي يُجبرنا فحسب على المواجهة.1 في هذا الجزء الثالث، الذي كُتب بالتعاون مع الذكاء الاصطناعي وزملائي على مدى الشهر الماضي، أنتقل من التشخيص إلى ما يمكن للأكاديميين وما لا يمكنهم فعله حيال ذلك فعلاً.

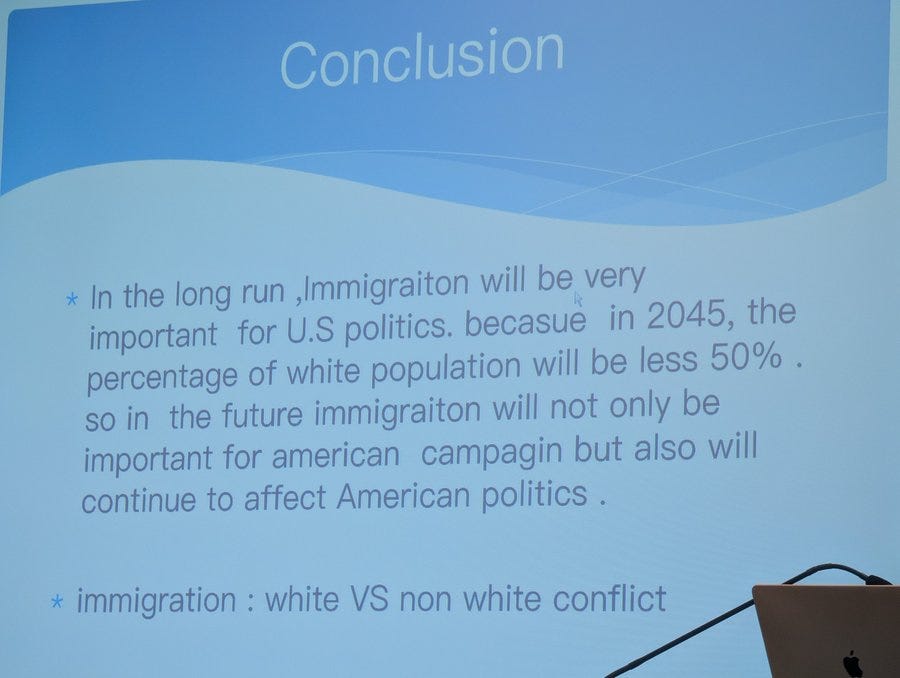

كان السبب المباشر المستبعَد لهذا الجزء الثالث حول الذكاء الاصطناعي هو حضوري المؤتمر السنوي لجمعية الدراسات الدولية (ISA) عام 2026 في كولومبوس بولاية أوهايو — وهو مؤتمر متعدد التخصصات يضم كبار المتخصصين في الدراسات الدولية حول العالم. هكذا قيل لي على الأقل. أما ما شهدته فعلاً فكان عروضاً تقديمية متقطعة بالكاد تستحق درجة C في أي من مساقاتي: حجج بلا أطروحة ولا تماسك، وأخطاء نحوية يلتقطها أي مدقق إملائي، ومقدمون يقرؤون من شرائحهم كأنهم يواجهون حججهم الرديئة للمرة الأولى. وكل ذلك دون أي تدخل للذكاء الاصطناعي على ما يبدو، بدليل الأخطاء المطبعية والتناقضات. لم يكن هؤلاء طلاباً جدداً، بل أشخاص يحملون درجات الدكتوراه والتثبيت الوظيفي وميزانيات البحث.

إن كان المحتوى الرديء الجودة (AI slop) هو الأزمة التي يحذر منها الجميع، فأودّ أن أعرف ماذا ينبغي أن يُسمى ما شهدته في ISA أو في معظم المؤتمرات الكبرى في العلوم الاجتماعية.2 كان التناقض صارخاً لا يمكن تجاهله: كنت أجلس خلال تلك العروض في اللحظة ذاتها التي كنت أتلقى فيها تهديدات بالقتل ودعوات للإقالة عبر الإنترنت بسبب اقتراحي أن الذكاء الاصطناعي يستطيع إجراء الأبحاث بشكل أفضل من معظم الأساتذة. هذا التجاور هو ما بلور الحجة في هذا المقال.

21. معظم “المحتوى الرديء” كان ولا يزال من صنع البشر أنفسهم.

كانت أطروحتي الأولى أكثر ما قلته استفزازاً، ولم أعدّلها إلا قليلاً منذ ذلك الحين: الذكاء الاصطناعي الفاعل قادر بالفعل على إنجاز معظم مهام البحث في العلوم الاجتماعية بصورة أفضل من معظم الأساتذة على مستوى العالم. ولا أزال أتمسك بها. وفي مقابلتي الأخيرة مع Chronicle، صاغوا الأمر بشكل أكثر صراحة: “الذكاء الاصطناعي باحث أفضل منك.” وإن لم تكن تصدق ذلك بعد، فلنتحدث بعد بضع سنوات.

غير أن الجانب الآخر لا يقل أهمية. فإذا كان الذكاء الاصطناعي يستطيع إنتاج مخرجات بحثية أفضل من الأساتذة، فهذا في حد ذاته إدانة للمخرجات التي كان هؤلاء الأساتذة يُنتجونها — وما زالوا يُنتجونها — دون الذكاء الاصطناعي.

لقد كانت كلمة “سلوب” كلمة العام 2025 في قاموس Merriam-Webster، وتُعرَّف بأنها المحتوى الرقمي الرديء الجودة الذي يُنتجه الذكاء الاصطناعي. لكن مؤتمر ISA كان تذكيراً بأن الغالبية العظمى من المحتوى الرديء كانت دائماً من صنع البشر. كانت منظومة المجلات الأكاديمية والمؤتمرات الكبرى في كثير من تخصصات العلوم الإنسانية والاجتماعية مصانع للمحتوى الرديء قبل أن يحصل أحد على اشتراك في ChatGPT. نعم، أعني فعلاً أن معظم الأبحاث هي محتوى رديء.3

بعضها أيضاً ما يسميه الفيلسوف هاري فرانكفورت “تفاهة”: عمل لا يكترث بما إذا كانت ادعاءاته صحيحة أم لا، لا سيما في الموضوعات ذات الحساسية السياسية كالهجرة، حيث يبدأ الباحثون بالاستنتاج اليساري ويعملون عكسياً. لكن المحتوى الرديء أوسع من مجرد التفاهة؛ فهو يشمل أيضاً الأعمال التي لا تقدم أي ادعاء البتة، والأعمال التي من المفترض أن تتمتع بقيمة حرفية لكنها تفشل في ذلك. الباحث الذي يعثر على مجموعة بيانات قبل أن يكون لديه سؤال بحثي، ثم يتنقل بين النتائج بحثاً عن ما يستحق النشر، ينتج محتوى رديئاً. هؤلاء الباحثون كانوا موجودين قبل الذكاء الاصطناعي بكثير. كانوا فحسب أبطأ في ذلك.

22. كان الأكاديميون يُهلوِّسون ويغشون قبل الذكاء الاصطناعي.

المخاوف المتعلقة بالهلوسة والغش التي يُثيرها الناس بشأن الذكاء الاصطناعي في الأوساط الأكاديمية تصف مشكلات سابقة له بعقود، إن لم يكن بقرون. فقد نشر مشروع ضخم جديد في مجلة Nature هذا الشهر — كنت طرفاً صغيراً فيه — اختبر مئات الأوراق البحثية في العلوم الاجتماعية: تبين أن نحو نصف الادعاءات ذات الدلالة الإحصائية فقط قابلة للتكرار، مع انكماش حجم التأثير الوسيط انكماشاً ملحوظاً. هذه الدراسة تؤكد ما توصل إليه مشروع Open Science Collaboration عام 2015 في علم النفس وحده، حيث فشل نحو ثلثي النتائج في التكرار، وتمتد لتشمل مختلف التخصصات.

لم نكن نسمي هذا “هلوسة” قبل عصر الذكاء الاصطناعي. كنا نسميه “علماً”. وإذا أمعنت التفكير، فإن الهلوسة والإلهام ليسا متباعدَين كما يبدو؛ فكلاهما ينطوي على توليد تركيبات تتجاوز المدخلات. نسمي النتيجة هلوسة حين تكون خاطئة، وإنجازاً حين تكون صحيحة.

وفي الوقت ذاته، كثيراً ما يستشهد الأكاديميون بأوراق بحثية لم يقرؤوا منها سوى الملخص.4 على الأقل، معدلات هلوسة الذكاء الاصطناعي مُتتبَّعة وفي تحسن مستمر. أما معدلات هلوسة البشر في الأوساط الأكاديمية فليست مُتتبَّعة إطلاقاً. نحن نسميها ببساطة “إسهامات في الأدبيات البحثية.” وإن كنت مُحكِّماً، فلن تحتاج حتى إلى أن تُهلوِّس بنفسك: تكتفي بكتابة “يرجى الاستشهاد بي” وتمضي.

بعض الأبحاث رائع حقاً. لكن قبل أن نقلق من الغش بمساعدة الذكاء الاصطناعي، لنتأمل للحظة الغش من صنع البشر. ديدريك ستابل، مارك هاوزر، فرانشيسكا جينو، دان أريلي: قائمة قضايا الاحتيال رفيعة المستوى في تزايد مستمر، وهؤلاء هم فقط من أُمسك بهم. وبعيداً عن الاختلاق الصريح للبيانات، كانت ممارسات تضخيم النتائج الإحصائية (p-hacking)، والتحيز في صياغة الفرضيات بعد الاطلاع على النتائج (HARKing)، والإفصاح الانتقائي شائعة جداً لسنوات لدرجة أنها لم تُصنَّف كسلوك مخالف للأخلاق البحثية. لقد أحرزنا تقدماً حقيقياً في فهم هذه الممارسات، غير أنها لا تزال منتشرة بما يكفي للتأثير على ما يُنشر. وفوق ذلك كله، اعتاد الأساتذة الكبار دائماً وضع أسمائهم على أوراق كتبها طلاب الدكتوراه أساساً، وأُلِّفت كتب كاملة بواسطة فرق من مساعدي البحث تحت اسم باحث شهير. لم يُعدّ شيء من هذا غشاً حتى جعله الذكاء الاصطناعي أرخص تكلفةً وأكثر وضوحاً.

23. استعارة “الببغاء العشوائي” تنطبق على البشر أكثر مما تنطبق على الذكاء الاصطناعي.

كان أحد أكثر الشعارات تأثيراً في نقاش الذكاء الاصطناعي5 دائماً بمثابة عبارة تُوقف التفكير لا تُحفزه. كما لاحظت كيت هول، إنه توصيف قوي: ممتع في النطق، بالغ الكفاءة المفاهيمية، واستوطن عقول كثيرين بشكل دائم رغم عدم انطباقه على النماذج الحالية. إنه عمل فني لغوي حقيقي. وهو أيضاً خاطئ تجريبياً: فكل نموذج حدودي رئيسي منذ GPT-4 دُرِّب على مدخلات غير نصية، كما أن منطق الحجة الأصلية يستلزم التدريب على النص وحده لكي يصمد.

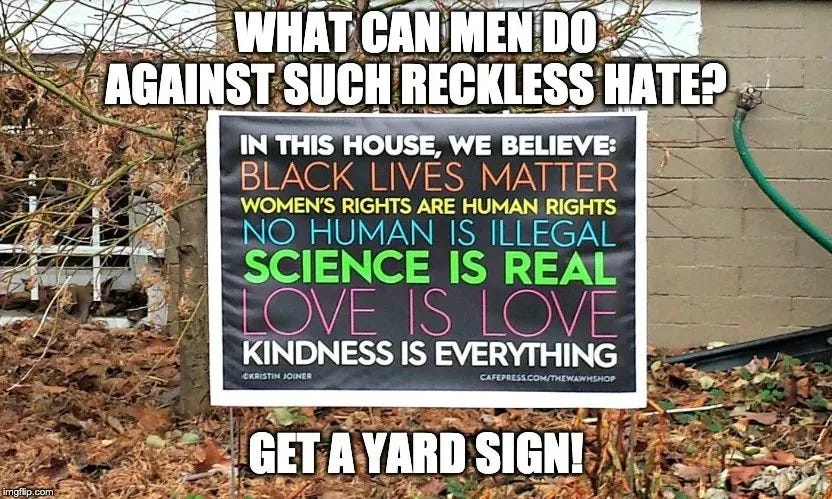

والآن تأمل شيئاً مختلفاً تماماً لكنه مألوف للغاية: لافتات الأحياء “In This House We Believe” (في هذا البيت نؤمن). “العلم حقيقي. الحب حب. لا يوجد إنسان غير شرعي”، وما إلى ذلك. يمكنك أن تؤمن بكل سطر وألا يكون لديك موقف سياسي متماسك من أي من هذه القضايا. ماذا يعني “لا يوجد إنسان غير شرعي” لسياسة التطبيق: حدود مفتوحة، عفو عام، أم شيء آخر؟ اللافتة لا تقول، لأن القول سيستلزم مواجهة التناقضات. إنها قسم ولاء لا حجة.

سخر الناس من هذه اللافتة لسنوات.

لكن النقطة الأعمق هي أن هذا تحديداً ما يُنتقد الذكاء الاصطناعي بسببه: إنتاج تصريحات سطحية مبهجة تُعبِّر عن الانتماء بدلاً من المعنى. واتضح أن البشر يفعلون ذلك بوجود الذكاء الاصطناعي أو بدونه، منذ أن أصبح لدينا حدائق لوضع اللافتات فيها.

هذه اللافتة ليست استثناء. بل تعكس كيف يتعامل معظم الناس مع معظم القضايا: تبنِّي موقف المجموعة، وتكراره، والمضي قدماً. مضمون ما تُجادل به يهم أكثر بكثير من طريقة تأطيره، لكن التأطير أسهل، وهذا لماذا يهيمن على الخطاب العام، من خيوط تويتر إلى عروض المؤتمرات.

شهدت ذلك بنفسي في ISA، حيث قدّم زملاء متثبتون أعمالاً تعادل المرادف الأكاديمي للافتة الحديقة، مع بعض الانحدارات المُحدَّدة بشكل خاطئ لإضفاء مسحة العلم عليها. كانت انتقادات الببغاء العشوائي تهدف إلى التقليل من الذكاء الاصطناعي. انتهى بها الأمر إلى أنها وصف أدق للحياة الفكرية البشرية مما قصده أحد.

24. نعم، يحق للبالغين استخدام الذكاء الاصطناعي في الكتابة. والتحكم فيه لا يجدي.

في الجزء الثاني، لاحظت أن أدوات الكشف عن الذكاء الاصطناعي غالباً غير مفيدة وتُفرز مشكلات أكثر مما تحل. لكن المشكلة الأعمق هي الدافع ورائها: الاعتقاد بأن التدخل الاصطناعي ملوِّث بطبيعته، بصرف النظر عما يُنتج. يُقدم كوين كيو حجة مثيرة للاهتمام مفادها أن الهوس بأدوات الكشف عن الكتابة الاصطناعية يشبه تطبيق “قاعدة القطرة الواحدة” — المبدأ المستمد من التصنيف العرقي الأمريكي في القرن التاسع عشر: أي أثر لتدخل الذكاء الاصطناعي يُلوِّث العمل بأكمله، بصرف النظر عن الجودة أو نية المؤلف.

كنت متشككاً في البداية في هذا التشبيه، لكنه دقيق تماماً. في نظر الناشط المعادي للذكاء الاصطناعي، أي كلمة لم تكتبها بنفسك هي تلوث أخلاقي. ورغم أن استخدام الذكاء الاصطناعي في الكتابة لا يُعدّ “غير قانوني” تقنياً، فإن هناك ما يشبه قاعدة القطرة الواحدة تحكم ما إذا كنت كاتباً شرعياً أم محتالاً، شخصاً جيداً أم سيئاً. ومن هنا جاءت الإدانات والتهديدات بالقتل لأشخاص مثلي ممن يُفصحون عن استخدامهم للذكاء الاصطناعي بحجة “إسناد التفكير إلى الآلة.”

كما جادلت في الجزء الأول، فإن معظم المعارضة للذكاء الاصطناعي هي حماية للمكانة متنكرة في هيئة مبدأ. يذهب آندي ماسلي أبعد من ذلك، مُجادلاً بأن ذعر الذعر الأخلاقي من برامج الدردشة الآلية قد يكون له مصدر يتجاوز مشروع الحفاظ على المكانة، وهو مصدر أقرب إلى الخرافة (“برامج الدردشة الآلية شيطانية”): الإحساس بأن النص الذي يُنتجه الذكاء الاصطناعي مُلوَّث روحياً، وأن ثمة خطأً أو شراً في آلة تستطيع الكتابة، بصرف النظر عما تكتبه.6

حتى ميغان ماكآردل، التي أفصحت مؤخراً بشجاعة عن استخدامها للذكاء الاصطناعي وأشعلت بين الصحفيين النقاش ذاته الذي خاضه الأكاديميون على Bluesky قبل أشهر، شعرت بالحاجة إلى الدفاع عن نفسها بالتأكيد على أن “الذكاء الاصطناعي لم يمس النص النهائي.” أُعجب بشجاعتها في التصريح. لكن لماذا يكون السؤال عن النص مطروحاً أصلاً؟ إذا كان العمل جيداً ومُفصَحاً عنه، فما تبقى هو تفضيل جمالي متنكر في هيئة أخلاق. أين يبدأ الإفساد؟ بحث Google؟ التصحيح التلقائي؟ مدقق الإملاء؟ النسخ التلقائي؟

وحتى مع تجاهل كل ذلك: بمعزل عن سيناريو على غرار “Dune” لكارثة ذكاء اصطناعي تعقبها موجة تنسيق بشري لحظر التقنية، فإن الكتابة غير الروائية بمساعدة الذكاء الاصطناعي تبدو حتمية في المآل في ضوء الحوافز القائمة. والجانب الآخر الجدير بالذكر: حتى لو نجحت في الكتابة الجيدة كلياً دون “تلوث الذكاء الاصطناعي”، فلن يكافئك أحد على هذا النقاء قريباً.

25. عدم استخدام أحدث أدوات الذكاء الاصطناعي في بحثك وكتابتك إهمال مهني.

جادل ماثيو يغليسياس مؤخراً بأن نماذج اللغة الكبيرة مُوظَّفة توظيفاً ناقصاً في الصحافة. وينطبق حجته أيضاً على الأكاديميين: الغاية من البحث هي المخرج المفيد، لا العملية التي يتوسطها البشر. الصرامة ينبغي أن تكون في التفكير والتحقق، لا في ما إذا كان إنسان أم آلة من كتب الجمل أو ضغط Enter عند تشغيل الانحدارات في R. وكما أحسن هوليس روبينز القول، ينبغي على الأساتذة على الأرجح اختبار نماذج الذكاء الاصطناعي قبل الإفطار (أي أن يكونوا مثل سكوت كانينغهام تقريباً).

أبسط استخدامات الذكاء الاصطناعي هو اكتشاف الأخطاء. تأمل عنوان صحيفة New York Times في الثالث من أبريل 2026: “منظمة معاهدة أمريكا الشمالية بدون أمريكا؟” الاسم الصحيح بطبيعة الحال هو منظمة معاهدة شمال الأطلسي. نشرت الـ Times تصحيحاً في اليوم التالي. خمّن بعضهم أن الخطأ سببه الذكاء الاصطناعي. لن نعرف، والحقيقة أن الأمر لا يهم. أي سير عمل LLM ذكي بما يكفي كان سيكتشف الخطأ في ثوانٍ. روتين تلقائي بسيط لجميع العناوين — “هل يتضمن هذا أي أخطاء؟ تحقق من مصدرين مستقلين” — كان سيوفر على الـ Times دورة أخبارية من الإحراج.

لكن التحقق من الحقائق هو الحد الأدنى لا السقف. الاستخدام الأكثر إثارة هو إنجاز أشياء لم تكن ممكنة من قبل. شريكتي في التأليف الآن كيلسي بايبر طلبت مؤخراً من Codex بناء موقع تفاعلي لمساعدتها على فهم ورقة في العلوم السياسية كانت تراجعها، ثم أنجزت المهمة بنفسها كما فعلها المشاركون في الدراسة. الذكاء الاصطناعي لا يضغط الوقت اللازم لإنتاج مخرج فحسب. بل يُخفض تكلفة الانخراط العميق الذي يتجنبه معظم الباحثين: بناء الشيء بنفسك، واختبار الحجة عملياً، وإعادة تشغيل التحليل كما فعله المشاركون. هذا ما يتطلبه الفهم العميق فعلاً.

ينطبق الأمر ذاته على الأوساط الأكاديمية. كان يمكن تحسين نصف عروض ISA التي حضرتها في كولومبوس بشكل ملموس بتمريرها سريعاً عبر ChatGPT: للتدقيق في القواعد، وتشديد الحجج، وكشف الفجوات المنطقية. هذه الأدوات مجانية أو شبه مجانية. اختيار عدم استخدامها هو اختيار تقديم عمل أدنى مما أنت قادر عليه، لا سيما إذا كانت رسالتك إعلام الجمهور. لكن لا ينبغي للصحفيين والأكاديميين استخدام الذكاء الاصطناعي فقط لاكتشاف الأخطاء المطبعية في العناوين. ينبغي لهم استخدامه لبناء مرئيات تفاعلية، واختبار الحجج، وفهم الأشياء المعقدة التي يكتبون عنها فهماً حقيقياً.

وماذا عن الكتابة ذاتها؟ ربما رأيت رداً شائعاً على من يستخدم الذكاء الاصطناعي في كتابته: “لماذا أقرأ المقال بدلاً من التوجيه الذي سبّبه؟” يبدو منطقياً، أليس كذلك؟ حسناً، لا، إذا تأملت الأمر قليلاً.

لماذا تأكل الوجبة بدلاً من قراءة قائمة البقالة؟ لماذا تنظر إلى الرسم البياني بدلاً من سكريبت ggplot؟ لماذا تقرأ الكتاب بدلاً من ملاحظات المؤلف؟ التوجيه لا يمنحك معرفة جديدة. المخرج يفعل ذلك. هذه هي النقطة برمتها. كما جادلت في الجزء الثاني، يُنتج أشخاص مختلفون ذوو خبرات وبيانات وسياقات مختلفة (كما يتجلى في ملفات claude.md الخاصة بهم) مخرجات مختلفة تماماً من التوجيه ذاته. إنها مسألة مهارة.

أفهم: قد يبدو غريباً أن تقضي وقتاً أطول في قراءة شيء مما أمضاه مؤلفه في إنتاجه. لكننا مررنا بهذا من قبل. رسم بياني استغرق توليده ثوانٍ قد يستغرق قراءته دقائق. لا أحد يطالب برؤية الكود وحده بدلاً من الرسم البياني أو يتخيل ذلك. يُقيِّمون الرسم البياني وما يقوله — المعرفة الجديدة غير المتوفرة من قبل.

26. قد تُنتج نماذج LLM معرفة جديدة فعلاً.

كما وثّق مؤخراً جون بيرن-مردوك، ميّلت برامج الدردشة الذكية المستخدمين باستمرار نحو الإجماع الخبراتي، عكس ما تفعله وسائل التواصل الاجتماعي تماماً. هذه الأدوات لا تساعدك على الكتابة بصورة أفضل فحسب. إذا استخدمتها بفاعلية، تساعدك على التفكير بعناية أكبر.7 وبهذه الطريقة، قد تعكس نماذج LLM صعود الشعبوية. لكن التحقق من الحقائق ليس الشيء ذاته كإنتاج معرفة جديدة.

قبل أن نسأل ما إذا كانت نماذج LLM قادرة على إنتاج أفكار جديدة حقاً (ثمة أمثلة جيدة على ذلك)، ينبغي أن نسأل كم من البشر يفعلون ذلك. يقضي معظم الأكاديميين مسيرتهم في إعادة تركيب الأفكار القائمة بتنويعات طفيفة، وتطبيق المناهج ذاتها على مجموعات بيانات مختلفة قليلاً، وإنتاج أعمال هامشية لن يقرأها أحد خارج نطاق تخصصهم الفرعي. التفكير الأصيل نادر وبالغ الصعوبة في أي جيل. لا أعني ذلك إهانة لأي من زملائي (أو لنفسي). لكن المعيار الذي تحتاج نماذج LLM إلى تجاوزه أدنى مما نحب الاعتراف به.8

صديقي روبرت كوبينيك، المنهجي السياسي الموهوب ومؤلف الروايات المنشورة9 في جامعة ساوث كارولينا، يبدو متشككاً في الكثير من المبالغات المحيطة بالذكاء الاصطناعي. يجادل بأن “نماذج LLM لا تُنتج معرفة قط، [التي] لا توجد إلا في العقول البشرية. هي لا تستطيع إلا مقارنة مجموعة معرفة بأخرى.” أحترم بوب، وبالتالي لا بأس أن نختلف. ردي: السؤال الفلسفي حول الوعي الذاتي حقيقي، لكنه متعامد مع السؤال العملي. سواء أكان النموذج “يفهم” شيئاً أم لا، فالمخرج إما يحتوي على معلومات جديدة مفيدة للبشر أم لا.10

المثال الأحدث والأكثر إيحاءً هو Claude Mythos، نموذج Anthropic الحدودي الجديد. في أسابيع قليلة من الاختبار، رصد آلاف الثغرات الأمنية غير المعروفة سابقاً عبر أنظمة التشغيل والمتصفحات الرئيسية، بما فيها ثغرة ظلت كامنة 27 عاماً دون اكتشاف. مهما أردت تسمية ذلك، فإن “مقارنة مجموعة معرفة بأخرى” لا تغطيه.

أفضل النظريات المفاهيمية في العلوم الاجتماعية هي بالفعل إعادة تركيب لأفكار قائمة. بنى أنتوني داونز نظريته في الاختيار العقلاني بزرع تعظيم المنفعة الاقتصادي الجزئي في التصويت وسمى كتابه صراحةً نظرية اقتصادية للديمقراطية. استعار باومغارتنر وجونز نظرية التوازن المتقطع من علم الأحياء التطوري وطبّقاها على صنع السياسات. استورد تحليل الشبكات الاجتماعية نظرية الرسم البياني بالكامل من الرياضيات. مزج أكسيلرود معضلة السجين مع نظرية الانتقاء التطوري. وذهب ألكسندر ونت أبعد من ذلك وطبّق نظرية الكم على العلاقات الدولية في كتابه Quantum Mind and Social Science — خطوة رآها كثيرون (وبحق) سخيفة، لكن مطبعة جامعة كامبريدج نشرتها مع ذلك. نادراً ما تخترع العلوم الاجتماعية من العدم. هي تترجم عبر المجالات، والترجمة هي الإسهام النظري.

هذا متطابق هيكلياً مع ما تفعله نماذج LLM: إعادة تركيب الأنماط والمفاهيم عبر السياقات. أحياناً تكون النتيجة هراءً. وأحياناً تكون مثمرة. الأمر ذاته صحيح بالنسبة للتركيب البشري. انتُقدت نظرية العلاقات الدولية الكمية لونت باعتبارها مجرد استعارة متنكرة في هيئة فيزياء، لكن كما ذكرنا أعلاه، نشرتها مطبعة كامبريدج. إذا كان هذا يُعدّ إنتاجاً للمعرفة، فمن العسير أن نفهم لماذا لا تكون إعادة التركيب التي تُنتجها نماذج LLM كذلك.

يُحسب لبوب أنه تنازل عن النقطة العملية مع تمسكه بالفلسفية: “السؤال هو كيف نستخدم هذه القدرة لتقدم المعرفة.” تماماً. كما قلت في الجزء الأول، أوقفوا النقاش حول ما إذا كانت نماذج LLM “تفهم فعلاً” بينما الأكثر مصلحةً منها يستخدمون الأدوات بالفعل لتحسين عملهم.

27. في نظر المنتقدين، التصور الذهني لمستخدم الذكاء الاصطناعي متوقف عند عام 2023 — وذلك حقبة بائدة.

تذكر كيف وصلنا إلى هذا المأزق. انحمس الطلاب لاستخدام الذكاء الاصطناعي قبل أساتذتهم، مستعملين النماذج العامة المجانية الأولى كـ ChatGPT 3.5. والنتيجة أن كثيراً من الأساتذة والمثقفين لا يزالون يتصورون المستخدم النموذجي للذكاء الاصطناعي على أنه طالب جامعي يحاول الغش في مقال، أو مساعد يُسلّم محتوى رديئاً مُولَّداً بالذكاء الاصطناعي. قد يصف ذلك الكثير من الاستخدام العرضي للذكاء الاصطناعي حول العالم. لكنه لا يصف كيف يعمل كبار الباحثين في معظم المجالات بهذه الأدوات، ولا كيف يعمل أي شخص يسعى إلى استخدام الذكاء الاصطناعي بمسؤولية ووعي.

وضع ستيفان شوبرت إصبعه على هذه النقطة بأفضل ما يكون: نحن نُقلل من عقلانية الآخرين، نفترض أنهم يطبقون الأدوات الجديدة بعشوائية أكبر مما يفعلون فعلاً. ثمة مساحة شاسعة بين أن تطلب من ChatGPT كتابة ورقة بحثية كاملة وبين كتابة كل كلمة بنفسك. حين تكتب “بنفسك”، أنت بالفعل تستخدم اختصارات. لا تُجري بحثاً عميقاً عن كل مرجع تذكره. تبحث في Google عن إحصائية وتثق بالرقم في العنوان. تتصفح ملخصاً وتستشهد بالورقة. إذا كانت لديك الموارد، تُسنِد التحقق إلى مساعد بحث أو محقق حقائق. الذكاء الاصطناعي يتيح لك القيام بكثير من هذا بطريقة أكثر منهجية وآلية وأقل تكلفة.

مثل كثيرين، يرى ديريك تومبسون بحق أن الكتابة هي التفكير وأن إسناد كامل عملية الكتابة إلى الذكاء الاصطناعي يُفرغ العقل. لكن رغم أن الكتابة في معظمها تفكير، فإن التفكير ليس الكتابة وحدها. صنع الفن تفكير. الحديث تفكير أيضاً. وكما تجادل دينا بيساريفا، صياغة التوجيهات هي أيضاً تفكير، إذا كان لديك شريك سقراطي جيد على الجانب الآخر من المحادثة.

يُقرّ تومبسون أيضاً بأن كل كتابة استلزمت دائماً التوجه خارج ذهن الكاتب بحثاً عن الأفكار والحقائق والتحرير والتدقيق. وحدود المساعدة المشروعة والإسناد غير المشروع كانت دائماً ضبابية، والذكاء الاصطناعي لم يخلق هذا الضباب. بل جعله مستحيلاً تجاهله. خلاصة تومبسون: “ينبغي أن نكون صادقين ومنفتحين إزاء هذا الضباب بدلاً من إعلان كل من لديه نافذة Claude مفتوحة عضواً في طبقة الرداءة.”

أين يُبقي ذلك مسألة الإفصاح؟ يقترح كثير من الأشخاص الفضلاء وكبريات المجلات الأكاديمية الإفصاح الكامل عن استخدام الذكاء الاصطناعي كحل. لكن الإفصاح غير مستدام من منظور نظرية الألعاب: يتحمل من يُفصحون تكاليف سمعة بينما يستفيد المستخدمون سراً، فيدفع التوازن نحو عدم الإفصاح. أمثالي وأمثال ميغان ماكآردل نعيش إثبات هذه المشكلة. والإطار الأوفق، كما يرى رايان بريغز، هو أن الذكاء الاصطناعي يُكمِّل الخبرة: مساعدون آليون يُراجعون عملك، ويُضفون صياغة رسمية على حججك أثناء تطورها، ويجمعون البيانات عند الطلب. إنه مضاعِف يتيح للأكفاء التفكير بصورة أفضل وأسرع.

حدسي أن الحالة الوحيدة التي يكون فيها الإفصاح واجباً حقاً هي حين يكون للجمهور توقع معقول بعمل مُنتَج بالكامل من قبل البشر، وهذا التوقع جزء مما يدفعون مقابله. أفضل تشبيه هو الحفلة الحية في الحالة الضيقة للكتابة الشخصية أو الإبداعية: إذا حضرت تتوقع أداءً حياً واتضح أن الفنان يقوم بالمزامنة الشفهية، فهذه شكوى مشروعة. بدقة أكبر، الإفصاح واجب حين يُضلل غيابه الجمهور بشأن ما يحصل عليه. الصحفي الذي ينشر باسمه يَعد بالمساءلة والأصالة، لا بمصدر كل ضغطة لوحة مفاتيح. كاتب المذكرات يَعد بكليهما. المعيار هو ما يضع المؤلف اسمه عليه، لا ما إذا كانت أداة متورطة.

لكن العلم والصحافة ليسا عروضاً حية. هما اكتشاف ومشاركة للمعرفة الجديدة. لا أحد يُفصح عن استخدامه لمدقق الإملاء، أو مساعدي البحث، أو بحث Google. ستكون معايير الكتابة الإبداعية والفنون مختلفة، وبحق، لأن الجماهير هناك تدفع جزئياً مقابل التجربة الإنسانية في صنع الشيء. ستجد العلوم الإنسانية مكانها في مكان ما بينهما عبر عملية مطولة وخلافية ستُكسر خلالها صداقات كثيرة. لكن في البحث والصحافة، “أفصح عن كل شيء” لا يأخذنا إلى حيث نحتاج أن نكون. ما ينبغي أن يهتم به القراء هو الدقة وما إذا كان المؤلف يتحمل المسؤولية الكاملة عما على الصفحة. المصدر إشارة أضعف بكثير من كليهما.

28. لا أحد يعرف شيئاً، وأنا من بينهم. لا بأس — سنتعلم معاً.

تهيبت في البداية التحدث مع الصحفيين عن الذكاء الاصطناعي لأنني لست خبيراً فيه بأي معنى حقيقي. لكنني أُدرك أكثر فأكثر أن لا أحد خبير فيما يجري هذا كله، ليس حقاً، وانتظار ظهور خبير هو كيف تنتهي إلى لا معايير على الإطلاق. لا أزال أتحاشى تقديم أي نصيحة تتجاوز تثبيت Claude Code (أو أداتك الفاعلة المفضلة) والتحدث معه لحل مشكلة لديك الآن.

كان آرثر سبيرلينغ صريحاً في هذه النقطة كعادته: الحسابات الأكاديمية المتخصصة في الذكاء الاصطناعي التي تُقدم باستمرار “نصائح” للزملاء وطلاب الدكتوراه، كأنها في المختبرات التي تطور النماذج، مُملّة. هم مشاهدون مثلنا جميعاً.11 حتى المطورون في المختبرات ذاتها لا يعرفون مدى تطور النماذج بعد أشهر قليلة.

إذن نحن في موقف محرج: يجب على أحد ما البدء في وضع معايير بيئة العمل الجديدة، والأشخاص الذين سيفعلون ذلك سيكونون حتماً ممن لا يفهمون تماماً ما يضعون معايير بشأنه. هذا غريب ومزعج. وهو أيضاً كيف ربما سارت معظم التحولات المؤسسية الأخرى، وإن كان بوتيرة أبطأ بكثير.

مررنا بنسخة من هذا بدت كحقبة بائدة حين توصل الأساتذة إلى أن مراقبة استخدام الطلاب للذكاء الاصطناعي بشكل كامل ودقيق لم تكن مثمرة ولا ممكنة. والأمر ذاته صحيح الآن للباحثين. يمكنك مراجعة الأجزاء التي تهم فعلاً، كرمز التكرار، وتجعل نماذج LLM ذلك أسهل بالفعل. المصدر هو الشيء الوحيد الذي لا يمكنك مراجعته، وهو الشيء الذي لا ينبغي أن نُنفق طاقتنا عليه أصلاً. يجب عليك اتباع الحوافز وبناء الأنظمة التي تضمن استخدام الأدوات بصورة جيدة، لا التظاهر بأنها غير مستخدمة إطلاقاً.

في سياق ذي صلة بالتدريس، كنت في إجازة، لذلك تحاشيت تقديم النصائح هنا أيضاً. نظراً للأسئلة الكثيرة التي تلقيتها، أنا أكثر تشاؤماً من آثار الذكاء الاصطناعي على التدريس منه على البحث. فعلى سبيل المثال، بينما أستخدم الذكاء الاصطناعي بانفتاح وبشكل واسع في بحثي وكتابتي، أعتزم حظر جميع الأجهزة الإلكترونية في مساقاتي الموضوعية واستعادة الامتحانات الكتابية والشفهية الحضورية.

هذان ليسا موقفين متناقضين. الفصل الدراسي هو المكان الذي يحتاج فيه الطلاب إلى بناء المهارات المعرفية التي تجعل التعاون مع الذكاء الاصطناعي منتجاً لاحقاً. لا يمكنك توجيه أداة ذكاء اصطناعي بمعنى حقيقي إذا لم تتعلم كيف تفكر بدونها قط. مخاوف ضمور المهارة من الجزء الثاني أكثر صحة هنا: يحتاج الطلاب إلى استيعاب الأساسيات قبل إسنادها. البحث هو المكان الذي تنشر فيه أفضل الأدوات المتاحة لديك لتحقيق نتيجة جديرة. التدريس هو المكان الذي تضمن فيه أن الجيل القادم يستطيع استخدام تلك الأدوات بصورة جيدة فعلاً.12

29. أفضل الأعمال يُنجَز حين يتعاون الإنسان والذكاء الاصطناعي.

لا أزال أرى كثيرين يتعهدون بعدم استخدام الذكاء الاصطناعي في كتابتهم. هذا بالقدر ذاته من المنطق كالتعهد برفض قبول المساعدة من مساعدي البحث أو المؤلفين المشاركين. لذا أتعهد بالعكس: سأستخدم أحدث نماذج LLM، وبالمثل أي أداة أخرى أو مؤلف بشري مشارك، لتحسين بحثي أو طريقة تواصلي بشأنه. بهذه الطريقة، إذا كان اسمي عليه، يمكنك أن تكون على يقين بأنه يعكس حكمي الشخصي الأفضل.

كثير من الأكاديميين، ولا سيما في العلوم الإنسانية، لا يزالون يؤمنون بأن المدة التي تُنفق في الإنجاز تهم. لكن نظرية القيمة-العمل الشعبية خاطئة في الاقتصاد، وهي خاطئة هنا أيضاً. إذا كنت شخصاً غريب الأطوار يريد قضاء سنوات في تشغيل جميع اختبارات المتانة يدوياً بمصفوفات معكوسة يدوياً بدلاً من تشغيل بعض أوامر R، أو ترجمة المخطوطات الأصلية أو نسخها يدوياً، فذلك شأنك. لم أكترث كثيراً بما إذا كان هؤلاء الأساتذة في الدراسات الدولية في ISA قد أمضوا 10 أو 100 ساعة على عروضهم البشرية الرديئة. العمل إما جيد أو ليس كذلك.

مع ذلك، ثمة معايير تستحق الترسيخ. حين تكتب “أعتقد” أو “أشعر”، ينبغي أن تكون ضمير المتكلم أنت حقاً. فضمير المتكلم يحمل وعداً ضمنياً بصوت بشري وراءه. أما الادعاء الواقعي، كالاسم الصحيح لحلف الناتو، فلا يعنيه من كتبه. لكن القناعة الشخصية شأنها مختلف. فكِّر في حفلة موسيقية حية: الجمهور يدفع مقابل أداء حقيقي لا مزامنة شفهية. حين تستخدم “أنا”، القارئ يحق له توقع أنك تعنيها. لا يتطلب ذلك أن تكتب (أو تُملي) كل كلمة بنفسك. يمكنك توجيه النموذج والعمل من ملاحظاتك وقراءة النتيجة بعناية، لكن يتطلب ذلك أن القناعة هي قناعتك أنت.

هذا المقال مثلاً، كُتب بانفتاح وفخر باستخدام محادثة تكرارية مع Claude Code، مستنداً إلى أفكاري الأصلية ومحادثاتي مع الزملاء واقتراحاتهم المفيدة، سواء الأكاديميون منهم وغيرهم.13 جرّب الجزء الأول قدرات الذكاء الاصطناعي دون تحرير بشري. وعكس الجزء الثاني الصوت البشري بنسبة 100%. أما الجزء الثالث الذي تقرأه الآن، فيجمع صوتي بقدرات الذكاء الاصطناعي، مُكملاً الدائرة. سأتركك تقرر أيها كان الأفضل.

أين يحتفظ البشر بميزة إذن؟ كما يرى يي تشينغ شو، على الأرجح في البيئات المفتوحة التي لا تتوفر بعد بيانات تدريب لها وفي المهام التي تستلزم تفاعلاً بشرياً مباشراً. قد يتغير هذا قريباً. لكننا اخترنا هذه المهنة لأننا نجد معنى في استيعاب الأشياء وإدراكها، ليس فقط لأننا لا نزال أفضل في ذلك. لهذا لا أرى أي تناقض في إسناد معظم الأعمال الروتينية إلى الذكاء الاصطناعي (أو مساعدي البحث، إن كنت تؤمن بالقيم التقليدية) والتركيز على ما يمنحنا أكثر المعنى — الخروج بأسئلة مهمة عن العالم والإجابة عنها بأفضل الأدوات المتاحة.

30. الخطر الحقيقي في العلم هو المحتوى الرديء البشري بسرعة الذكاء الاصطناعي. ما زال بإمكاننا منعه.

الذكاء الاصطناعي يُضاعف ما تُحضره إليه. أحضر فضولاً حقيقياً وأسئلة صعبة، وسيساعدك الذكاء الاصطناعي على إنتاج شيء يستحق القراءة. لا تُحضر شيئاً، وستنتج لا شيء بشكل أسرع.

لكن ثمة مجال للتفاؤل. النتائج ذاتها المنشورة في Nature التي كشفت مدى خلل قابلية الاستنساخ أظهرت أيضاً أن المجلات التي تشترط مشاركة البيانات والكود كانت معدلات قابلية استنساخها أعلى بشكل ملموس. ويمكن للذكاء الاصطناعي أن يُسرّع هذا بالفعل: لا شيء سوى الجمود يمنع محرري المجلات من فرض عمليات تحقق آلية من قابلية الاستنساخ والتحقق الإلزامي من الكود شرطاً للتقديم. يمكن إعداد هذه الأنظمة بطريقة شبه حتمية مع هامش ضيق جداً للخطأ، ويمكن للمؤلفين دائماً الطعن في رفض المكتب التلقائي إذا اعتقدوا أن سير العمل الفاعل الداخلي فشل في تحديد طريقة استنساخ كودهم.

وبطموح أكبر، يُخفض الذكاء الاصطناعي تكلفة إجراء الأعمال الضخمة المعتمدة على البيانات التي اعتادت تستلزم أن تكون راج شيتي مع فريق من 30 مساعد بحث وإمكانية الوصول إلى كل مجموعة بيانات إدارية في البلاد، أو أن تكون دارون أسيمأوغلو… بقلم وورق. يستطيع باحث ناشئ مع Codex الآن محاولة مشاريع كانت مستحيلة لوجستياً قبل خمس سنوات. ينبغي أن يرتفع معيار ما يُنشر لأن معيار ما يمكن إنتاجه قد ارتفع بالفعل.

المعيار لم يتغير: إذا وضعت اسمك على شيء، فأنت تقف خلفه. حكم على جودة المخرج لا على العملية. النقاش حول المحتوى الرديء للذكاء الاصطناعي يُلهينا عن السؤال الأصعب، الذي كان ينبغي أن نطرحه قبل وصول برامج الدردشة الآلية بكثير: لماذا كنا نتسامح مع كل هذا المحتوى الرديء من صنع البشر في المقام الأول؟

***

كان هدفي حين نشرت الجزء الأول بسيطاً: إحضار الحوار الذي كان يجري بالفعل خلف الأبواب الموصدة وفي الرسائل الخاصة إلى الفضاء العام. ومع ذلك، لا أزال أسمع الشيء ذاته من زملائي: “أليكس، نعلم أنك تستخدم الذكاء الاصطناعي، ونحن نفعل ذلك أيضاً، لكن ألا تستطيع التزام الصمت بشأنه؟”

أفهم الخوف من أن الذكاء الاصطناعي سيُستخدم بتهور، مُنتِجاً محتوى رديئاً أكثر مما يمنعه. لكن إذا فكرت في الأمر، فإن “التزام الصمت” هو مجرد دعوة إلى اعتماد النفاق الشامل معياراً مهنياً. جزء مما أردته هو أن يصل عدم اليقين الذي يعيشه الجميع إزاء سير عملهم ومستقبلهم إلى توازن أكثر استقراراً. وهذا يستلزم حواراً صادقاً لا صمتاً.

وهذا يحدث بالفعل. شاركت إميلي أوستر مؤخراً نصيحة إيساياه أندروز لطلاب الدكتوراه في الاقتصاد بـ MIT بشأن الذكاء الاصطناعي، واصفةً إياها بأنها شيء يجب تعميمه على جميع دفعات الدكتوراه. وكما لاحظ آندي هول، أهم ما في الأمر لم يكن أي نصيحة بعينها بقدر ما كان أن يُرسل أعضاء هيئة التدريس البارزون إشارة واضحة: هذا شيء عليك أخذه بجدية. حتى ديلان ماثيوز، أحد أكثر الناس تفكيراً في مجال الصحافة، أقرّ مؤخراً بأن المتحمسين للذكاء الاصطناعي كانوا على حق في الكثير من الأحيان.

التغيير حقيقي. الأكاديميون نصف مستيقظون بالفعل، ولن يعودوا إلى الوراء. ينبغي للطلاب الطامحين والباحثين الناشئين التقدم بحذر لكن احتضان تعلم أدوات الذكاء الاصطناعي واستخدامها بشكل كامل. العلماء والمثقفون والكتّاب الذين يرفضون المشاركة لن يُكافَؤوا على نقائهم. سيتفوق عليهم ببساطة زملاء يحملون الصرامة الفكرية ذاتها والفضول ذاته، لكن بأدوات أفضل.

أُقرّ بأن هذين المقالين معاً أصبحا أكثر ما كتبته قراءةً (بمساعدة Claude أو بدونها). أشخاص في مؤتمرات الهجرة وغيرها، ناهيك عن المسؤولين الإداريين في الجامعات عبر البلاد، باتوا يطلبون مني النصيحة بشأن الذكاء الاصطناعي بدلاً من آراء حول الهجرة أو العلوم السياسية. هذا يقول شيئاً عن مدى جدية تعاملنا مع الأشياء في هذا المجال، وأيضاً بأن عليّ البدء في رفع رسومي على المحاضرات والاستشارات. ↩

لا أقصد إفراد ISA بالانتقاد على نحو غير عادل. كان المنظمون يعملون في ظل قيود حقيقية، وكان في المؤتمر الكثير من الجلسات الممتازة والباحثين الجادين، وقد كتبت في مكان آخر عن طرق ملموسة لتحسين المؤتمرات الأكاديمية. ↩

ربما هذا هو الادعاء الذي واجه أكثر الانتقادات من القراء الأوائل لهذا المقال. يرى بعضهم أن استخدامي لكلمة “سلوب” يمتد المفهوم أبعد مما ينبغي، وأن المحتوى الرديء للذكاء الاصطناعي (مُنتَج بإفراط، مصقول لكن فارغ) والأعمال الأكاديمية السيئة (مهملة، قاصرة الإنتاج) يمثلان أنماطاً مختلفة للفشل. عادةً ما أكره التوسع المفاهيمي في الكتابة العلمية، لكنني لا أعتقد حقاً أن هذا ما يحدث هنا. ما شهدته في ISA كان عملاً مُفرَطاً في الإنتاج وعديم المعنى يبدو علمياً لكنه لا يضيف شيئاً للمعرفة الإنسانية. وهذا “سلوب” بأي تعريف. ↩

أستطيع أن أشهد بأن كثيراً من الاستشهادات بأعمالي كانت إعادة تفسيرات إبداعية لما توصلت إليه فعلاً: استُبسطت النتائج وعُكست الاستنتاجات، مما يدل شبه مؤكد على أن من استشهدوا بي لم يقرؤوا أعمالي. ↩

تأتي عبارة “الببغاء العشوائي” من ورقة بحثية عام 2021 شارك في تأليفها اللغوية إيملي بيندر، تجادل بأن نماذج اللغة الكبيرة تُنتج النص بالتنبؤ بتسلسلات الكلمات الأرجح دون فهم. ↩

يذهب دين دبليو بول أبعد من ذلك ويجادل بأن إنكار اليسار للذكاء الاصطناعي يرتكز على رؤية للعالم تصف صناعة التكنولوجيا بأنها تضم “حمقى سطحيين” لا تزيد إنجازاتهم على كونها نهباً فاضحاً دائماً. ربما نجح هذا المنطق مع العملات المشفرة. إنه لا يناسب الأدوات التي يستخدمها ملايين الباحثين والكتّاب بهدوء لأداء عمل أفضل. ↩

أقول “إذا استُخدمت بفاعلية” لأن هناك أدلة حقيقية على أن الاعتماد السلبي وغير الناقد على الذكاء الاصطناعي يمكن أن يُضعف مهارات التفكير النقدي، ولا سيما في المهام الروتينية. هذا قلق حقيقي، ولهذا أجادل أدناه بأن الفصل الدراسي هو المكان الذي يحتاج فيه الطلاب إلى بناء الأسس قبل إسنادها. ↩

كما جادلت هوليس روبينز منذ عام، الأكاديميون الوحيدون الذين سيحتفظون بقيمتهم في عصر الذكاء الاصطناعي هم العاملون في حدود المعرفة. كلما مر الوقت، بدت هذه الحجة أقل فجاجة. ↩

ينبغي لكم الاطلاع على The Bayesian Hitman. ستُفاجئ قناعاتكم بالتأكيد. ↩

كما جادل أليسون غوبنيك وزملاؤه مؤخراً في Science، نماذج LLM تُفهم على أفضل وجه باعتبارها تقنيات ثقافية، كالكتابة والطباعة والمكتبات، أو أدوات تُتيح أشكالاً جديدة من إنتاج المعرفة حتى إن لم “تفكر” هي بنفسها. ↩

الاستثناء الذي يُثبت القاعدة هو أنيكيت بانجواني وسكوت كانينغهام، اللذان أمضيا أشهراً في نشر روايات تفصيلية من الخط الأول عن حقيقة إجراء الأبحاث بمساعدة Claude Code. على أقل تقدير بالنسبة لي، كان هذا النوع من الكتابة مفيداً حقاً وكان حاسماً في إخراج سلسلتي حول الذكاء الاصطناعي. ↩

ثمة قلق مشروع كامن هنا: طلاب الدكتوراه الساعون إلى تعلم الأساسيات باتوا الآن يتنافسون على مساحة في المجلات مع أساتذة لديهم فيالق من عوامل الذكاء الاصطناعي. هذا حقيقي، ولهذا الجواب في التدريس ليس “احظر الذكاء الاصطناعي إلى الأبد.” الجواب هو التدرّج — تعلم التفكير بدون الأداة أولاً، ثم استخدمها بحكمة. ↩

أنا ممتن بشكل خاص لستيفن أدلر، ورايان بريغز، وتينا مارش دالتون، وجوش جيلرز، وجيمي ألفونسو ليكون، وإيغور لوغفينينكو، وإيليا مورتازاشفيلي، وكايل سوندرز، ودينا بيساريفا، وكوين كيو، وبن رادفورد، ومايك ريغز، وهوليس روبينز، وجيم والش، وشون وستوود، ويي تشينغ شو، وإيما تشانغ على اقتراحاتهم المفيدة وتحدياتهم البنّاءة. ↩