Bitte liken, teilen, kommentieren und abonnieren Sie. Es hilft dabei, den Newsletter zu verbreiten, ohne dass Sie einen finanziellen Beitrag leisten müssen. Vielen Dank fürs Lesen.

In Teil I habe ich argumentiert, dass KI sozialwissenschaftliche Forschung bereits besser durchführen kann als die meisten Professorinnen und Professoren. In Teil II habe ich über tausend Reaktionen ausgewertet, Kritikern dort recht gegeben, wo sie recht hatten, und gleichzeitig an meiner Kernthese festgehalten: Der akademische Status quo war bereits kaputt, und KI erzwingt nur die Abrechnung.1 In diesem Teil III, der in den letzten Monat kollaborativ mit KI und meinen Kolleginnen und Kollegen entstanden ist, gehe ich von der Diagnose dazu über, was Akademikerinnen und Akademiker tatsächlich tun können und was nicht.

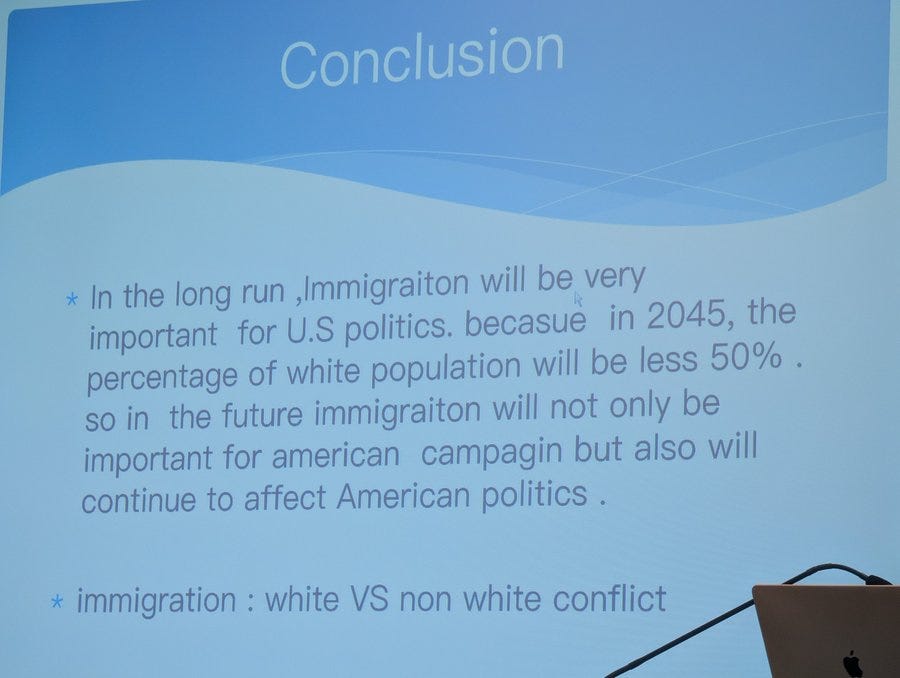

Der eher unwahrscheinliche Auslöser für diesen dritten Teil über KI war der Besuch der ISA Annual Convention 2026 (International Studies Association) in Columbus, Ohio – eine führende multidisziplinäre Konferenz der weltweit bedeutendsten Forschenden auf dem Gebiet der Internationalen Studien. Zumindest wurde mir das gesagt. Was ich tatsächlich erlebte, waren Präsentationen, die kaum ein C in einer meiner Lehrveranstaltungen verdient hätten: Argumente ohne These oder innere Logik, Grammatikfehler, die jede Rechtschreibprüfung aufgefangen hätte, und Vortragende, die ihre eigenen Folien ablasen, als begegneten sie ihren schlechten Argumenten zum ersten Mal. Alles ohne erkennbaren KI-Einsatz, soweit ich das anhand der Tippfehler und Inkonsistenzen beurteilen konnte. Das waren nicht nur Doktorandinnen und Doktoranden, sondern Menschen mit Professur, Tenure und Forschungsbudget.

Wenn KI-Slop die Krise ist, vor der alle warnen, würde ich gerne wissen, wie man das bezeichnen soll, was ich bei der ISA oder auf den meisten anderen großen sozialwissenschaftlichen Konferenzen zu sehen bekomme.2 Der Kontrast war unübersehbar: Ich saß in diesen Präsentationen genau in dem Moment, in dem ich online Morddrohungen und Forderungen nach meiner Entlassung erhielt, weil ich behauptet hatte, KI könne besser forschen als die meisten Professorinnen und Professoren. Diese Gegenüberstellung hat das Argument für diesen Text schärfer herausgearbeitet als alles andere.

21. Die meisten „Slop”-Inhalte waren und sind immer noch menschlicher Slop.

Meine erste These war das Provokanteste, was ich je gesagt habe, und ich habe sie seitdem nur leicht angepasst: Agentische KI kann bereits die meisten sozialwissenschaftlichen Forschungsaufgaben besser erledigen als die meisten Professorinnen und Professoren weltweit. Daran halte ich fest. In meinem jüngsten Interview mit der Chronicle haben sie es noch direkter formuliert: „AI Is a Better Researcher Than You.” Wer das noch immer nicht glaubt, wird in ein paar Jahren eines Besseren belehrt.

Doch die Kehrseite ist genauso wichtig. Wenn KI bessere Forschungsergebnisse liefern kann als Professorinnen und Professoren, ist das auch ein Urteil über die Ergebnisse, die diese Forschenden mit und ohne KI produziert haben.

„Slop” war das Merriam-Webster-Wort des Jahres 2025, definiert als minderwertige digitale Inhalte, die von KI erzeugt werden. Doch die ISA-Konferenz erinnerte mich daran, dass die große Mehrheit des Slops schon immer menschlicher Slop war. Das akademische Zeitschriftensystem und die großen Konferenzen in weiten Teilen der Geistes- und Sozialwissenschaften waren Slop-Fabriken, lange bevor irgendjemand ein ChatGPT-Abonnement hatte. Ja, ich meine wirklich, dass die meiste Forschung Slop ist.3

Ein Teil davon ist auch das, was der Philosoph Harry Frankfurt als „Bullshit” bezeichnen würde: Arbeit, der es gleichgültig ist, ob ihre Behauptungen wahr sind – insbesondere zu politisch aufgeladenen Themen wie Migration, wo Forschende mit der linken Schlussfolgerung beginnen und sich rückwärts vorarbeiten. Aber Slop ist weiter gefasst als Bullshit. Es umfasst auch Arbeit, die gar keine Behauptung aufstellt, Arbeit, die einen handwerklichen Anspruch haben soll und schlicht scheitert. Wer einen Datensatz findet, bevor er eine Frage hat, und dann nach publizierbaren signifikanten Ergebnissen sucht, produziert Slop. Diese Forschenden gab es lange vor KI. Sie arbeiteten nur langsamer.

22. Akademikerinnen und Akademiker haben schon vor der KI halluziniert und geschummelt.

Die Sorgen über Halluzinationen und Betrug, die Menschen in Bezug auf KI in der Wissenschaft äußern, beschreiben Probleme, die ihr um Jahrzehnte, wenn nicht Jahrhunderte vorausgehen. Ein umfangreiches neues Projekt, das diesen Monat in Nature veröffentlicht wurde und an dem ich in kleinem Rahmen beteiligt war, testete Hunderte sozialwissenschaftlicher Arbeiten: Nur etwa die Hälfte der statistisch signifikanten Befunde ließ sich replizieren, und die medianen Effektgrößen schrumpften dramatisch. Diese Studie bestätigt, was die Open Science Collaboration von 2015 allein für die Psychologie gezeigt hat – wo etwa zwei Drittel der Befunde nicht replizierbar waren – und weitet das Ergebnis auf weitere Felder aus.

Wir nannten das nicht „Halluzinationen”, bevor es KI gab. Wir nannten es „Wissenschaft.” Wenn man genauer darüber nachdenkt, sind Halluzination und Inspiration gar nicht so verschieden, wie sie klingen. Beide erzeugen Kombinationen, die über den Input hinausgehen. Wir nennen es Halluzination, wenn das Ergebnis falsch ist, und Durchbruch, wenn es richtig ist.

Dabei zitieren Forschende routinemäßig Arbeiten, die sie allenfalls im Abstract gelesen haben.4 Wenigstens werden KI-Halluzinationsraten erfasst und verbessert. Menschliche Halluzinationsraten in der Wissenschaft werden gar nicht erfasst. Wir nennen sie schlicht „Beiträge zur Literatur.” Und als Gutachterin oder Gutachter muss man nicht einmal selbst halluzinieren: Man schreibt „please cite me” und macht weiter.

Manche Forschung ist genuinen Ansprüchen hervorragend. Aber bevor wir uns über KI-gestützte Täuschung Gedanken machen, sollten wir uns einen Moment lang mit der menschlichen befassen. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely: Die Liste hochkarätiger Betrugsfälle wächst weiter, und das sind nur die Entdeckten. Abseits offener Fälschung waren p-Hacking, HARKing (Hypothesenbildung nach Bekanntwerden der Ergebnisse) und selektive Berichterstattung jahrelang so verbreitet, dass sie kaum als Fehlverhalten wahrgenommen wurden. Wir haben im Verständnis dieser Praktiken echte Fortschritte gemacht, aber sie sind weit genug verbreitet, um das Publikationswesen zu beeinflussen. Darüber hinaus haben Professorinnen und Professoren immer Arbeiten unter ihrem Namen veröffentlicht, die hauptsächlich von Doktorandinnen und Doktoranden verfasst wurden, und ganze Bücher wurden von Teams wissenschaftlicher Hilfskräfte unter dem Namen bekannter Forscherpersönlichkeiten zusammengestellt. All das galt nicht als Betrug, bis KI den Prozess billiger und sichtbarer machte.

23. Die Metapher des „stochastischen Papageis” beschreibt Menschen besser als KI.

Eine der einflussreichsten Formeln der KI-Debatte5 hat stets als gedankenhemmendes Klischee gewirkt. Wie Cate Hall beobachtet hat, ist es eine wirkungsvolle Prägung: angenehm auszusprechen, konzeptuell effizient, und sie hat sich dauerhaft in vielen Köpfen festgesetzt – obwohl sie auf die heutigen Modelle nicht zutrifft. Ein echtes sprachliches Kunstwerk. Zugleich ist sie empirisch falsch: Jedes bedeutende Frontier-Modell seit GPT-4 wurde auch mit nicht-textuellen Eingaben trainiert, und die Logik des ursprünglichen Arguments setzt ausschließlich textbasiertes Training voraus.

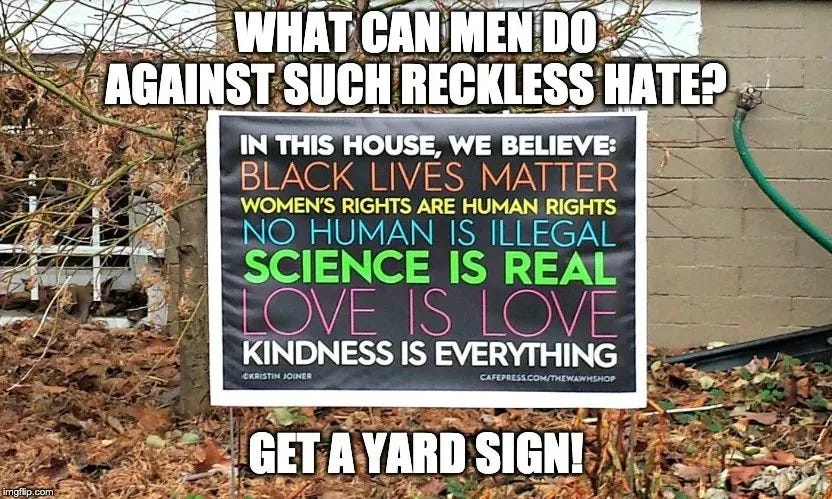

Betrachten wir nun etwas völlig anderes und doch sehr Vertrautes: die „In This House We Believe”-Schilder im Vorgarten. Science Is Real. Love Is Love. No Human Is Illegal usw. Man kann jede Zeile aufrichtig glauben und trotzdem keine kohärente Politikposition zu einem dieser Themen haben. Was impliziert „no human is illegal” für die Durchsetzungspraxis: offene Grenzen, Amnestie, etwas anderes? Das Schild schweigt dazu, denn Antworten würden erfordern, Widersprüche anzugehen. Es ist ein Loyalitätsbekenntnis, kein Argument.

Menschen machen sich schon länger über diese Schilder lustig.

Aber der tiefere Punkt ist, dass genau das ist, was KI kritisiert wird: oberflächliche Aussagen zu produzieren, die Zugehörigkeit signalisieren statt Bedeutung transportieren. Es stellt sich heraus, dass Menschen das mit oder ohne KI getan haben, solange sie Rasenflächen haben, auf die man Schilder stecken kann.

Das Vorgartenschild ist kein Ausreißer. Es ist die Art, wie die meisten Menschen mit den meisten Themen umzugehen scheinen: die Position der eigenen Gruppe übernehmen, wiederholen, weitermachen. Der inhaltliche Gehalt eines Arguments zählt weit mehr als das Framing, aber Framing ist einfacher, weshalb es den öffentlichen Diskurs dominiert – von Twitter-Threads bis zu Konferenzpräsentationen.

Ich habe das auf der ISA aus erster Hand erlebt: Tenurierte Kolleginnen und Kollegen präsentierten Arbeiten, die dem akademischen Äquivalent eines Vorgartenschilds entsprachen, komplett mit ein paar falsch interpretierten Regressionen, um ihnen den Anschein von Wissenschaft zu verleihen. Die Stochastischer-Papagei-Kritik sollte KI verkleinern. Am Ende war sie eine treffendere Beschreibung des menschlichen Geisteslebens, als irgendjemand beabsichtigt hatte.

24. Ja, mündige Erwachsene dürfen KI zum Schreiben nutzen. Die Kontrolle dagegen funktioniert nicht.

In Teil II habe ich angemerkt, dass KI-Detektoren oft wenig nützlich sind und mehr Probleme schaffen als sie lösen. Aber das tiefere Problem ist der Impuls dahinter: die Überzeugung, dass KI-Beteiligung von Natur aus kontaminierend ist, unabhängig davon, was dabei herauskommt. Quinn Que macht einen faszinierenden Fall dafür, dass die Obsession mit KI-Schreibdetektoren der „One-Drop Rule” ähnelt, jenem Prinzip aus der rassistischen Klassifizierung des 19. Jahrhunderts in den USA: Jede Spur von KI-Beteiligung kontaminiert das gesamte Werk, unabhängig von Qualität oder Intention der Autorin oder des Autors.

Ich war zunächst skeptisch gegenüber der Analogie, aber sie trifft zu. In der Weltsicht des KI-Aktivismus ist jedes Wort, das man nicht selbst geschrieben hat, eine moralische Verunreinigung. Obwohl der Einsatz von KI beim Schreiben technisch gesehen nicht „verboten” ist, gilt de facto eine One-Drop Rule dafür, ob man als legitime Autorin bzw. legitimer Autor oder als Betrügerin bzw. Betrüger gilt, als gute oder schlechte Person. Daher die Verurteilungen und Morddrohungen gegen Menschen wie mich, die ihren KI-Einsatz offenlegen, weil sie ihr „Denken an die Maschine auslagern”.

Wie ich in Teil I argumentiert habe, ist ein Großteil des KI-Widerstands Statusschutz im Gewand von Prinzipien. Andy Masley geht noch weiter und argumentiert, dass die moralische Panik um Chatbots eine Quelle jenseits des Statusprojekts haben könnte. Diese Quelle ist etwas, das dem Aberglauben nahekommt („Chatbots sind dämonisch”): das Gefühl, dass KI-produzierter Text spirituell befleckt ist, dass an einer Maschine, die schreiben kann, unabhängig davon, was sie schreibt, etwas Falsches oder gar Böses ist.6

Selbst Megan McArdle, die ihren KI-Einsatz kürzlich öffentlich offenlegte und damit unter Journalistinnen und Journalisten dieselbe Diskussion auslöste, die Akademikerinnen und Akademiker auf Bluesky einige Monate zuvor geführt hatten, sah sich genötigt, sich mit dem Hinweis zu verteidigen, dass „KI den Text nicht berührt habe”. Ich bewundere sie dafür, dass sie sich geäußert hat. Aber warum sollte die Text-Frage überhaupt ein Problem sein? Wenn die Arbeit gut ist und der Prozess offengelegt wird, ist alles andere ästhetische Präferenz, die als Ethik verkleidet wird. Wo beginnt die Unreinheit? Google-Suche? Autokorrektur? Rechtschreibprüfung? Transkriptionen?

Und selbst wenn man das alles beiseitelässt: Abseits eines Dune-artigen Szenarios einer KI-Katastrophe, gefolgt von einer globalen Koordination zum Technologieverbot, ist weit verbreitetes KI-gestütztes Schreiben von Sachtexten im Gleichgewicht fast unvermeidlich, angesichts der bestehenden Anreize. Die Kehrseite, die erwähnt werden sollte: Selbst wenn es gelingt, völlig ohne „KI-Verunreinigung” gut zu schreiben, wird man für diese Reinheit bald niemanden mehr finden, der sie belohnt.

25. Die neuesten KI-Werkzeuge in Forschung und Schreiben nicht zu nutzen, ist Kunstfehler.

Matthew Yglesias hat kürzlich argumentiert, dass große Sprachmodelle im Journalismus zu wenig genutzt werden. Sein Punkt gilt auch für Forschende: Der Zweck von Forschung ist der nützliche Output, nicht der menschlich vermittelte Prozess. Die Strenge sollte im Denken und in der Überprüfung liegen, nicht darin, ob ein Mensch oder eine Maschine die Sätze getippt oder in R auf Enter gedrückt hat. Wie Hollis Robbins es treffend formuliert, sollten Professorinnen und Professoren KI-Modelle wohl vor dem Frühstück testen (also wie Scott Cunningham vorgehen).

Die banalste Nutzung von KI ist das Aufdecken von Fehlern. Man denke an die New York Times-Schlagzeile vom 3. April 2026: „A North American Treaty Organization Without America?” Der korrekte Name ist natürlich die North Atlantic Treaty Organization. Die Times veröffentlichte am nächsten Tag eine Korrektur. Manche spekulierten, der Fehler sei durch KI verursacht worden. Wir werden es nie wissen, und ehrlich gesagt spielt es keine Rolle. Jeder ausreichend smarte LLM-Workflow hätte den Fehler in Sekunden entdeckt. Eine einfache automatische Routine für alle Schlagzeilen – „Enthält das Fehler? Gegen zwei Quellen prüfen” – hätte der Times einen Nachrichtenzyklus voller Peinlichkeit erspart.

Aber Faktenprüfung ist die unterste Grenze, nicht die Decke. Die interessantere Nutzung liegt darin, Dinge zu tun, die vorher nicht möglich waren. Meine nunmehrige Ko-Autorin Kelsey Piper ließ kürzlich von Codex eine interaktive Website erstellen, damit sie ein politikwissenschaftliches Paper, das sie rezensierte, tatsächlich verstehen konnte, und erledigte die Aufgabe dann selbst so, wie es die Studienteilnehmenden getan hatten. KI komprimiert nicht nur die Zeit zur Erzeugung eines Outputs. Sie senkt die Kosten für die Art aktiver Auseinandersetzung, die die meisten Forschenden überspringen: die Sache selbst zu bauen, ein Argument zu stressttesten, eine Analyse so zu wiederholen, wie es die Teilnehmenden taten. Das ist es, was tiefes Verständnis wirklich erfordert.

Das gilt auch für die Wissenschaft. Die Hälfte der ISA-Präsentationen, die ich in Columbus besucht habe, hätte durch einen kurzen Schleifendurchlauf durch ChatGPT erheblich verbessert werden können: Grammatik prüfen, Argumente straffen, logische Lücken aufdecken. Diese Werkzeuge sind kostenlos oder nahezu kostenlos. Sie nicht zu nutzen, ist eine Entscheidung, schlechtere Arbeit abzuliefern, als man könnte – besonders wenn man den Anspruch hat, die Öffentlichkeit zu informieren. Journalistinnen, Journalisten und Forschende sollten KI jedoch nicht nur nutzen, um Tippfehler in Schlagzeilen zu finden. Sie sollten damit interaktive Visualisierungen erstellen, Argumente stressttesten und die komplizierten Dinge, über die sie schreiben, wirklich verstehen.

Aber was ist mit dem Schreiben selbst? Man kennt vielleicht die häufige Reaktion auf jeden, der KI beim Schreiben nutzt: „Warum sollte ich den Artikel lesen und nicht den Prompt, der ihn ausgelöst hat?” Klingt vernünftig, oder? Nein, wenn man etwas darüber nachdenkt.

Warum das Gericht essen statt die Einkaufsliste lesen? Warum ein Diagramm anschauen statt das ggplot-Skript? Warum das Buch lesen statt die Notizen der Autorin bzw. des Autors? Der Prompt vermittelt kein neues Wissen. Der Output hingegen schon. Das ist der springende Punkt. Wie ich in Teil II argumentiert habe, produzieren verschiedene Menschen mit unterschiedlicher Expertise, anderen Daten und anderem Kontext (manifestiert in ihren claude.md-Dateien) aus demselben Prompt völlig unterschiedliche Outputs. Es ist eine Frage des Könnens.

Ich verstehe es: Es kann sich seltsam anfühlen, mehr Zeit mit dem Lesen von etwas zu verbringen, als die Autorin oder der Autor für die Produktion benötigt hat. Aber das kennen wir bereits. Ein Diagramm, das in R in Sekunden erstellt wurde, kann Minuten sorgfältigen Lesens erfordern. Niemand verlangt oder fantasiert davon, nur den Code statt des Diagramms zu sehen. Man bewertet das Diagramm und seine Aussage – das neue Wissen, das vorher nicht existierte.

26. LLMs können tatsächlich neues Wissen produzieren.

Wie kürzlich von John Burn-Murdoch dokumentiert, zogen KI-Chatbots Nutzende konsequent in Richtung Expertenkonsens – das Gegenteil von dem, was soziale Medien tun. Die Werkzeuge helfen einem nicht nur, besser zu schreiben. Aktiv eingesetzt, helfen sie einem, sorgfältiger zu denken.7 Auf diese Weise könnten LLMs sogar den Aufstieg des Populismus umkehren. Aber Faktenprüfung ist nicht dasselbe wie neues Wissen produzieren.

Bevor wir fragen, ob LLMs wirklich neue Ideen erzeugen können (es gibt gute Beispiele dafür), sollten wir fragen, wie viele Menschen das tun. Die meisten Akademikerinnen und Akademiker verbringen ihre Karriere damit, bestehende Ideen in kleinen Variationen neu zu kombinieren, dieselben Methoden auf leicht andere Datensätze anzuwenden und inkrementelle Arbeiten zu produzieren, die niemand außerhalb ihrer Teilsdisziplin je lesen wird. Originäres Denken ist in jeder Generation außerordentlich schwierig und selten. Das meine ich nicht als Beleidigung für Kolleginnen und Kollegen (oder mich selbst). Aber die Hürde, die LLMs nehmen müssen, ist niedriger, als wir zugeben wollen.8

Mein Freund Robert Kubinec, ein brillanter Methodologe und veröffentlichter Belletristik-Autor9 an der University of South Carolina, scheint vielem KI-Hype gegenüber ziemlich skeptisch zu sein. Er argumentiert, dass „LLMs niemals Wissen erschaffen, [das] nur in menschlichen Gehirnen existiert. Sie können nur eine Menge Wissen mit einer anderen vergleichen.” Ich schätze Bob, daher ist es in Ordnung, wenn wir uns uneinig sind. Meine Antwort: Die philosophische Frage über Selbstbewusstsein ist real, aber sie ist orthogonal zur praktischen. Ob das Modell irgendetwas „versteht” oder nicht, der Output enthält entweder neue, für Menschen nützliche Informationen oder nicht.10

Das suggestivste jüngste Beispiel ist Claude Mythos, Anthropics neues Frontier-Modell. In wenigen Wochen Tests identifizierte es Tausende bislang unbekannte Sicherheitslücken in großen Betriebssystemen und Browsern, darunter eine, die 27 Jahre lang unentdeckt geblieben war. Wie immer man das auch nennen will – „eine Menge Wissen mit einer anderen vergleichen” trifft es nicht ganz.

Die besten konzeptuellen Theorien der Sozialwissenschaft sind bereits Rekombinationen bestehender Ideen. Anthony Downs entwickelte seine Rational-Choice-Theorie, indem er die mikroökonomische Nutzenmaximierung auf Wahlverhalten übertrug, und nannte sein Buch buchstäblich An Economic Theory of Democracy. Baumgartner und Jones liehen sich das Konzept des punctuated equilibrium aus der Evolutionsbiologie und wandten es auf politische Prozesse an. Die soziale Netzwerkanalyse übernahm die Graphentheorie vollständig aus der Mathematik. Axelrod verband das Gefangenendilemma mit evolutionärer Fitnesselektion. Alexander Wendt ging noch weiter und wandte die Quantentheorie auf die internationalen Beziehungen in Quantum Mind and Social Science an – ein Schritt, den viele (zu Recht) für absurd hielten, den Cambridge University Press dennoch veröffentlichte. Sozialwissenschaft erfindet selten bei null. Sie übersetzt zwischen Domänen, und die Übersetzung ist der theoretische Beitrag.

Das ist strukturell identisch mit dem, was LLMs tun: Muster und Konzepte über Kontexte hinweg rekombinieren. Manchmal ist das Ergebnis Unsinn. Manchmal ist es produktiv. Dasselbe gilt für menschliche Rekombination. Wendts Quanten-IR wurde als bloße Metapher kritisiert, die als Physik getarnt ist, aber wie erwähnt veröffentlichte Cambridge University Press es. Wenn das als Wissensproduktion gilt, ist schwer einzusehen, warum LLM-generierte Rekombinationen es nicht tun würden.

Zu seinem Verdienst hat Bob den praktischen Punkt eingeräumt, auch wenn er am philosophischen festhält: „die Frage ist, wie man diese Fähigkeit nutzt, um Wissen voranzutreiben.” Genau. Wie ich in Teil I sagte: Hört auf zu debattieren, ob LLMs „wirklich verstehen”, während die Menschen mit dem meisten auf dem Spiel die Werkzeuge bereits nutzen, um ihre Arbeit zu verbessern.

27. Für Kritikerinnen und Kritiker ist das Bild typischer KI-Nutzenden im Jahr 2023 steckengeblieben – das ist eine Ewigkeit her.

Erinnern wir uns, wie wir in diese Situation geraten sind. Studierende begannen KI zu nutzen, bevor ihre Professorinnen und Professoren es taten, und zwar mit den allerersten öffentlichen, kostenlosen Modellen wie ChatGPT 3.5. Das Ergebnis ist, dass viele Lehrende und Intellektuelle sich typische KI-Nutzende immer noch als Studierende vorstellen, die bei einem Essay schummeln wollen, oder als Assistenz, die KI-Slop einreicht. Das mag weltweit immer noch viel beiläufige KI-Nutzung beschreiben. Es beschreibt nicht, wie Spitzenforschende in den meisten Feldern mit diesen Werkzeugen arbeiten, oder wie irgendjemand, der KI verantwortungsbewusst und bedachtsam nutzen will, tatsächlich vorgeht.

Stefan Schubert hat das am treffendsten auf den Punkt gebracht: Wir unterschätzen die Rationalität anderer Menschen und gehen davon aus, dass sie neue Werkzeuge viel gedankenloser einsetzen, als sie es wirklich tun. Es gibt einen riesigen Raum zwischen dem Bitten von ChatGPT, ein ganzes Paper zu schreiben, und dem Selbstschreiben jedes einzelnen Wortes. Wenn man „selbst” schreibt, nutzt man bereits Abkürzungen. Man recherchiert nicht jede Referenz tiefgehend. Man googelt eine Statistik und vertraut der Schlagzeile. Man überfliegt ein Abstract und zitiert das Paper. Wer Ressourcen hat, lagert die Überprüfung an wissenschaftliche Hilfskräfte oder Faktenchecker aus. KI ermöglicht es, vieles davon systematischer, automatisierter und günstiger zu erledigen.

Wie viele andere glaubt Derek Thompson zu Recht, dass Schreiben Denken ist und dass das vollständige Auslagern des Schreibprozesses an KI den Geist leer lässt. Aber obwohl viel Schreiben Denken ist, ist Denken nicht nur Schreiben. Kunst machen ist Denken. Sprechen ist auch Denken. Wie Dina Pisareva argumentiert, ist auch Prompten Denken, wenn man auf der anderen Seite des Austauschs einen guten sokratischen Partner hat.

Thompson räumt auch ein, dass Schreiben immer das Greifen nach außen umfasste – nach Ideen, Fakten, Lektorat und Faktenchecks. Die Grenze zwischen legitimer Unterstützung und illegitimem Auslagern war immer unscharf, und KI hat diese Unschärfe nicht erzeugt. Sie hat sie nur unmöglich zu ignorieren gemacht. Thompsons eigenes Fazit: „Wir sollten ehrlich und offen über die Unschärfe sein, anstatt jeden mit einem offenen Claude-Fenster zur Slop-Klasse zu erklären.”

Was bedeutet das für Offenlegung? Viele gute Menschen und führende akademische Zeitschriften schlagen vollständige KI-Nutzungs-Offenlegung als Lösung vor. Aber Offenlegung ist spieltheoretisch nicht nachhaltig: Wer offenlegt, trägt Reputationskosten, während Heimlichtuende davon profitieren, sodass das Gleichgewicht in Richtung Nicht-Offenlegung driftet. Menschen wie Megan McArdle und ich sind lebende Beweise für dieses Problem. Und das bessere Framing, wie Ryan Briggs es formuliert, ist, dass KI Expertise ergänzt: automatisierte wissenschaftliche Hilfskräfte, die die eigene Arbeit prüfen, Argumente während des Arbeitsprozesses formalisieren, Daten auf Abruf sammeln. Es ist ein Multiplikator, der fähige Menschen schneller und besser denken lässt.

Meiner Einschätzung nach ist Offenlegung nur dann wirklich geboten, wenn das Publikum berechtigterweise von vollständig menschlich produzierter Arbeit ausgeht und diese Erwartung Teil dessen ist, wofür es zahlt. Die beste Analogie ist ein Livekonzert im engen Fall des persönlichen oder kreativen Schreibens: Wer ein Liveauftritt erwartet und der Künstler ist am Mitsingen, hat eine legitime Beschwerde. Genauer gesagt ist Offenlegung geboten, wenn Nicht-Offenlegung das Publikum über das Gebotene täuschen würde. Eine Journalistin oder ein Journalist, der unter einem Byline publiziert, verspricht Verantwortlichkeit und Originalität, nicht die Herkunft der Tastenanschläge. Eine Memoirenschreiberin verspricht beides. Der Test ist, wofür die Autorin oder der Autor den eigenen Namen einsetzt, nicht ob ein Werkzeug beteiligt war.

Aber Wissenschaft und Journalismus sind keine Liveauftritte. Sie geht es darum, neues Wissen zu entdecken und zu teilen. Niemand legt offen, dass er Rechtschreibprüfung, Hilfskräfte oder Google genutzt hat. Die Normen für kreatives Schreiben und Kunst werden anders sein – zu Recht, denn das Publikum zahlt dort zum Teil für die menschliche Erfahrung des Machens. Die Geisteswissenschaften werden durch einen langen und strittigen Prozess irgendwo dazwischen landen, wobei manche Freundschaften zerbrechen werden. Aber für Forschung und Journalismus bringt uns „alles offenlegen” nicht dorthin, wo wir hinmüssen. Was Leserinnen und Leser kümmern sollte, ist Genauigkeit und ob die Autorin oder der Autor vollständige Verantwortung für das Gedruckte übernimmt. Herkunft ist ein weit schwächeres Signal als beides.

28. Niemand weiß wirklich Bescheid, ich eingeschlossen. Das ist in Ordnung – wir werden es gemeinsam herausfinden.

Anfangs scheute ich Gespräche mit Journalistinnen und Journalisten über KI, weil ich kein Experte dafür bin, in keinem bedeutungsvollen Sinne. Aber ich erkenne zunehmend, dass niemand wirklich Experte für das ist, was das alles bedeutet, und dass das Warten auf jemanden mit dieser Expertise bedeutet, am Ende ohne Normen dazustehen. Ich halte mich weiterhin von Ratschlägen fern, außer Claude Code zu installieren (oder das agentische Werkzeug nach Wahl) und damit ein Problem anzugehen, das man gerade hat.

Wie üblich war Arthur Spirling in diesem Punkt direkt: Die KI-akademischen Accounts, die ständig „Ratschläge” an Kolleginnen, Kollegen und Doktorandinnen und Doktoranden verteilen, als wären sie in den Labors, in denen die Modelle entwickelt werden, sind ermüdend. Sie sind Zuschauerinnen und Zuschauer, wie wir alle.11 Selbst die Menschen in den Labors haben keine Ahnung, wie gut die Modelle über wenige Monate hinaus werden.

Wir befinden uns also in einer unangenehmen Situation: Jemand muss damit beginnen, die Normen des neuen Workflow-Umfelds zu etablieren, und die Menschen, die das tun, werden zwangsläufig Menschen sein, die nicht vollständig verstehen, wofür sie Normen schaffen. Das ist seltsam und unbequem. Es ist aber auch, wie die meisten institutionellen Übergänge wohl funktioniert haben, nur in viel langsamerem Tempo.

Wir haben eine Version davon durchgemacht, die wie eine Ewigkeit zurückliegt: als Professorinnen und Professoren akzeptieren mussten, dass das vollständige und akribische Überwachen der KI-Nutzung von Studierenden weder produktiv noch möglich war. Dasselbe gilt jetzt für Forschende. Man kann die Teile prüfen, die wirklich zählen – etwa den Replikationscode –, und LLMs machen das bereits einfacher. Herkunft ist das Einzige, das man nicht prüfen kann, und es ist das, womit wir keine Energie verschwenden sollten. Man muss den Anreizen folgen und Systeme aufbauen, die sicherstellen, dass die Werkzeuge gut eingesetzt werden, anstatt so zu tun, als würden sie gar nicht genutzt.

Bezüglich des Lehrens war ich im Forschungsurlaub, weshalb ich auch dort Ratschläge gemieden habe. Angesichts der vielen Fragen, die ich erhalten habe: Ich bin pessimistischer über die Auswirkungen von KI auf die Lehre als auf die Forschung. Ich nutze KI offen und ausgiebig in Forschung und Schreiben, plane aber, alle elektronischen Geräte in meinen Lehrveranstaltungen zu verbieten und schriftliche sowie mündliche Präsenzprüfungen wiedereinzuführen.

Das sind keine widersprüchlichen Positionen. Der Seminarraum ist genau der Ort, an dem Studierende die kognitiven Fähigkeiten aufbauen müssen, die KI-Kollaboration später produktiv machen. Man kann ein KI-Werkzeug nicht sinnvoll lenken, wenn man nie gelernt hat, ohne es zu denken. Die Sorge um Kompetenzatrophie aus Teil II ist hier am validesten: Studierende müssen die Grundlagen verinnerlichen, bevor sie sie auslagern. Forschung ist der Ort, an dem man die besten verfügbaren Werkzeuge einsetzt, um ein würdiges Ergebnis zu erzielen. Lehre ist der Ort, an dem man sicherstellt, dass die nächste Generation diese Werkzeuge auch wirklich gut nutzen kann.12

29. Die besten Arbeiten entstehen, wenn Mensch und KI zusammenarbeiten.

Ich sehe immer noch viele, die versprechen, KI beim Schreiben nicht zu nutzen. Das ist ungefähr so sinnvoll wie das Versprechen, keine Hilfe von wissenschaftlichen Hilfskräften oder Ko-Autorinnen bzw. Ko-Autoren anzunehmen. Also verspreche ich das Gegenteil: Ich werde die neuesten LLMs nutzen – und übrigens jedes andere verfügbare Werkzeug oder jede menschliche Ko-Autorin und jeden menschlichen Ko-Autor –, um meine Forschung oder die Art, wie ich sie kommuniziere, bestmöglich zu verbessern. Wenn mein Name draufsteht, können Sie sicher sein, dass es mein bestes Urteil widerspiegelt.

Viele Akademikerinnen und Akademiker, besonders in den Geisteswissenschaften, scheinen noch immer zu glauben, dass es darauf ankommt, wie viel Zeit man für seine Arbeit aufwendet. Aber die volkstümliche Arbeitswerttheorie ist in der Ökonomie falsch, und sie ist es auch hier. Wenn jemand Jahre damit verbringen möchte, alle Robustheitschecks manuell mit per Hand invertierten Matrizen durchzuführen statt ein paar R-Befehle auszuführen, oder Originalmanuskripte manuell zu übersetzen oder zu transkribieren – das ist ihre Sache. Mir war es egal, ob jene Internationalen-Studien-Professorinnen und -Professoren auf der ISA 10 oder 100 Stunden an ihren Slop-Präsentationen gearbeitet haben. Die Arbeit ist entweder gut oder nicht.

Dennoch gibt es einige Normen, die es wert sind, etabliert zu werden. Wenn man „Ich glaube” oder „Ich fühle” schreibt, sollte dieses Ich wirklich man selbst sein. Das Pronomen „ich” trägt ein implizites Versprechen einer menschlichen Stimme dahinter. Eine Sachaussage – etwa der korrekte Name der NATO – ist unabhängig davon, wer sie getippt hat. Persönliche Überzeugung hingegen nicht. Man denke an ein Livekonzert: Das Publikum zahlt für eine echte Aufführung, keine Playback-Einlage. Wer „ich” schreibt, hat dem Lesenden das Recht zugesichert, zu erwarten, dass es so gemeint ist. Das erfordert nicht, buchstäblich jedes Wort selbst zu tippen (oder zu diktieren). Man kann das Modell lenken, von eigenen Notizen ausgehen und das Ergebnis sorgfältig durchlesen – aber es erfordert, dass die Überzeugung die eigene ist.

Dieser Text zum Beispiel wurde offen und mit Stolz mithilfe eines iterativen Hin-und-Her-Gesprächs mit Claude Code verfasst, basierend auf meinen eigenen Ideen, Gesprächen mit Kolleginnen und Kollegen sowie hilfreichen Anregungen von akademischen und nicht-akademischen Kolleginnen und Kollegen.13 Teil I experimentierte mit KI-Fähigkeiten ohne menschliches Lektorat. Teil II spiegelte die Stimme zu 100% menschlich wider. Teil III, den Sie gerade lesen, verbindet meine Stimme mit KI-Fähigkeiten und schließt den Kreis. Ich überlasse Ihnen das Urteil, welcher der beste war.

Wo behalten Menschen also einen Vorteil? Wie Yiqing Xu argumentiert, wahrscheinlich in ergebnisoffenen Umgebungen, für die noch keine Trainingsdaten existieren, und in Aufgaben, die direkte menschliche Interaktion erfordern. Das könnte sich bald ändern. Aber wir haben diesen Beruf gewählt, weil wir Sinn darin finden, Dinge herauszufinden – nicht nur, weil wir immer noch besser darin sind. Deshalb sehe ich keinen Widerspruch darin, die meiste Routinearbeit an KI (oder wissenschaftliche Hilfskräfte, wenn man traditionelle Werte schätzt) auszulagern und sich auf das zu konzentrieren, was einem am meisten bedeutet: wichtige Fragen über die Welt stellen und sie mit den besten verfügbaren Werkzeugen beantworten.

30. Das eigentliche Risiko in der Wissenschaft ist menschlicher Slop in KI-Geschwindigkeit. Wir können das noch verhindern.

KI verstärkt das, was man ihr mitbringt. Wer echte Neugier und schwierige Fragen mitbringt, wird mit KI etwas produzieren, das es wert ist, gelesen zu werden. Wer nichts mitbringt, wird nichts schneller produzieren.

Aber es gibt Grund zum Optimismus. Dieselben Nature-Befunde, die zeigten, wie kaputt die Reproduzierbarkeit ist, zeigten auch, dass Zeitschriften mit obligatorischer Daten- und Code-Bereitstellung deutlich höhere Reproduzierbarkeitsraten aufwiesen. KI kann das bereits beschleunigen: Nichts außer Trägheit hindert Zeitschriften-Herausgebende daran, automatisierte Reproduzierbarkeitsprüfungen und obligatorische Code-Verifizierung als Einreichungsbedingung einzuführen. Diese Systeme können quasi-deterministisch aufgebaut werden, mit sehr geringem Fehlerraum, und Autorinnen und Autoren können eine automatische Desk-Rejection anfechten, wenn der interne agentische Workflow nicht ermitteln konnte, wie ihr Code zu reproduzieren ist.

Ambitionierter ausgedrückt: KI senkt die Kosten für groß angelegte, datenintensive Arbeiten, die früher erforderten, Raj Chetty mit einem 30-köpfigen Forschungsteam und Zugang zu allen Verwaltungsdatensätzen des Landes zu sein, oder Daron Acemoglu zu sein… mit Stift und Papier. Eine jüngere Forscherin oder ein jüngerer Forscher mit Codex kann heute Projekte in Angriff nehmen, die vor fünf Jahren logistisch unmöglich gewesen wären. Die Hürde für das, was publiziert wird, sollte steigen, denn die Hürde für das, was produziert werden kann, ist bereits gestiegen.

Der Standard hat sich nicht geändert: Wer den eigenen Namen auf etwas setzt, steht dafür gerade. Beurteile die Qualität des Outputs, nicht den Prozess. Die Diskussion über KI-Slop lenkt von der schwierigeren Frage ab, die wir uns längst vor den Chatbots hätten stellen sollen: Warum haben wir so viel menschlichen Slop überhaupt toleriert?

***

Mein Ziel, als ich Teil I veröffentlichte, war einfach: das Gespräch, das bereits hinter verschlossenen Türen und in Direktnachrichten stattfand, in die Öffentlichkeit zu bringen. Trotzdem höre ich von meinen Kolleginnen und Kollegen immer wieder dasselbe: „Alex, wir wissen, dass du KI nutzt, wir tun es auch, aber kannst du nicht einfach ruhig sein?”

Ich verstehe die Angst, dass KI unverantwortlich genutzt wird und mehr Slop produziert als verhindert. Aber wenn man darüber nachdenkt, ist „ruhig sein” nur das Eintreten für universelle Heuchelei als berufliche Norm. Ein Teil dessen, was ich wollte, war, dass die Unsicherheit, die alle über ihre Workflows und ihre Zukunft empfinden, zu einem stabileren Gleichgewicht findet. Das erfordert ehrliches Gespräch, keine Stille.

Und es geschieht bereits. Emily Oster hat kürzlich geteilt, wie Isaiah Andrews MIT-Doktorandinnen und -Doktoranden in der Ökonomie zu KI berät, und nannte es etwas, das allen Doktoranden-Kohorten zugänglich gemacht werden sollte. Wie Andy Hall anmerkte, war das Wichtigste daran nicht irgendeinen bestimmten Ratschlag, sondern das klare Signal hochrangiger Lehrender: Das ist etwas, das man ernst nehmen muss. Selbst Dylan Matthews, einer der nachdenklichsten Menschen im Journalismus, hat kürzlich zugegeben, dass die KI-Menschen in vielem recht hatten.

Der Wandel ist real. Akademikerinnen und Akademiker sind bereits halbwach, und sie werden nicht zurückgehen. Angehende Doktorandinnen und Doktoranden sowie Nachwuchsforschende sollten behutsam vorgehen, sich aber voll und ganz auf das Erlernen und Nutzen von KI-Werkzeugen einlassen. Die Forschenden, Intellektuellen und Schreibenden, die sich einer Auseinandersetzung verweigern, werden für ihre Reinheit nicht belohnt. Sie werden schlicht von Kolleginnen und Kollegen übertroffen, die dieselbe intellektuelle Strenge, dieselbe Neugier und bessere Werkzeuge mitbringen.

Ich sollte anerkennen, dass diese beiden Posts zusammen das Meistgelesene sind, was ich je geschrieben habe (mit oder ohne Claude). Auf Migrations- oder anderen Konferenzen sowie bei Hochschulverwaltungen im ganzen Land werde ich jetzt nach KI-Ratschlägen gefragt statt nach migrations- oder politikwissenschaftlichen Einschätzungen. Das sagt etwas darüber aus, wie ernst wir Dinge in diesem Feld nehmen – und auch, dass ich anfangen sollte, mehr für meine Vorträge und Beratungen zu verlangen. ↩

Ich möchte die ISA nicht ungerechterweise herausgreifen. Die Organisierenden arbeiteten unter echten Einschränkungen, es gab auf der Konferenz viele großartige Panels und ernsthafte Forschende, und ich habe an anderer Stelle über konkrete Wege geschrieben, akademische Konferenzen zu verbessern. ↩

Das ist wahrscheinlich die Aussage, die von frühen Leserinnen und Lesern dieses Textes am meisten Widerspruch erntete. Manche argumentieren, meine Verwendung von „Slop” dehne das Konzept zu weit, dass KI-Slop (überproduiert, poliert aber leer) und schlechte akademische Arbeit (nachlässig, unterproduziert) verschiedene Versagensmodi seien. Ich verabscheue normalerweise konzeptuelles Dehnen in wissenschaftlichem Schreiben, glaube aber wirklich nicht, dass das hier passiert. Was ich auf der ISA sah, war überproduizierte, bedeutungslose Arbeit, die wissenschaftlich aussah, aber nichts zum menschlichen Wissen beitrug. Das ist „Slop” nach jeder Definition. ↩

Ich kann bezeugen, dass viele Zitierungen meiner eigenen Arbeit kreative Neuinterpretationen dessen waren, was ich tatsächlich gefunden habe: vereinfachte Befunde, umgekehrte Schlussfolgerungen – was fast sicher darauf hindeutet, dass jene, die mich zitiert haben, meine Arbeit nicht gelesen haben. ↩

„Stochastic parrot” stammt aus einem Paper von 2021, mitautorisiert von der Linguistin Emily Bender, das argumentiert, große Sprachmodelle produzierten Text durch Vorhersage wahrscheinlicher Wortsequenzen, ohne zu verstehen. ↩

Dean W. Ball geht noch weiter und argumentiert, dass ein Großteil der KI-Leugnung auf der Linken auf einem Weltbild beruht, in dem die Technologiebranche aus „seichten Idioten” besteht, deren Leistungen immer oberflächlich sind, immer auf irgendeinem großen Diebstahl beruhen. Diese Heuristik mag für Krypto funktioniert haben. Für Werkzeuge, die Millionen von Forschenden und Schreibenden leise nutzen, um bessere Arbeit zu leisten, tut sie das nicht. ↩

Ich sage „aktiv eingesetzt”, weil es echte Belege dafür gibt, dass passives, unkritisches Verlassen auf KI kritisches Denken degradieren kann, besonders bei Routineaufgaben. Das ist eine echte Sorge, und deshalb argumentiere ich weiter unten, dass der Seminarraum der Ort ist, an dem Studierende die Grundlagen aufbauen müssen, bevor sie sie auslagern. ↩

Wie Hollis Robbins vor einem Jahr argumentierte, werden die einzigen Akademikerinnen und Akademiker, die im KI-Zeitalter ihren Wert behalten, jene sein, die an den Wissensfrontieren arbeiten. Je mehr Zeit vergeht, desto weniger empörend klingt dieses Argument. ↩

Lesen Sie unbedingt the Bayesian Hitman. Das wird Ihre Priors erschüttern. ↩

Wie Alison Gopnik und Kolleginnen und Kollegen kürzlich in Science argumentiert haben, lassen sich LLMs am besten als kulturelle Technologien verstehen – wie Schrift, Druck und Bibliotheken –, also als Werkzeuge, die neue Formen der Wissensproduktion ermöglichen, auch wenn sie nicht selbst „denken”. ↩

Die Ausnahme, die die Regel bestätigt, sind Aniket Panjwani und Scott Cunningham, die monatelang detaillierte Erfahrungsberichte darüber veröffentlicht haben, wie es wirklich aussieht, mit Claude Code zu forschen. Zumindest mir waren solche Berichte wirklich nützlich und ausschlaggebend dafür, meine KI-Reihe auf die Beine zu stellen. ↩

Dahinter steckt eine berechtigte Sorge: Doktorandinnen und Doktoranden, die die Grundlagen erlernen wollen, konkurrieren nun um Zeitschriftenplätze mit Professorinnen und Professoren, die Heerscharen von KI-Agenten haben. Das ist real, und deshalb lautet die Antwort für die Lehre nicht „KI für immer verbieten”. Die Antwort ist Scaffolding: erst lernen, ohne das Werkzeug zu denken, dann mit Urteilsvermögen einsetzen. ↩

Besonderer Dank gilt Steven Adler, Ryan Briggs, Tina Marsh Dalton, Josh Gellers, Jimmy Alfonso Licon, Igor Logvinenko, Ilia Murtazashvili, Kyle Saunders, Dina Pisareva, Quinn Que ❁, Ben Radford, Mike Riggs, Hollis Robbins, Jim Walsh, Sean Westwood, Yiqing Xu und Emma Zhang für ihre hilfreichen Anregungen und ihren kritischen Widerspruch. ↩