Merci de liker, partager, commenter et vous abonner. Cela contribue à faire grandir la newsletter sans contribution financière de votre part. Merci de votre lecture.

Dans la Partie I, j’ai soutenu que l’IA peut déjà faire de la recherche en sciences sociales mieux que la plupart des professeurs. Dans la Partie II, j’ai répondu à plus d’un millier de commentaires, concédant là où les critiques avaient raison, tout en maintenant mon argument principal : le statu quo académique était déjà défaillant, et l’IA ne fait qu’accélérer l’heure des comptes.1 Dans cette Partie III, rédigée en collaboration avec l’IA et mes pairs au cours du mois écoulé, je passe du diagnostic à ce que les universitaires peuvent et ne peuvent pas réellement faire face à cette situation.

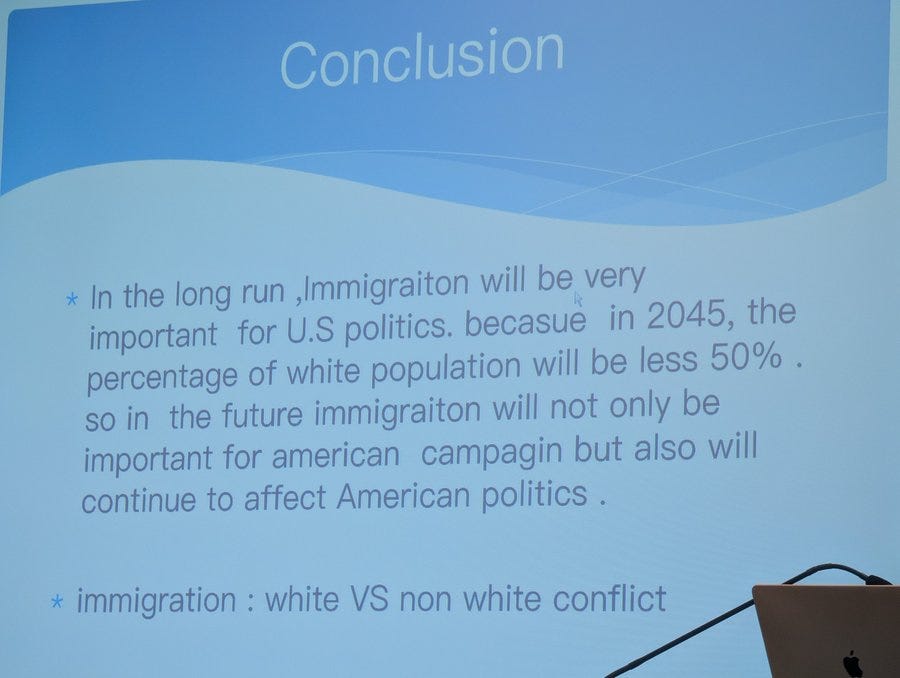

La cause immédiate de ce troisième volet sur l’IA est assez improbable : j’ai assisté au Congrès annuel 2026 de l’International Studies Association (ISA) à Columbus, dans l’Ohio — une conférence multidisciplinaire de premier plan regroupant les meilleurs spécialistes mondiaux des études internationales. Du moins, c’est ce qu’on m’avait dit. Ce que j’ai réellement observé, c’étaient des présentations si médiocres qu’elles auraient tout juste décroché un C dans l’un de mes cours : des arguments sans thèse ni cohérence, des fautes de grammaire qu’un correcteur orthographique basique aurait rattrapées, des intervenants lisant leurs diapositives comme s’ils découvraient leurs propres arguments bancals pour la première fois. Le tout sans aucune intervention de l’IA, pour autant que je puisse en juger, à en voir les fautes de frappe et les incohérences. Il ne s’agissait pas seulement d’étudiants en doctorat, mais de gens titulaires d’un PhD, d’une titularisation et de budgets de recherche.

Si le slop de l’IA est la crise que tout le monde redoute, je voudrais bien qu’on me dise comment appeler ce que j’ai vu à l’ISA, ou dans la plupart des grandes conférences en sciences sociales, d’ailleurs.2 Le contraste était impossible à ignorer : j’assistais à ces présentations au moment précis où je recevais des menaces de mort et des appels à mon licenciement en ligne pour avoir suggéré que l’IA peut faire de la recherche mieux que la plupart des professeurs. Cette juxtaposition a cristallisé l’argument de cet article.

21. La grande majorité du “slop” a toujours été et reste du slop humain.

Ma première thèse était la chose la plus provocatrice que j’aie dite, et je ne l’ai que légèrement nuancée depuis : l’IA agentique peut déjà accomplir la plupart des tâches de recherche en sciences sociales mieux que la plupart des professeurs dans le monde. Je la maintiens. Dans mon récent entretien avec la Chronicle, ils l’ont formulé plus crûment : « AI Is a Better Researcher Than You. » Si vous n’y croyez toujours pas, parlons-en dans quelques années.

Mais la contrepartie est tout aussi importante. Si l’IA peut produire de meilleurs résultats de recherche que les professeurs, c’est aussi une condamnation de ce que ces professeurs produisaient et produisent encore sans elle.

“Slop” était le mot de l’année 2025 de Merriam-Webster, défini comme du contenu numérique de mauvaise qualité produit par l’IA. Mais la conférence de l’ISA rappelait que l’immense majorité du slop a toujours été du slop humain. Le système des revues académiques et les grandes conférences dans une grande partie des sciences humaines et sociales étaient des usines à slop bien avant que quiconque ait un abonnement à ChatGPT. Oui, je veux vraiment dire que la plupart des recherches sont du slop.3

Une partie relève aussi de ce que le philosophe Harry Frankfurt appellerait du “bullshit” : des travaux indifférents à la vérité de leurs affirmations, en particulier sur des sujets politiquement chargés comme l’immigration, où les chercheurs partent de la conclusion de gauche et remontent le fil. Mais le slop est plus large que le bullshit. Il comprend aussi des travaux qui ne formulent aucune thèse, des travaux supposés avoir une valeur artisanale et qui échouent simplement. Le chercheur qui trouve un jeu de données avant d’avoir une question, puis creuse jusqu’à obtenir des résultats significatifs publiables, produit du slop. Ces chercheurs existaient bien avant l’IA. Ils étaient juste plus lents.

22. Les universitaires hallucinaient et trichaient avant l’IA.

Les inquiétudes sur l’hallucination et la triche que les gens soulèvent à propos de l’IA dans le monde académique décrivent des problèmes qui la précèdent de plusieurs décennies, voire de siècles. Un vaste projet publié ce mois-ci dans Nature (auquel j’ai modestement contribué) a testé des centaines d’articles en sciences sociales : seule environ la moitié des résultats statistiquement significatifs se sont répliqués, avec des tailles d’effet médianes en forte diminution. Cette étude confirme ce que la collaboration Open Science de 2015 avait déjà trouvé en psychologie seule — où environ deux tiers des résultats n’étaient pas réplicables — et l’étend à d’autres disciplines.

Avant l’IA, nous n’appelions pas cela des “hallucinations”. Nous appelions cela de la “science”. Réfléchissez-y : hallucination et inspiration ne sont pas si différentes qu’il y paraît. Les deux consistent à générer des combinaisons qui vont au-delà des données d’entrée. On parle d’hallucination quand le résultat est faux, et de découverte quand il est juste.

Par ailleurs, les universitaires citent régulièrement des articles dont ils n’ont lu que le résumé.4 Au moins, les taux d’hallucination de l’IA sont suivis et s’améliorent. Ceux des humains dans le milieu académique ne le sont pas du tout. On les appelle simplement des “contributions à la littérature.” Et si vous êtes relecteur, vous n’avez même pas besoin d’halluciner vous-même : vous écrivez “veuillez me citer” et vous passez à autre chose.

Certaines recherches sont genuinement excellentes. Mais avant de s’inquiéter de la triche assistée par l’IA, reconnaissons un instant la triche humaine. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely : la liste des grandes affaires de fraude ne cesse de s’allonger, et ce ne sont là que les personnes qui ont été prises. Indépendamment de la fabrication pure et simple, le p-hacking, le HARKing (hypothesizing after results are known) et le biais de publication étaient pendant des années si répandus qu’ils étaient à peine perçus comme des manquements à l’éthique. Des progrès réels ont été accomplis dans la compréhension de ces pratiques, mais elles restent suffisamment courantes pour influencer ce qui se publie. Par ailleurs, des professeurs chevronnés ont toujours mis leur nom sur des articles rédigés principalement par des doctorants, et des ouvrages entiers ont été assemblés par des équipes d’assistants de recherche sous le nom d’un chercheur célèbre. Rien de tout cela n’était considéré comme de la triche — jusqu’à ce que l’IA rende le procédé moins cher et plus visible.

23. La métaphore du “perroquet stochastique” décrit mieux les humains que l’IA.

L’un des slogans les plus influents du débat sur l’IA5 a toujours fonctionné comme un cliché qui coupe court à la réflexion. Comme l’a observé Cate Hall, c’est une formule percutante : agréable à prononcer, économe sur le plan conceptuel, et elle a durablement colonisé l’esprit de nombreuses personnes, malgré le fait qu’elle ne corresponde pas aux modèles actuels. Une véritable œuvre d’art linguistique. Elle est également empiriquement fausse : tous les grands modèles de frontière depuis GPT-4 ont été entraînés sur des données non textuelles, et la logique même de l’argument original ne fonctionne qu’avec un entraînement sur texte uniquement.

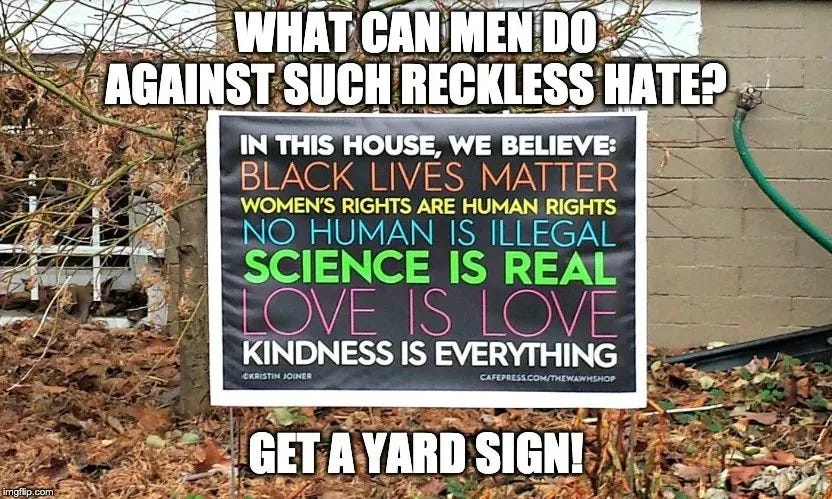

Considérons maintenant quelque chose de complètement différent, mais de très familier : les pancartes “In This House We Believe” qu’on voit dans les jardins américains. Science Is Real. Love Is Love. No Human Is Illegal, etc. On peut adhérer à chaque ligne et n’avoir aucune position politique cohérente sur aucun de ces sujets. Que signifie “no human is illegal” pour la politique d’application de la loi : frontières ouvertes, amnistie, autre chose ? La pancarte ne le dit pas, parce que le dire exigerait d’affronter des contradictions. C’est un serment d’allégeance, pas un argument.

Des gens ont moqué cette pancarte pendant des années.

Mais le point plus profond est que c’est exactement ce pour quoi l’IA est critiquée : produire des déclarations superficielles et rassurantes qui communiquent une appartenance plutôt qu’un sens. Il s’avère que les humains font cela avec ou sans IA depuis aussi longtemps qu’ils ont des jardins où planter des pancartes.

La pancarte de jardin n’est pas une exception. C’est ainsi que la plupart des gens semblent aborder la plupart des sujets : adopter la position de son groupe, la répéter, passer à autre chose. Le fond de ce qu’on argumente compte bien plus que la façon dont on le formule, mais la formulation est plus facile — c’est pourquoi elle domine le discours public, des fils Twitter aux présentations de conférence.

Je l’ai vu de mes propres yeux à l’ISA, où des collègues titularisés présentaient des travaux qui équivalaient à l’équivalent académique d’une pancarte de jardin, agrémentés de quelques régressions mal identifiées pour leur donner un vernis scientifique. La critique du perroquet stochastique visait à diminuer l’IA. Elle s’est révélée être une meilleure description de la vie intellectuelle humaine que quiconque ne l’avait prévu.

24. Oui, des adultes consentants peuvent utiliser l’IA pour écrire. La surveiller ne fonctionne pas.

Dans la Partie II, j’ai noté que les détecteurs d’IA sont souvent peu utiles et créent plus de problèmes qu’ils n’en résolvent. Mais le problème plus profond est l’impulsion qui les sous-tend : la conviction que l’implication de l’IA est intrinsèquement contaminante, quoi qu’elle produise. Quinn Que avance une thèse fascinante : l’obsession des détecteurs d’écriture IA ressemble à l’application d’une “règle de la goutte”, ce principe de la classification raciale américaine du XIXe siècle : toute trace d’IA contamine l’ensemble du travail, indépendamment de sa qualité ou de l’intention de l’auteur.

J’étais initialement sceptique face à l’analogie, mais elle est assez juste. Dans la vision de l’activiste anti-IA, tout mot que vous n’avez pas écrit vous-même est une pollution morale. Bien qu’utiliser l’IA pour écrire ne soit pas techniquement “illégal”, il existe en substance une règle de la goutte qui détermine si vous êtes un auteur légitime ou un fraudeur, une bonne ou une mauvaise personne. D’où les condamnations et les menaces de mort adressées à des gens comme moi qui divulguent leur usage de l’IA pour “avoir sous-traité leur pensée à la machine.”

Comme je l’ai soutenu dans la Partie I, une grande partie de l’opposition à l’IA est une protection de statut déguisée en principe. Andy Masley va plus loin, arguant que la panique morale autour des chatbots pourrait avoir une source au-delà du projet de statut. Cette source s’apparente davantage à de la superstition (“les chatbots sont démoniaques”) : le sentiment que le texte produit par l’IA est spirituellement souillé, qu’il y a quelque chose d’anormal ou même de maléfique dans une machine capable d’écrire, quoi qu’elle écrive.6

Même Megan McArdle, qui a récemment divulgué honorablement son usage de l’IA et déclenché chez les journalistes la même conversation que les universitaires avaient sur Bluesky quelques mois plus tôt, s’est sentie obligée de se défendre en insistant sur le fait que “l’IA n’a pas touché au texte final.” Je l’admire d’avoir parlé. Mais pourquoi la question du texte final devrait-elle même poser problème ? Si le travail est bon et le processus est divulgué, le reste n’est qu’une préférence esthétique habillée en éthique. Où commence l’impureté ? La recherche sur Google ? La correction automatique ? Le correcteur orthographique ? La transcription automatique ?

Et même en mettant tout cela de côté : sauf dans un scénario de type Dune — catastrophe liée à l’IA suivie d’une coordination mondiale pour bannir la technologie — l’écriture non fictionnelle largement assistée par l’IA est presque inévitable à l’équilibre, compte tenu des incitations existantes. Il vaut la peine de mentionner la contrepartie : même si vous parvenez à écrire entièrement sans “pollution IA”, personne ne vous récompensera de sitôt pour cette pureté.

25. Ne pas utiliser les derniers outils d’IA dans sa recherche et son écriture relève de la faute professionnelle.

Matthew Yglesias a récemment soutenu que les LLM sont sous-utilisés dans le journalisme. Son argument s’applique tout autant aux universitaires : le but de la recherche, c’est le résultat utile, pas le processus médié par l’humain. La rigueur doit être dans la réflexion et la vérification, pas dans le fait qu’un humain ou une machine ait tapé les phrases ou appuyé sur entrée pour lancer les régressions dans R. Comme Hollis Robbins l’a bien formulé, les professeurs devraient probablement tester des modèles d’IA avant le petit-déjeuner (en gros, être comme Scott Cunningham).

L’usage le plus banal de l’IA, c’est la correction d’erreurs. Prenons le titre du New York Times du 3 avril 2026 : “A North American Treaty Organization Without America?” Le nom correct est bien sûr la North Atlantic Treaty Organization. Le Times a publié un correctif le lendemain. Certains ont spéculé que l’erreur avait été causée par l’IA. On ne le saura jamais, et franchement, peu importe. N’importe quel workflow LLM suffisamment intelligent aurait détecté l’erreur en quelques secondes. Une simple vérification automatique de tous les titres — “Ce texte contient-il des erreurs ? Vérifier contre deux sources indépendantes” — aurait épargné au Times un cycle d’actualité embarrassant.

Mais la vérification des faits n’est que le plancher, pas le plafond. L’usage plus intéressant consiste à faire ce qui n’était pas possible auparavant. Ma co-auteure désormais, Kelsey Piper, a récemment demandé à Codex de lui créer un site web interactif pour l’aider à réellement comprendre un article de science politique qu’elle évaluait, puis a elle-même accompli la tâche de la façon dont les participants de l’étude l’avaient fait. L’IA ne fait pas que comprimer le temps de production d’un résultat. Elle abaisse le coût du type d’engagement actif que la plupart des chercheurs évitent : construire la chose soi-même, soumettre un argument à un test de résistance, réexécuter une analyse comme l’ont fait les participants. C’est ce que requiert une compréhension plus profonde.

La même logique vaut pour le monde académique. La moitié des présentations auxquelles j’ai assisté à Columbus auraient pu être significativement améliorées par un passage rapide dans ChatGPT : vérification de la grammaire, resserrement des arguments, détection des lacunes logiques. Ces outils sont gratuits ou presque. Choisir de ne pas les utiliser, c’est choisir de livrer un travail moins bon que ce dont on est capable — surtout quand on a pour vocation d’informer le public. Mais journalistes et universitaires ne devraient pas utiliser l’IA uniquement pour corriger des coquilles dans les titres. Ils devraient l’utiliser pour créer des visualisations interactives, soumettre des arguments à des tests de résistance, et comprendre réellement les choses complexes sur lesquelles ils écrivent.

Mais qu’en est-il de l’écriture elle-même ? Vous avez peut-être entendu cette réponse courante adressée à quiconque utilise l’IA dans son écriture : “Pourquoi lirais-je l’article plutôt que le prompt qui l’a généré ?” Ça semble raisonnable, non ? Eh bien, non, si on y réfléchit un peu.

Pourquoi manger le repas plutôt que de lire la liste de courses ? Pourquoi regarder un graphique plutôt que le script ggplot ? Pourquoi lire le livre plutôt que les notes de l’auteur ? Le prompt ne vous apporte aucune connaissance nouvelle. Le résultat, si. C’est tout l’enjeu. Comme je l’ai soutenu dans la Partie II, des personnes différentes avec des expertises, des données et des contextes différents (tels qu’ils se manifestent dans leurs fichiers claude.md) produisent des résultats entièrement différents à partir du même prompt. C’est une question de compétence.

Je comprends : ça peut sembler étrange de passer plus de temps à lire quelque chose que l’auteur n’en a passé à le produire. Mais nous avons déjà vécu cela. Un graphique généré en quelques secondes dans R peut prendre des minutes à lire attentivement. Personne ne réclame ni ne fantasme de voir uniquement le code plutôt que le graphique. On évalue le graphique et ce qu’il dit — la connaissance nouvelle qui n’existait pas auparavant.

26. Les LLM peuvent bel et bien produire de nouvelles connaissances.

Comme l’a récemment documenté John Burn-Murdoch, les chatbots IA orientent systématiquement les utilisateurs vers le consensus des experts, à l’inverse de ce que font les réseaux sociaux. Ces outils ne vous aident pas seulement à mieux écrire. Utilisés activement, ils vous aident à penser plus rigoureusement.7 Ainsi, les LLM pourraient même inverser la montée du populisme. Mais la vérification des faits n’est pas la même chose que la production de nouvelles connaissances.

Avant de nous demander si les LLM peuvent produire des idées genuinement nouvelles (il existe de bons exemples en ce sens), nous devrions nous demander combien d’humains le font. La plupart des universitaires passent leur carrière à recombiner des idées existantes en variations mineures, à appliquer les mêmes méthodes à des jeux de données légèrement différents, produisant des travaux incrémentaux que personne en dehors de leur sous-discipline ne lira jamais. La pensée originale est extraordinairement difficile et rare à chaque génération. Je ne dis pas cela pour insulter mes collègues (ni moi-même). Mais le seuil que les LLM doivent franchir est plus bas que nous aimons l’admettre.8

Mon ami Robert Kubinec, brillant méthodologue politique et auteur de fiction publié9 à l’Université de Caroline du Sud, semble assez sceptique à l’égard d’une grande partie de l’engouement pour l’IA. Il soutient que “les LLM ne créent jamais de connaissance, [laquelle] n’existe que dans les cerveaux humains. Ils ne peuvent que comparer un ensemble de connaissances à un autre.” Je respecte Bob, donc c’est bien si nous ne sommes pas d’accord. Ma réponse : la question philosophique sur la conscience de soi est réelle, mais elle est orthogonale à la question pratique. Que le modèle “comprenne” ou non quoi que ce soit, le résultat contient ou non des informations nouvelles utiles aux humains.10

L’exemple récent le plus suggestif est Claude Mythos, le nouveau modèle de frontière d’Anthropic. En quelques semaines de tests, il a signalé des milliers de vulnérabilités de sécurité jusque-là inconnues dans les principaux systèmes d’exploitation et navigateurs, dont une qui était passée inaperçue pendant 27 ans. Appelez ça comme vous voulez, “comparer un ensemble de connaissances à un autre” ne rend pas tout à fait compte du phénomène.

Les meilleures théories conceptuelles en sciences sociales sont déjà des recombinaisons d’idées existantes. Anthony Downs a bâti sa théorie du choix rationnel en transposant la maximisation de l’utilité microéconomique dans le domaine du vote, et a littéralement intitulé son livre An Economic Theory of Democracy. Baumgartner et Jones ont emprunté l’équilibre ponctué à la biologie évolutive et l’ont appliqué à l’élaboration des politiques publiques. L’analyse des réseaux sociaux a importé en bloc la théorie des graphes des mathématiques. Axelrod a fusionné le dilemme du prisonnier avec la sélection par aptitude évolutive. Alexander Wendt est allé encore plus loin en appliquant la théorie quantique aux relations internationales dans Quantum Mind and Social Science — une démarche que beaucoup ont trouvée (à juste titre) ridicule, mais que Cambridge University Press a tout de même publiée. Les sciences sociales inventent rarement à partir de rien. Elles traduisent d’un domaine à l’autre, et la traduction est la contribution théorique.

C’est structurellement identique à ce que font les LLM : recombiner des schémas et des concepts d’un contexte à l’autre. Parfois le résultat est absurde. Parfois il est fécond. Il en va de même pour la recombinaison humaine. L’IR quantique de Wendt a été critiqué comme une simple métaphore déguisée en physique, mais comme mentionné ci-dessus, Cambridge University Press l’a publié. Si cela compte comme production de connaissance, il est difficile de voir pourquoi les recombinaisons générées par les LLM ne le seraient pas.

À son crédit, Bob a concédé le point pratique tout en maintenant le philosophique : “la question est de savoir comment utiliser cette capacité pour faire avancer la connaissance.” Exactement. Comme je l’ai dit dans la Partie I, cessez de débattre pour savoir si les LLM “comprennent vraiment” pendant que les personnes ayant le plus à perdre utilisent déjà ces outils pour améliorer leur travail.

27. Pour les critiques, le modèle mental de l’utilisateur d’IA est figé en 2023, ce qui fait une éternité.

Rappelons comment nous en sommes arrivés là. Les étudiants ont commencé à utiliser l’IA avec enthousiasme avant leurs professeurs, en adoptant les tous premiers modèles publics et gratuits comme ChatGPT 3.5. Résultat : de nombreux professeurs et intellectuels imaginent encore l’utilisateur type de l’IA comme un étudiant de licence essayant de tricher sur une dissertation, ou comme un assistant soumettant du slop généré par IA. C’est peut-être encore le cas pour une grande partie de l’usage désinvolte de l’IA dans le monde. Ce n’est pas ainsi que les meilleurs chercheurs dans la plupart des disciplines travaillent avec ces outils, ni comment quiconque cherche à les utiliser de manière responsable et réfléchie.

Stefan Schubert l’a dit le mieux : nous sous-estimons la rationalité des autres, en supposant qu’ils appliquent les nouveaux outils de manière bien plus irréfléchie qu’ils ne le font réellement. Il existe un vaste espace entre demander à ChatGPT de rédiger un article entier et taper chaque mot soi-même. Quand vous écrivez “vous-même”, vous utilisez déjà des raccourcis. Vous ne faites pas de recherches approfondies sur chaque référence que vous citez. Vous cherchez une statistique sur Google et faites confiance au chiffre du titre. Vous parcourez un résumé et citez l’article. Si vous en avez les moyens, vous externalisez la vérification à un assistant de recherche ou un fact-checker. L’IA vous permet de faire une grande partie de tout cela de façon plus systématique, automatisée et économique.

Comme beaucoup, Derek Thompson croit à juste titre que l’écriture est une forme de pensée, et que déléguer l’intégralité du processus d’écriture à l’IA laisse l’esprit vide. Mais, même si une grande partie de l’écriture est une forme de pensée, la pensée ne se réduit pas à l’écriture. Faire de l’art, c’est penser. Parler aussi. Comme Dina Pisareva le soutient, rédiger des prompts est aussi une forme de pensée, si on a un bon partenaire socratique de l’autre côté de l’échange.

Thompson reconnaît lui-même que toute écriture a toujours impliqué de puiser en dehors de l’esprit de l’auteur des idées, des faits, de l’édition et de la vérification. La frontière entre assistance légitime et externalisation illégitime a toujours été floue, et l’IA n’a pas créé ce flou. Elle l’a simplement rendu impossible à ignorer. La propre conclusion de Thompson : “Nous devrions être honnêtes et transparents à propos de ce flou plutôt que de déclarer que toute personne ayant une fenêtre Claude ouverte fait partie de la slopclass.”

Où cela nous laisse-t-il sur la question de la divulgation ? De nombreuses personnes bien intentionnées et de grandes revues académiques préconisent une divulgation complète de l’usage de l’IA. Mais la divulgation n’est pas viable dans une logique de théorie des jeux : ceux qui divulguent supportent des coûts réputationnels tandis que les utilisateurs discrets en profitent gratuitement, si bien que l’équilibre pousse vers la non-divulgation. Des gens comme Megan McArdle et moi en sommes la preuve vivante. Et le meilleur cadrage, comme le formule Ryan Briggs, est que l’IA complète l’expertise : des RA automatisés qui vérifient votre travail, formalisent vos arguments au fur et à mesure, collectent des données à la demande. C’est un multiplicateur qui permet aux personnes compétentes de penser mieux et plus vite.

Mon sentiment est que le seul cas où la divulgation est genuinement due est celui où le public a une attente raisonnable d’un travail entièrement produit par un humain, et que cette attente fait partie de ce pour quoi il paye. La meilleure analogie est celle d’un concert live dans le cas particulier de l’écriture personnelle ou créative : si vous venez pour une performance live et que l’artiste chante en playback, c’est une plainte légitime. Plus précisément, la divulgation est due quand la non-divulgation induirait le public en erreur sur ce qu’il reçoit. Un journaliste qui publie sous son nom promet responsabilité et originalité, pas la provenance de chaque frappe de clavier. Un mémorialiste promet les deux. Le critère, c’est ce que l’auteur met sous son nom, pas si un outil a été utilisé.

Mais la science et le journalisme ne sont pas des concerts. Ils ont pour objet de découvrir et de partager de nouvelles connaissances. Personne ne divulgue qu’il a utilisé un correcteur orthographique, des assistants de recherche ou une recherche Google. Les normes pour l’écriture créative et artistique seront différentes, à juste titre, parce que le public y paye en partie pour l’expérience humaine de création. Les sciences humaines atterriront probablement quelque part entre les deux, au terme d’un processus long et conflictuel, avec quelques amitiés brisées en chemin. Mais pour la recherche et le journalisme, “tout divulguer” ne nous mène pas où nous devons aller. Ce que les lecteurs devraient exiger, c’est la fiabilité et que l’auteur assume l’entière responsabilité de ce qui est sur la page. La provenance est un signal bien plus faible que l’une ou l’autre.

28. Personne ne sait vraiment ce qui se passe, moi y compris. C’est acceptable — nous allons comprendre ensemble.

J’ai d’abord hésité à parler à des journalistes de l’IA, parce que je n’en suis expert en aucun sens significatif du terme. Mais je réalise de plus en plus que personne n’est vraiment expert dans ce que tout cela représente, et qu’attendre l’émergence d’un tel expert est la meilleure façon de se retrouver sans normes du tout. Je continue à hésiter à donner des conseils au-delà d’installer Claude Code (ou l’outil agentique de votre choix) et de lui parler pour résoudre un problème concret.

Comme à son habitude, Arthur Spirling a été direct sur ce point : les comptes “IA et académie” qui offrent sans cesse des “conseils” à leurs collègues et aux doctorants, comme s’ils travaillaient dans les laboratoires développant les modèles, sont fastidieux. Ce sont des spectateurs, comme nous tous.11 Même les personnes dans les laboratoires n’ont aucune idée de l’évolution des modèles au-delà de quelques mois.

Nous sommes donc dans une position inconfortable : quelqu’un doit commencer à établir les normes du nouvel environnement de travail, et les personnes qui le feront seront inévitablement des gens qui ne comprennent pas entièrement ce pour quoi ils établissent des normes. C’est étrange et inconfortable. C’est aussi probablement ainsi que se sont déroulées la plupart des autres transitions institutionnelles, mais à un rythme bien plus lent.

Nous avons traversé une version de cela qui semble remonter à une autre époque, quand les professeurs ont dû accepter que surveiller pleinement et méticuleusement l’usage de l’IA par les étudiants n’était ni productif ni possible. Il en va de même maintenant pour les chercheurs. Vous pouvez auditer les éléments qui comptent vraiment, comme le code de réplication, et les LLM facilitent déjà cette tâche. La provenance est la seule chose que vous ne pouvez pas auditer, et c’est précisément sur elle que nous ne devrions pas dépenser notre énergie. Il faut suivre les incitations et construire des systèmes qui garantissent que les outils sont bien utilisés, plutôt que de prétendre qu’ils ne sont pas utilisés du tout.

Sur la question connexe de l’enseignement : j’étais en congé sabbatique, aussi ai-je également évité de donner des conseils dans ce domaine. Compte tenu des nombreuses questions que j’ai reçues, je suis plus pessimiste quant aux effets de l’IA sur l’enseignement que sur la recherche. Par exemple, alors que j’utilise l’IA ouvertement et extensivement dans ma recherche et mon écriture, je prévois d’interdire tous les appareils électroniques dans mes cours substantiels et de rétablir des examens écrits et oraux en présentiel.

Ce ne sont pas des positions contradictoires. La salle de cours est précisément l’endroit où les étudiants doivent développer les compétences cognitives qui rendent la collaboration avec l’IA productive par la suite. On ne peut pas diriger efficacement un outil d’IA si on n’a jamais appris à penser sans lui. La crainte d’atrophie des compétences évoquée dans la Partie II est la plus valide ici : les étudiants doivent intérioriser les fondamentaux avant de les externaliser. La recherche, c’est l’endroit où l’on déploie les meilleurs outils disponibles pour produire un résultat digne. L’enseignement, c’est l’endroit où l’on s’assure que la prochaine génération peut réellement bien utiliser ces outils.12

29. Les meilleurs travaux naissent de la collaboration entre humains et IA.

Je vois encore beaucoup de gens s’engager à ne pas utiliser l’IA dans leur écriture. C’est à peu près aussi sensé que de s’engager à ne pas accepter l’aide d’assistants de recherche ou de co-auteurs. Je prends donc l’engagement inverse : j’utiliserai les derniers LLM, et d’ailleurs tout autre outil ou co-auteur humain disponible, pour améliorer au mieux ma recherche ou la façon dont je la communique. Ainsi, si mon nom est dessus, vous pouvez être certain que cela reflète mon meilleur jugement propre.

De nombreux universitaires, en particulier dans les sciences humaines, semblent encore croire qu’il importe de savoir combien de temps vous passez à faire votre travail. Mais la théorie populaire de la valeur-travail est fausse en économie, et elle est fausse ici aussi. Si vous êtes du genre à vouloir passer des années à effectuer toutes vos vérifications de robustesse manuellement avec des matrices inversées à la main plutôt que d’exécuter quelques commandes R, ou à traduire ou transcrire manuellement des manuscrits originaux, c’est votre affaire. Je me souciais peu de savoir si ces professeurs en études internationales à l’ISA avaient passé 10 ou 100 heures sur leurs présentations en slop humain. Le travail est bon ou il ne l’est pas.

Cela dit, certaines normes méritent d’être établies. Quand vous écrivez “je crois” ou “je ressens”, ce “je” doit genuinement être vous. Le pronom “je” porte une promesse implicite d’une voix humaine derrière lui. Une affirmation factuelle, comme le nom correct de l’OTAN, n’a que faire de qui l’a tapée. Mais une conviction personnelle, si. Pensez à un concert live : le public paye pour une vraie performance, pas du playback. Quand vous utilisez “je”, le lecteur est en droit de s’attendre à ce que vous le pensiez vraiment. Cela n’exige pas de taper (ou dicter) littéralement chaque mot vous-même. Vous pouvez diriger le modèle, travailler à partir de vos notes, le relire attentivement — mais cela exige que la conviction soit la vôtre.

Cet article, par exemple, a été ouvertement et fièrement rédigé au moyen d’une conversation itérative avec Claude Code, fondée sur mes idées originales, des échanges avec mes pairs, et de suggestions utiles de collègues universitaires et non universitaires.13 La Partie I expérimentait les capacités de l’IA sans édition humaine. La Partie II reflétait une voix 100 % humaine. La Partie III, que vous lisez à présent, combine ma voix et les capacités de l’IA, bouclant la boucle. Je vous laisse juger laquelle était la meilleure.

Où les humains conservent-ils donc un avantage ? Comme Yiqing Xu le soutient, probablement dans des environnements ouverts où les données d’entraînement n’existent pas encore et dans des tâches qui requièrent une interaction humaine directe. Cela pourrait changer prochainement. Mais nous avons choisi cette carrière parce que nous trouvons du sens à résoudre des problèmes, pas seulement parce que nous y sommes encore meilleurs. C’est pourquoi je ne vois aucune contradiction à externaliser la plupart des tâches répétitives à l’IA (ou aux RA, si vous êtes de tendance traditionnelle) et à me concentrer sur ce qui a le plus de sens pour moi — formuler des questions importantes sur le monde et y répondre avec les meilleurs outils disponibles.

30. Le vrai risque en science, c’est le slop humain à vitesse IA. Nous pouvons encore l’éviter.

L’IA amplifie ce que vous lui apportez. Apportez-lui une curiosité genuine et des questions difficiles, et elle vous aidera à produire quelque chose qui vaut la peine d’être lu. N’apportez rien, et vous produirez rien plus vite.

Mais il y a des raisons d’être optimiste. Les mêmes résultats de Nature qui ont révélé à quel point la reproductibilité est défaillante ont également montré que les revues imposant le partage obligatoire des données et du code avaient des taux de reproductibilité significativement plus élevés. L’IA peut déjà accélérer cette démarche : rien d’autre que l’inertie n’empêche les éditeurs de revues d’instaurer des vérifications automatisées de la reproductibilité et une validation obligatoire du code comme condition de soumission. Ces systèmes peuvent être configurés de manière quasi déterministe, avec très peu de marge d’erreur, et les auteurs peuvent toujours contester un rejet automatique à la première lecture s’ils estiment que le workflow agentique en interne n’a pas correctement déterminé comment reproduire leur code.

Plus ambitieusement, l’IA abaisse le coût des travaux à grande échelle et à forte intensité de données qui nécessitaient autrefois d’être Raj Chetty avec une équipe de 30 assistants de recherche et l’accès à toutes les bases de données administratives du pays, ou Daron Acemoglu… avec un crayon et du papier. Un jeune chercheur disposant de Codex peut désormais tenter des projets qui auraient été logistiquement impossibles il y a cinq ans. Le seuil de ce qui peut être publié devrait s’élever, parce que le seuil de ce qui peut être produit a déjà augmenté.

Le critère n’a pas changé : si vous mettez votre nom sur quelque chose, vous en répondez. Jugez la qualité du résultat, pas du processus. La conversation sur le slop de l’IA est une distraction par rapport à la question plus difficile, celle que nous aurions dû poser bien avant l’arrivée des chatbots : pourquoi avons-nous toléré autant de slop humain en premier lieu ?

***

Mon objectif en publiant la Partie I était simple : faire passer dans l’espace public la conversation qui se tenait déjà derrière des portes closes et en messages privés. Pourtant, j’entends encore la même chose de mes collègues : “Alex, on sait que tu utilises l’IA, nous le faisons aussi, mais tu ne pourrais pas juste te taire ?”

Je comprends la crainte que l’IA soit utilisée de façon irresponsable, produisant plus de slop qu’elle n’en prévient. Mais réfléchissez-y : “tais-toi” revient simplement à préconiser l’hypocrisie universelle comme norme professionnelle. Une partie de ce que je souhaitais, c’était que l’incertitude que tout le monde éprouve à propos de ses workflows et de son avenir atteigne un équilibre plus stable. Pour cela, il faut une conversation honnête, pas le silence.

Et cela est déjà en train de se produire. Emily Oster a récemment partagé les conseils d’Isaiah Andrews sur l’IA destinés aux doctorants en économie du MIT, en les qualifiant de quelque chose qui devrait être diffusé à toutes les promotions de doctorat. Comme Andy Hall l’a noté, le plus important n’était pas tel ou tel conseil en particulier, mais le signal clair envoyé par des enseignants de haut rang : c’est quelque chose qu’il faut prendre au sérieux. Même Dylan Matthews, l’une des personnes les plus réfléchies du journalisme, a récemment admis que les partisans de l’IA avaient eu raison bien des fois.

Le changement est réel. Les universitaires sont déjà à moitié éveillés, et ils ne feront pas marche arrière. Les futurs doctorants et jeunes chercheurs devraient avancer avec prudence, mais embrasser pleinement l’apprentissage et l’usage des outils d’IA. Les chercheurs, intellectuels et écrivains qui refuseront de s’y engager ne seront pas récompensés pour leur pureté. Ils seront simplement surpassés par des collègues qui apportent la même rigueur intellectuelle, la même curiosité, et de meilleurs outils.

Je dois reconnaître qu’ensemble, ces deux articles sont devenus la chose la plus lue que j’aie jamais écrite (avec ou sans Claude). Des gens lors de conférences sur l’immigration ou dans d’autres domaines, sans parler des administrateurs d’universités à travers le pays, me demandent désormais des conseils sur l’IA plutôt que des analyses sur l’immigration ou la science politique. Cela dit quelque chose sur le sérieux avec lequel nous prenons les choses dans ce domaine, et aussi que je devrais commencer à facturer davantage pour mes conférences et consultations. ↩

Je ne cherche pas à cibler l’ISA de manière injuste. Les organisateurs travaillaient sous de réelles contraintes, il y avait de nombreux excellents panels et des chercheurs sérieux à la conférence, et j’ai écrit ailleurs sur des façons concrètes d’améliorer les conférences académiques. ↩

C’est probablement l’affirmation qui a suscité le plus de résistance de la part des premiers lecteurs de cet article. Certains soutiennent que mon usage de “slop” étire trop le concept — que le slop de l’IA (surproduit, poli mais vide) et les mauvais travaux académiques (négligents, sous-produits) sont des modes d’échec différents. Je suis d’ordinaire opposé à l’étirement conceptuel dans l’écriture scientifique, mais je ne crois genuinement pas que ce soit le cas ici. Ce que j’ai vu à l’ISA était du travail surproduit, dénué de sens, qui avait l’apparence de la science sans rien ajouter à la connaissance humaine. C’est du “slop” par n’importe quelle définition. ↩

Je peux attester que de nombreuses citations de mes propres travaux ont été des réinterprétations créatives de ce que j’ai réellement trouvé : résultats simplifiés, conclusions inversées, ce qui indique presque certainement que ceux qui m’ont cité n’ont pas lu mes travaux. ↩

“Perroquet stochastique” vient d’un article de 2021 co-écrit par la linguiste Emily Bender, qui soutient que les grands modèles de langage produisent du texte en prédisant des séquences de mots probables sans comprendre. ↩

Dean W. Ball va encore plus loin et soutient qu’une grande partie du déni de gauche sur l’IA repose sur une vision du monde où l’industrie technologique est composée de “crétins superficiels” dont les accomplissements sont toujours de façade, toujours fondés sur quelque grand vol. Cette heuristique a peut-être fonctionné pour la crypto. Elle ne fonctionne pas pour des outils que des millions de chercheurs et d’écrivains utilisent discrètement pour faire un meilleur travail. ↩

Je dis “utilisés activement” parce qu’il existe des preuves réelles qu’une dépendance passive et acritique à l’IA peut dégrader les capacités de pensée critique, en particulier pour les tâches routinières. C’est une préoccupation légitime, et c’est pourquoi je soutiens ci-dessous que la salle de cours est l’endroit où les étudiants doivent construire les bases avant de les externaliser. ↩

Comme Hollis Robbins le soutenait il y a un an, les seuls universitaires qui conserveront de la valeur à l’ère de l’IA sont ceux qui travaillent aux frontières de la connaissance. Plus le temps passe, moins cet argument semble outré. ↩

Vous devriez jeter un œil à the Bayesian Hitman. De quoi bousculer vos a priori, c’est certain. ↩

Comme Alison Gopnik et ses collègues l’ont récemment soutenu dans Science, les LLM sont mieux compris comme des technologies culturelles — à l’instar de l’écriture, de l’imprimerie et des bibliothèques — c’est-à-dire des outils qui permettent de nouvelles formes de production de connaissances, même s’ils ne “pensent” pas eux-mêmes. ↩

L’exception qui confirme la règle : Aniket Panjwani et Scott Cunningham, qui ont passé des mois à publier des témoignages de première main détaillés sur ce que ça ressemble concrètement de faire de la recherche avec Claude Code. Pour ma part, ce genre de comptes rendus m’a été genuinement utile et déterminant pour mener à bien ma série sur l’IA. ↩

Il y a ici une inquiétude légitime : les doctorants qui cherchent à apprendre les bases sont désormais en concurrence pour l’espace éditorial avec des professeurs qui disposent de légions d’agents IA. C’est réel, et c’est pourquoi la réponse pédagogique n’est pas “interdire l’IA pour toujours.” La réponse, c’est l’échafaudage — apprendre à penser sans l’outil d’abord, puis l’utiliser avec discernement. ↩

Je remercie tout particulièrement Steven Adler, Ryan Briggs, Tina Marsh Dalton, Josh Gellers, Jimmy Alfonso Licon, Igor Logvinenko, Ilia Murtazashvili, Kyle Saunders, Dina Pisareva, Quinn Que ❁, Ben Radford, Mike Riggs, Hollis Robbins, Jim Walsh, Sean Westwood, Yiqing Xu et Emma Zhang pour leurs suggestions et leurs objections utiles. ↩