ぜひいいね・シェア・コメント・購読をお願いします。費用をかけずにニュースレターの成長を支援できます。ご愛読ありがとうございます。

第一部では、AIはすでにほとんどの教授より優れた社会科学研究ができると主張した。第二部では、千件を超える反応に向き合い、批判者が正しい点は認めつつも、主たる主張は堅持した——学術界の現状はすでに壊れており、AIはその清算を迫っているに過ぎない、と。1 この第三部は、この一ヶ月間AIと同僚たちと共同で執筆したものであり、診断から、研究者が実際にできることとできないことへと議論を進める。

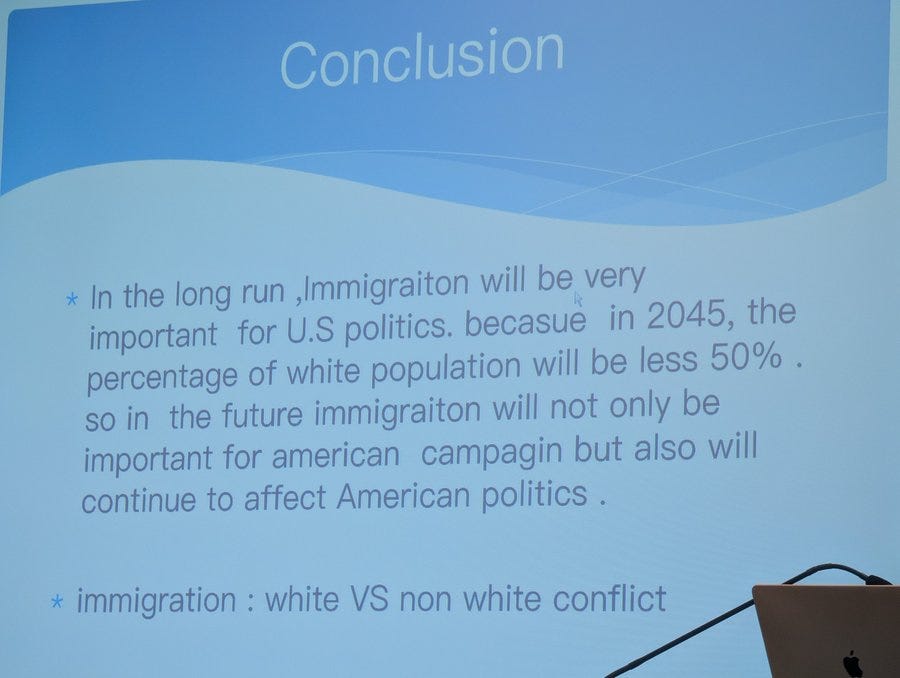

この第三稿を書くことになったきっかけは、コロンバス(オハイオ州)で開催された2026年国際研究協会(ISA)年次大会への参加という、いかにも意外なものだった——世界有数の国際研究者が集う権威ある学際的カンファレンス、とのことだった。だが実際に目にしたものは、自分の授業でもCをつけるのがやっとのような発表ばかりだった。論旨も一貫性もなく、スペルチェッカーが一発で拾えるような文法ミスがあり、発表者は自分の拙い論点に初めて向き合うかのようにスライドを読み上げていた。タイポや不整合が随所にあったことからすると、AIは関与していないようだった。登壇者は大学院生ではなく、博士号取得者、終身在職権保持者、研究予算を持つ人々だった。

AIスラップが誰もが警告する危機であるなら、ISAや他の大規模社会科学カンファレンスで目にしたものを何と呼べばよいのだろうか。2 対比は無視しようがなかった。私がオンラインでAIは多くの教授より優れた研究ができると示唆したとして死の脅迫と解雇要求を受けていたまさにその瞬間に、こうした発表を聞いていたのだ。その並置が、この論考の核心を結晶化した。

21. 「スラップ」の大半は、今も昔も人間によるスラップだ。

最初の主張は最も挑発的なものだったが、それ以来わずかに修正しただけだ。エージェンティックAIはすでに、世界中のほとんどの教授より優れた社会科学研究タスクの大半をこなせる。今もそれを支持する。クロニクルとの最近のインタビューでは、より直截にこう書かれた。「AIはあなたより優れた研究者だ」。まだ信じられないなら、数年後にまた話し合おう。

だが裏面も同様に重要だ。AIが教授より優れた研究成果を出せるなら、それはAIなしで教授たちが生産してきた——そして今も生産し続けている——成果への批判でもある。

「スラップ」はメリアム=ウェブスターの2025年の言葉として、AIが生成する低品質のデジタルコンテンツと定義された。しかしISAのカンファレンスは、スラップの大半が常に人間によるものだったことを思い出させてくれた。人文・社会科学の多くにおいて、学術誌システムと大規模カンファレンスは、誰もがChatGPTを使い始めるずっと前から、スラップの製造工場だった。つまり、ほとんどの研究はスラップだと本当に言いたい。3

一部は哲学者ハリー・フランクファートが「ブルシット」と呼ぶものでもある——移民研究のように政治的に荷電したトピックで左派的な結論から出発して逆算するなど、主張の真偽を問わない仕事だ。だがスラップはブルシットより広い概念だ。何も主張しない仕事、職人的な価値を持つはずなのに失敗している仕事も含まれる。問いを持たないまま先にデータセットを見つけ、有意な結果を掘り出して発表しようとする研究者もスラップを生産している。こうした研究者はAI以前から存在していた。ただ遅かっただけだ。

22. 研究者はAI以前からハルシネーションを起こし、不正を行っていた。

AIに関して人々が提起するハルシネーションや不正への懸念は、数十年、場合によっては数世紀前から存在する問題を指している。今月Natureに掲載された大規模な新プロジェクト(私も小さく関わった)は、数百本の社会科学論文を検証した。統計的に有意な主張の約半数しか再現されず、効果量の中央値は劇的に縮小していた。これは、心理学だけを対象に研究結果の約三分の二が再現できなかったという2015年のオープン・サイエンス・コラボレーション研究の知見を確認し、それを他分野にまで拡張している。

AI以前は、これらを「ハルシネーション」とは呼んでいなかった。「科学」と呼んでいた。考えてみれば、ハルシネーションとインスピレーションは聞こえるほど違わない。どちらもインプットを超えた組み合わせを生成する。結果が間違いならハルシネーション、正しければブレイクスルーと呼ぶだけだ。

一方、研究者は日常的にアブストラクトしか読んでいない論文を引用している。4 少なくともAIのハルシネーション率は追跡され、改善されている。学術界における人間のハルシネーション率はまったく追跡されていない。「文献への貢献」と呼ぶだけだ。そして査読者なら、自分でハルシネーションを起こす必要もない。「私を引用してください」と書けばそれで済む。

優れた研究は確かに存在する。だがAI支援による不正を心配する前に、人間による不正と向き合う必要がある。ディーデリク・スタペル、マーク・ハウザー、フランチェスカ・ジーノ、ダン・アリエリー——高名な不正事件のリストは増え続けているが、これは発覚した人々に過ぎない。露骨な捏造のほか、p-ハッキング、HARKing(結果が出た後の仮説設定)、選択的報告は、かつては不正行為とほとんど見なされないほど広まっていた。こうした慣行の理解は進んだが、何が出版されるかを左右するほどには依然として蔓延している。さらに、シニア教授が大学院生の主導で書かれた論文に名を連ねること、著名な学者の名の下に研究助手チームがまとめた書籍が出版されること——AIがプロセスを安価かつ明白にするまで、これらは不正とは見なされていなかった。

23. 「確率的オウム(stochastic parrot)」のメタファーは、AIより人間をよく描写している。

AI議論で最も影響力のあるスローガンの一つ5は、常に思考停止を促す決まり文句として機能してきた。Cate Hallが指摘したように、これは強力な造語だ——口にして楽しく、概念的に効率的で、今日のモデルには当てはまらないにもかかわらず多くの人々の思考に永続的に定着している。言語芸術の傑作とも言える。また実証的にも誤りだ——GPT-4以降の主要フロンティアモデルはすべて非テキスト入力でも訓練されており、元の論文自体のロジックはテキストのみの訓練を前提としている。

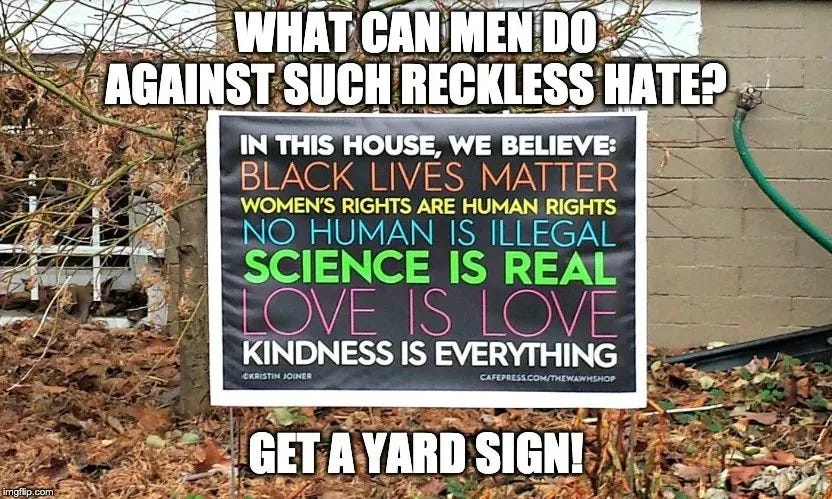

まったく別だが非常に見覚えのあるものを考えてみよう。「In This House We Believe(この家は信じる)」という庭の看板だ。「科学は本物。愛は愛。人間は違法でない」などと書かれている。一行一行を信じていても、これらのどの問題にも首尾一貫した政策的立場は持てない。「人間は違法でない」は執行政策として何を意味するのか——開放国境か、恩赦か、それとも別の何かか?看板は言わない。言えば矛盾に向き合わなければならないからだ。論拠ではなく、忠誠の誓いだ。

だが深い点は、これがまさにAIが批判されていることそのものだということだ。意味ではなく帰属意識を伝える、表面的で気持ちよいだけの言葉を生成する、と。実際には人間が、庭に看板を立てられるようになって以来ずっとそれをやってきた。

庭の看板は例外ではない。ほとんどの人がほとんどの問題にどう向き合うかを示している——自分のグループの立場を採用し、繰り返し、先に進む。主張の中身は枠組みよりはるかに重要だが、枠組みの方が簡単だ。だからそれが公論を支配する——Xのスレッドからカンファレンス発表まで。

ISAでも直接目にした。終身在職権を持つ同僚たちが、学術界版の庭の看板に相当するような研究を発表していた——科学らしさを装うための誤った回帰分析付きで。確率的オウムの批判はAIを貶めるためのものだったが、結果的に誰も意図しなかったほど人間の知的生活の的確な描写になってしまった。

24. 成人がAIを執筆に使うことは問題ない。取り締まりはうまくいかない。

第二部では、AI検出器はしばしばあまり役に立たず、解決するより多くの問題を生むと指摘した。だが根本的な問題は、その背後にある衝動だ——AIの関与は何を生み出すかに関わらず本質的に汚染するという信念。Quinn Queは、AI執筆検出器への執着を「一滴原則」——19世紀アメリカの人種分類において、AIの関与が一滴でもあれば質や著者の意図に関わらず作品全体を汚染するという原則——に類似していると示している。

最初は類推に懐疑的だったが、かなり的を射ている。反AI活動家の見立てでは、自分で書いていない言葉はすべて道徳的汚染だ。AIを執筆に使うことは技術的に「違法」ではないが、あなたが正当な書き手か詐欺師か、善人か悪人かを決める一滴原則が実質的に機能している。だから「思考を機械に外注する」AI利用を開示した私のような人々への非難や死の脅迫が生まれる。

第一部で論じたように、AI反対の多くは原則に見せかけた地位保護だ。Andy Masleyはさらに踏み込み、チャットボットのモラルパニックには地位プロジェクト以上の源泉があると主張する。それは迷信(「チャットボットは悪魔だ」)に近いもの——書けるAIには、何を書くかに関わらず何か間違ったもの、邪悪なものがあるという感覚だ。6

Megan McArdleでさえ、AI利用を誠実に開示してジャーナリストの間で数ヶ月前に学者の間で交わされていた議論と同じ会話を引き起こしたとき、「AIは原稿に触れていない」と主張して自己防衛せざるを得なかった。声を上げた点は称えたい。だが原稿の問題がなぜ争点になるのか?仕事が優れており、プロセスが開示されていれば、残りは倫理に見せかけた美的好みに過ぎない。不純さはどこから始まるのか?Google検索?オートコレクト?スペルチェック?文字起こし?

それらをすべて脇に置いても——AIによる破滅的シナリオの後に人類が技術を禁止するというデューン的事態でもない限り——AIを活用した大量のノンフィクション執筆は、既存のインセンティブ構造からして平衡状態においてほぼ必然だ。付言すれば、「AIの汚染」なしに自分だけで本当に優れた文章を書いたとしても、その純粋さがすぐに報われるわけでもない。

25. 研究と執筆において最新のAIツールを使わないことは、職務怠慢だ。

Matthew Yglesiasは最近、大規模言語モデルはジャーナリズムで十分に活用されていないと主張した。この指摘は研究者にも当てはまる——研究の目的は有用な成果物であり、人間が媒介するプロセスではない。厳密さは思考と検証にあるべきであって、人間と機械のどちらが文章を入力したか、あるいはRで回帰を実行する際にエンターを押したかではない。Hollis Robbinsが言うように、教授は朝食前にAIモデルをテストするべきだろう(基本的にはScott Cunninghamのように)。

AIの最も地味な用途はエラーの検出だ。2026年4月3日付のニューヨーク・タイムズの見出し「北アメリカ条約機構——アメリカなしで?」を考えてほしい。正しくはもちろん北大西洋条約機構だ。タイムズは翌日訂正を出した。AIが原因だと推測する声もあったが、真相は不明だし、率直に言えばどうでもいい。十分に賢いLLMのワークフローなら数秒でミスを発見できた。「このコンテンツに誤りはあるか?二つの独立したソースで確認せよ」という見出し用の自動ルーティンがあれば、タイムズはニュースサイクル一本分の恥を免れていた。

だがファクトチェックは床であって天井ではない。より興味深い用途は、以前は不可能だったことをすることだ。今や共著者となったKelsey Piperは最近、Codexに、査読していた政治学論文を本当に理解するためのインタラクティブなウェブサイトを作ってもらい、その後研究の参加者が行ったのと同じ方法でタスクをこなした。AIは成果物を生産する時間を縮めるだけでない。ほとんどの研究者が省略する積極的な関与のコストも下げる——自分でものを作ること、論拠を試すこと、参加者と同じようにデータを再実行すること。それが深い理解には必要なことだ。

学術界にも同じことが言える。コロンバスでのISA発表の半数は、ChatGPTを一周させるだけで意味のある改善ができた——文法のチェック、論拠の引き締め、論理的欠落の指摘。これらのツールは無料か無料に近い。使わない選択は、自分が出せる水準を下回る仕事を届ける選択だ。特に公共を啓発することを使命とするなら。ただしジャーナリストも研究者も、見出しのタイポを修正するためだけにAIを使うべきではない。インタラクティブな可視化を作り、論拠をストレステストし、執筆対象の複雑な事柄を真に理解するために使うべきだ。

では執筆そのものはどうか?「記事ではなく、それを生み出したプロンプトを読めばいいのでは?」という反応をよく目にする。もっともそうに聞こえる?いや、少し考えれば違う。

食材リストの代わりに食事を食べるのはなぜか?ggplotスクリプトの代わりにグラフを見るのはなぜか?著者のメモではなく本を読むのはなぜか?プロンプトには新しい知識はない。成果物にある。それが要点だ。第二部で論じたように、異なる専門知識・データ・文脈を持つ人々(それぞれのclaude.mdファイルに現れるように)は、同じプロンプトから全く異なる成果物を生み出す。スキルの問題だ。

分かる——著者が生産するのにかけた時間より長く読むことに違和感を覚えることもある。でも以前も同じ状況はあった。Rで数秒で生成されたグラフを注意深く読むのには数分かかる。誰もグラフの代わりにコードだけを見せろとは要求しない。グラフを評価し、それが何を言っているか——以前は存在しなかった新しい知識——を評価する。

26. LLMは実際に新しい知識を生み出せるかもしれない。

John Burn-Murdochが最近記録したように、AIチャットボットはソーシャルメディアとは逆に、ユーザーを専門家のコンセンサスに向けて引き寄せた。ツールは執筆を助けるだけでない。積極的に使えば、より注意深い思考を助ける。7 こうして、LLMはポピュリズムの台頭を逆転させるかもしれない。ただしファクトチェックは新しい知識を生産することとは同じではない。

LLMが本当に新しいアイデアを生み出せるかを問う前に(その好例はある)、人間のどれだけがそれをしているかを問うべきだ。ほとんどの研究者はキャリアを通じて既存のアイデアをわずかに変えて再組み合わせ、同じ手法をわずかに異なるデータセットに適用し、サブ分野の外では誰も読まない漸進的な成果を生み出す。独創的な思考はどの世代でも非常に困難で稀だ。同僚(や自分自身)への侮辱として言うのではない。ただ、LLMが超えなければならない基準は、認めたがる水準より低い。8

友人のRobert Kubinec——サウスカロライナ大学の優秀な政治方法論者で出版された小説家9——はAIを巡る誇大宣伝の多くに懐疑的なようだ。「LLMは知識を生み出さない。知識は人間の脳にのみ存在する。異なる知識の集合を比較することしかできない」と主張する。Bobを尊重するので意見が違ってもいい。私の応答:自己意識に関する哲学的問いは本物だが、実践的問いとは直交している。モデルが何かを「理解」しているかどうかに関わらず、その成果物に人間にとって有用な新情報が含まれているかどうかが問題だ。10

最も示唆に富む最近の例は、Anthropicの新しいフロンティアモデルClaude Mythosだ。数週間のテストで、主要なOSやブラウザにわたって数千件の未知のセキュリティ脆弱性を特定し、その中には27年間発見されていなかったものも含まれていた。それを何と呼ぼうとも、「知識の集合を比較する」だけでは説明しきれない。

社会科学における最良の概念理論はすでに既存のアイデアの再組み合わせだ。Anthony Downsは微経済学の効用最大化を選挙に移植して合理的選択論を構築し、著書にAn Economic Theory of Democracyという文字通りの名前をつけた。BaumgartnerとJonesは進化生物学から断続的均衡を借用して政策形成に適用した。社会ネットワーク分析は数学からグラフ理論を丸ごと輸入した。Axelrodは囚人のジレンマと進化的適応度選択を融合させた。Alexander Wendtはさらに進んで量子論を国際関係に適用した——多くの人が(当然にも)馬鹿げていると感じたが、Cambridge University Pressは出版した。社会科学は一から発明することは稀で、領域を超えて翻訳し、その翻訳が理論的貢献となる。

それはLLMがしていることと構造的に同一だ——文脈を超えてパターンや概念を再組み合わせる。結果がナンセンスになることもある。生産的なこともある。人間の再組み合わせも同じだ。WendtのQuantum IRは物理学を装った単なる比喩だと批判されているが、Cambridge University Pressが出版した。それが知識生産に数えられるなら、LLMが生成する再組み合わせが数えられない理由は見えない。

Bobは哲学的立場を保ちつつも実践的な点は認めた——「この能力を知識の前進に活かす方法が問題だ」と。まさに。第一部で言ったように、LLMが「本当に理解しているか」を議論するのをやめ、最も重要な立場の人々がすでにツールを使ってより良い仕事をしているうちに。

27. 批判者のAIユーザー像は2023年のまま止まっており、それは大昔の話だ。

こうなった経緯を思い出してほしい。学生は教授より先にAIに熱中し、ChatGPT 3.5のような最初の公開無料モデルを使い始めた。その結果、多くの教授や知識人は典型的なAIユーザーを、エッセイでずるをしようとする学部生や、AIスラップを提出してしまった助手のように想像したままだ。世界中の気軽なAI利用の多くはまだそれかもしれない。しかし、ほとんどの分野でトップの研究者がこれらのツールをどのように使っているか、あるいは責任感を持ってAIを使おうとしている人が実際にどう操作しているかとは一致しない。

Stefan Schubertがこれを最もうまく掴んでいる——他者の合理性を過小評価し、新しいツールを実際よりずっと無思慮に適用すると決め込んでいる。ChatGPTに論文を丸ごと書かせることと、すべての言葉を自分で書くことの間には、広大な空間がある。「自分で」書くとき、すでにショートカットを使っている。あらゆる引用を深く調査してはいない。統計をGoogleで調べて見出しの数字を信じ、アブストラクトをざっと読んで論文を引用する。リソースがあれば、確認を研究助手やファクトチェッカーに外注する。AIはこうしたことの多くをより体系的・自動的・安価にできる。

多くの人と同様に、Derek Thompsonは執筆とは思考であり、執筆の全プロセスをAIに外注すれば思考が空洞化すると正当に信じている。だが、多くの執筆は思考である一方、思考は執筆だけではない。芸術制作も思考だ。会話も思考だ。Dina Pisarevаが論じるように、優れたソクラテス的対話相手がいれば、プロンプトも思考だ。

Thompsonも認めているように、すべての執筆は常に、アイデア・事実・編集・ファクトチェックを書き手の頭の外に求めることを伴ってきた。正当な支援と不当な外注の境界線はずっと曖昧であり、AIがその曖昧さを生み出したわけではない。無視できなくしただけだ。Thompsonの結論:「Claude画面を開いているすべての人をスラップ階級と断言するのではなく、曖昧さについて率直に話し合うべきだ」。

開示はどこへ向かうか?多くの良識ある人々やトップ学術誌は完全なAI利用開示を解決策として提案する。しかし開示はゲーム理論的に持続不可能だ——開示者は評判コストを負う一方、非開示者がフリーライドするため、均衡は非開示に向かう。Megan McArdleと私はその問題の生きた証明だ。Ryan Briggsが示すように、より適切なフレームは、AIが専門知識を補完するというものだ——あなたの仕事を確認する自動化されたRA、論拠を形式化するパートナー、オンデマンドでデータを収集するツール。有能な人がより速くより良く考えるための乗数だ。

開示が本当に義務とされる唯一のケースは、聴衆が完全に人間の手による作品を期待しており、その期待が彼らが対価を支払うものの一部である場合だと思う。最良の類推は、個人的または創造的な執筆の狭い文脈でのライブコンサートだ——ライブパフォーマンスを期待して来た観客が口パクを聞かされれば、正当な不満だ。より正確には、非開示が聴衆を自分が受け取るものについて誤解させるとき、開示が義務となる。バイラインで出版するジャーナリストは説明責任と独創性を約束しているのであり、打鍵の起源を約束しているわけではない。回顧録作家はその両方を約束している。基準は著者が名前を冠するものにあり、ツールが使われたかどうかにはない。

科学とジャーナリズムはライブショーではない。新しい知識を発見し共有することについてだ。誰もスペルチェック、研究助手、Google検索の使用を開示しない。クリエイティブライティングと芸術の規範は異なるだろう——聴衆はそこに人間が物を作る経験の一部として対価を払っているから、それは当然だ。人文学はおそらく長く論争的なプロセスを経てその中間のどこかに落ち着き、多くの友情が壊れるだろう。だが研究とジャーナリズムにとって、「すべてを開示せよ」は目指す方向へ連れて行ってくれない。読者が気にすべきは正確さと、著者がページ上にあることに全責任を持つかどうかだ。起源はその両方より遥かに弱いシグナルだ。

28. 誰も何も知らない——自分も含めて。それでいい。一緒に解決していこう。

AIについてジャーナリストと話すことを最初は避けていた——意味のある意味での専門家ではないから。しかし誰もこれが一体何なのかについての専門家ではないのだと、次第に気づき始めている。そして専門家が現れるのを待っていれば、規範がまったく生まれない。いまだに Claude Code(またはお好みのエージェンティックツール)をインストールして、手元の問題を解決するために対話する以上のアドバイスは避けている。

いつものように、Arthur Spirlingはこの点で率直だった——モデルを開発している研究室にいるかのように同僚や博士課程の学生に「アドバイス」を絶えず提供するAI学術アカウントは退屈だ。彼らは私たちと同じ観客だ。11 研究室の中の人でさえ、数ヶ月先のモデルの精度については分からない。

だからこそ奇妙な立場にある。誰かが新しいワークフロー環境の規範を確立し始めなければならない、しかしそれをする人々は必然的に自分が規範を作っている対象を十分理解していない人々だ。奇妙で不快だ。他のほとんどの制度的移行もおそらくそのように機能してきたが、はるかに遅いペースで。

以前のバージョンをこれは大昔のように感じるが、教授が学生のAI利用を完全かつ細密に取り締まることは生産的でも可能でもないと認めなければならなかったときのことを通った。今は研究者に同じことが当てはまる。実際に重要な部分、例えば再現コードを監査できるし、LLMはすでにそれを容易にしている。起源は監査できない唯一のものであり、そもそもエネルギーを使うべきではない。インセンティブに従い、ツールが使われていないふりをするのでなく、ツールが適切に使われることを確保するシステムを構築する必要がある。

教育について、私は休暇中だったのでここでもアドバイスを控えてきた。多くの質問を受けたが、研究より教育へのAIの影響については悲観的だ。例えば、研究と執筆ではAIを公然と広範に使っているが、実質的な授業ではすべての電子機器を禁止し、筆記と口頭の対面試験に戻すつもりだ。

これらは矛盾した立場ではない。教室こそ、後でAIとの協働を生産的にする認知スキルを学生が構築する場所だ。AIツールを無しで考えることを学ばなければ、ツールを意味ある形で指示することはできない。第二部のスキル萎縮の懸念がここで最も妥当する——学生は基礎を内面化してから外注する必要がある。研究は手元の最良のツールを展開して価値ある成果を生む場所だ。教育は次世代がそれらのツールを本当に使いこなせるようにする場所だ。12

29. 最良の仕事は人間とAIが協働するときに生まれる。

執筆にAIを使わないと誓っている人々をまだ多く見る。これは研究助手や共著者の助けを受けないと誓うのと同じくらい合理的だ。だから逆の誓いをしよう——最新のLLM、そしてその他の利用可能なツールや人間の共著者を活用して、自分の研究やそのコミュニケーション方法を最大限に向上させる。そうすることで、私の名前が付いていれば、それが自分の最良の判断を反映していると確信できる。

多くの研究者、特に人文学者は、仕事にどれだけの時間をかけたかが重要だと信じているようだ。しかし労働価値説は経済学で誤りであり、ここでも誤りだ。行列を手で逆行列にしながら手動でロバストネスチェックを行ったり、原稿を手動で翻訳・転記したりすることに数年費やす変わり者なら、それは本人の選択だ。ISAの国際研究の教授たちが人間スラップの発表に10時間かけたか100時間かけたかは、あまり気にしない。仕事が良いか悪いかだ。

とはいえ、確立する価値のある規範もある。「私は信じる」「私は感じる」と書くとき、その一人称は本当の自分のものであるべきだ。代名詞「私」は背後に人間の声があるという暗黙の約束を持つ。NATOの正式名称のような事実的主張は、誰が入力したかを気にしない。しかし個人的な確信は別だ。ライブコンサートを考えてほしい——観客はリアルなパフォーマンスに対価を支払い、口パクではない。「私」を使うとき、読者はあなたがそれを意図していると期待する権利がある。それは文字通りすべての言葉を自分でタイプ(または口述)することを要求しない。モデルを指示し、メモを基に作業し、注意深く読み返すことはできる。しかし確信があなたのものでなければならない。

本稿は、私の独自のアイデア、同僚との会話、そして人間の学術的・非学術的同僚の有益な提案を基に、Claude Codeとの反復的な対話を通じて公然と誇りを持って執筆された。13 第一部はAIの能力を人間の編集なしで実験した。第二部は100%人間の声で振り返った。今読んでいる第三部は、私の声とAIの能力を組み合わせ、円を完成させる。どれが最もよかったか、判断はお任せする。

では人間はどこで優位を保つのか?Yiqing Xuが論じるように、おそらく訓練データがまだ存在しないオープンエンドの環境と、直接的な人間の相互作用を必要とするタスクにおいて。これはすぐに変わるかもしれない。しかし私たちがこのキャリアを選んだのは、物事を解明することに意味を見出すからであり、単にまだ優れているからではない。だからこそ、雑務の大半をAI(または伝統的な価値観を持つなら研究助手)に外注し、最も意義を与えてくれること——世界について重要な問いを生み出し、利用可能な最良のツールで答えること——に集中することに、矛盾は見当たらない。

30. 科学における真のリスクはAIスピードの人間スラップだ。まだ防げる。

AIはあなたが持ち込むものを増幅する。本物の好奇心と難しい問いを持ち込めば、AIは読む価値のあるものを作る助けになる。何も持ち込まなければ、何もより速く生産するだけだ。

しかし楽観の余地はある。同じNatureの知見は、再現性がどれほど壊れているかを示すとともに、データとコードの共有を義務付けている誌の再現率が有意に高いことも示した。AIはすでにこれを加速できる——査読誌の編集者が自動再現チェックと必須コード検証を投稿条件として設けることを妨げるのは慣性だけだ。これらのシステムはほぼ決定論的に構築でき、エラーの余地はほとんどなく、著者は社内のエージェンティックワークフローがコードの再現方法を判断できなかった場合には自動デスクリジェクションに異議を申し立てることができる。

より野心的には、AIは以前は30人の研究助手と全行政データセットへのアクセスを持つRaj Chettyか、鉛筆と紙のDaron Acemogluでなければ不可能だった大規模でデータ集約的な仕事のコストを下げる。Codexを持つジュニア研究者は、5年前には実施が不可能だったプロジェクトに挑戦できる。出版されるものの基準が上がるべきだ——生産できるものの基準はすでに上がっているのだから。

標準は変わっていない——何かに名前を冠するなら、それを支持する。プロセスでなく成果の質を評価せよ。AIスラップについての議論は、より困難な問いからの気晴らしだ。チャットボットが登場するずっと前に問われるべきだった問い——なぜ私たちはこれほど多くの人間スラップを許容してきたのか?

***

第一部を投稿したときの目的はシンプルだった——すでに水面下とDMで起きていた会話を表に出すこと。それでも同僚から同じことを聞き続ける。「アレックス、あなたがAIを使うのは分かる、私たちも使っている、でも黙っていられないのか?」

AIが無責任に使われ、防ぐより多くのスラップを生むのではという恐れは理解できる。しかし「黙っていろ」は、普遍的な偽善を職業規範として提唱しているに過ぎない。自分のワークフローと将来についての不確実性をより安定した均衡に向けることが目的の一つだった。それには沈黙ではなく、誠実な会話が必要だ。

すでに変化は起きている。Emily Osterは最近、経済学MIT博士課程学生向けのAIに関するIsaiah Andrewsのアドバイスをシェアし、すべての博士課程コホートに回すべきものと評した。Andy Hallが指摘したように、最も重要なのは特定のアドバイスではなく、影響力のある教員が明確なシグナルを送ること——これは真剣に取り組む必要があると。ジャーナリズムで最も思慮深い人物の一人であるDylan Matthewsでさえ、AI側が多くの点で正しかったと最近認めた。

変化は本物だ。研究者はすでに半覚醒しており、後戻りはしない。志望する大学院生とジュニア研究者は慎重に歩みつつも、AIツールについて学び完全に活用することを受け入れるべきだ。関与を拒む学者・知識人・作家は、その純粋さを報われることはない。同じ知的厳密さと好奇心、そしてより良いツールを持つ同僚にただ凌駕されるだけだ。

合わせてその二つの投稿が私がこれまで書いた中で最も広く読まれたもの(クロードあり・なし問わず)になったことを認めるべきだろう。移民や他のカンファレンスに来た人々、そして全国の大学管理者が、移民や政治学について聞かずにAIのアドバイスを求めてくるようになった。これはこの分野でどれだけ真剣に物事を受け取るかについて何かを言っており、また講演やコンサルティングの料金を上げるべきだということも示している。 ↩

ISAを不当に名指しするつもりはない。主催者は現実の制約の下で働いており、カンファレンスには素晴らしいパネルと真剣な研究者が多くいた。また、学術カンファレンスをより良くする具体的な方法については別に書いた。 ↩

この主張が早期読者から最も反論を受けた。「スラップ」の概念を広げすぎているという主張もある——AIスラップ(過剰生産、磨かれているが中身が空)と悪い学術的仕事(不注意、過少生産)は異なる失敗のモードだ、と。科学的文章での概念の引き伸ばしは通常嫌うが、ここではそれが起きているとは本当に思わない。ISAで目にしたのは、過剰生産された、科学的に見えても人類の知識に何も加えない無意味な仕事だった。それはどの定義でも「スラップ」だ。 ↩

自分の研究への多くの引用が、実際に見つけたことの創造的な再解釈であることを証言できる——知見が単純化され、結論が逆転されており、ほぼ確実に引用者が私の研究を読んでいないことを示している。 ↩

「確率的オウム(stochastic parrot)」は、大規模言語モデルが理解なしに確率的な語の連続を予測することでテキストを生成するという言語学者Emily Benderらの2021年の論文から来ている。 ↩

Dean W. Ballはさらに踏み込み、左派のAI否定の多くは、テック産業が「薄っぺらな馬鹿者」で構成されており、その成果は常に表面的で何らかの大きな窃盗に基づいているという世界観に根ざしていると主張する。このヒューリスティックはクリプトには機能したかもしれない。何百万人もの研究者や作家が静かにより良い仕事をするために使っているツールには機能しない。 ↩

「積極的に使えば」と言うのは、AIへの受動的・無批判な依存が、特に日常的なタスクにおいて批判的思考スキルを低下させるという実際の証拠があるからだ。これは本物の懸念であり、だからこそ以下で教室は学生が基礎を構築する場所だと論じる。 ↩

Hollis Robbinsが一年前に論じたように、AI時代に価値を保つ研究者は知識の最前線で働いている人々だけだ。時間が経つほど、その主張は荒唐無稽に見えなくなる。 ↩

the Bayesian Hitmanをぜひチェックしてほしい。あなたの事前確率を揺さぶるだろう。 ↩

Alison GopnikらがScienceに最近論じたように、LLMは文字・印刷・図書館のような文化的技術として最もよく理解される——自らは「思考」しなくとも、新しい形の知識生産を可能にするツールだ。 ↩

その規則の例外はAniket PanjwaniとScott Cunninghamで、彼らは Claude Codeで研究を行うことが実際にどのようなものかについて、何ヶ月もかけて詳細な一次報告を出版してきた。少なくとも私にとって、そのような記録はAIシリーズを完成させるのに本当に役立つものだった。 ↩

ここには正当な懸念がある——基礎を学ぼうとしている大学院生は今や、AIエージェントの軍団を持つ教授と誌面を争っている。それは本物であり、だからこそ教育の答えは「AIを永遠に禁止」ではない。答えは足場掛け——まずツールなしで考えることを学び、その後判断力を持って使う——だ。 ↩

Steven Adler、Ryan Briggs、Tina Marsh Dalton、Josh Gellers、Jimmy Alfonso Licon、Igor Logvinenko、Ilia Murtazashvili、Kyle Saunders、Dina Pisareva、Quinn Que ❁、Ben Radford、Mike Riggs、Hollis Robbins、Jim Walsh、Sean Westwood、Yiqing Xu、Emma Zhangの有益な示唆と批評に特に感謝する。 ↩