Proszę polub, udostępnij, skomentuj i zasubskrybuj. Pomaga to rozwijać newsletter bez finansowego wkładu z twojej strony. Dziękuję za lekturę.

W Części I argumentowałem, że AI (sztuczna inteligencja) potrafi już prowadzić badania w naukach społecznych lepiej niż większość profesorów. W Części II odniosłem się do ponad tysiąca reakcji, przyznając krytykom rację tam, gdzie mieli ją, i podtrzymując mój główny argument: akademickie status quo było już wcześniej zepsute, a AI jedynie wymusza rozliczenie.1 W tej Części III, napisanej we współpracy z AI i moimi współpracownikami przez ostatni miesiąc, przechodzę od diagnozy do pytania, co naukowcy faktycznie mogą—lub nie mogą—z tym zrobić.

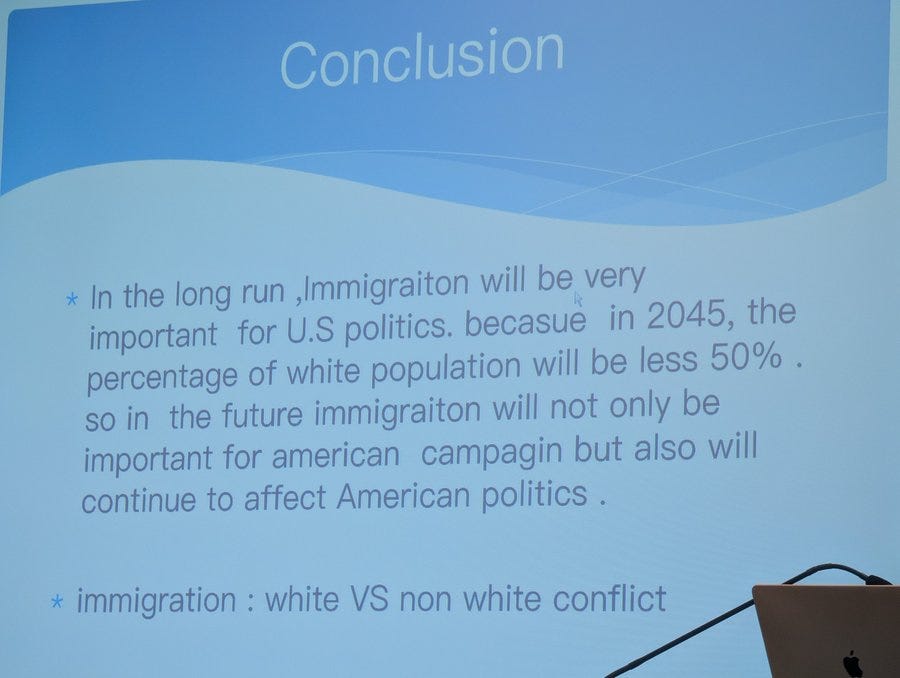

Dość nieoczekiwanym bezpośrednim powodem tego trzeciego odcinka o AI była wizyta na dorocznej konferencji International Studies Association (ISA) 2026 w Columbus w stanie Ohio—prestiżowej, multidyscyplinarnej konferencji czołowych specjalistów w dziedzinie studiów międzynarodowych. Przynajmniej tak mi powiedziano. To, co naprawdę zobaczyłem, to prezentacje tak słabe, że ledwo zasługiwałyby na ocenę dostateczną na moich zajęciach: argumenty bez tezy i spójności, błędy gramatyczne, które wyłapałby każdy program sprawdzający pisownię, prelegenci czytający ze slajdów, jakby napotykali własne słabe argumenty po raz pierwszy. Wszystko to bez żadnego udziału AI, o ile mogłem ocenić po obecności literówek i niespójności. Nie byli to wyłącznie doktoranci, ale osoby z doktoratami, stałymi etatami i budżetami badawczymi.

Jeśli slop generowany przez AI to kryzys, przed którym wszyscy przestrzegają, chciałbym wiedzieć, jak nazwać to, co zobaczyłem na ISA czy na większości innych dużych konferencji nauk społecznych.2 Kontrast był nie do zignorowania: siedziałem na tych prezentacjach dokładnie w momencie, gdy online otrzymywałem groźby śmierci i wezwania do zwolnienia mnie za sugestię, że AI potrafi prowadzić badania lepiej niż większość profesorów. To zestawienie skrystalizowało argument dla tego tekstu.

21. Większość „slopu” zawsze była i nadal jest ludzkim slopem.

Moja pierwsza teza była najbardziej prowokacyjną rzeczą, jaką powiedziałem, i nieznacznie ją zmodyfikowałem od tamtego czasu: agentyczna AI potrafi już wykonywać większość zadań badawczych w naukach społecznych lepiej niż większość profesorów na świecie. Nadal przy niej stoję. W moim niedawnym wywiadzie dla Chronicle ujęto to dosadniej: „AI jest lepszym badaczem niż ty”. Jeśli nadal w to nie wierzysz, porozmawiajmy za kilka lat.

Jednak druga strona tego medalu jest równie ważna. Jeśli AI potrafi wytwarzać lepsze wyniki badań niż profesorowie, stanowi to zarazem wyrok na wyniki, które ci profesorowie wytwarzali i nadal wytwarzają bez AI.

„Slop” był Słowem Roku Merriam-Webster w 2025, zdefiniowanym jako niska jakość treści cyfrowych produkowanych przez AI. Konferencja ISA była jednak przypomnieniem, że zdecydowana większość slopu zawsze była ludzkim slopem. System publikacji akademickich i wielkie konferencje w znacznej części humanistyki i nauk społecznych były fabrykami slopu na długo przed tym, zanim ktokolwiek wykupił subskrypcję ChatGPT. Tak, naprawdę mam na myśli to, że większość badań to slop.3

Część z nich to również to, co filozof Harry Frankfurt nazywałby „bzdurą”: praca obojętna na prawdziwość swoich twierdzeń, szczególnie w kwestiach politycznie nacechowanych—takich jak imigracja—gdzie badacze zaczynają od lewicowych konkluzji i pracują wstecz. Ale slop jest szerszy niż bzdura. Obejmuje też prace, które nie stawiają żadnej tezy, prace mające mieć wartość rzemieślniczą, które po prostu zawodzą. Badacz, który najpierw znajduje zbiór danych, a potem szuka w nim istotnych wyników wartych opublikowania, produkuje slop. Tacy badacze istnieli na długo przed AI. Po prostu pracowali wolniej.

22. Naukowcy haluqynowali i oszukiwali zanim pojawiło się AI.

Obawy dotyczące halucynacji i oszukiwania, które ludzie zgłaszają wobec AI w nauce, opisują problemy wyprzedzające ją o dekady, jeśli nie stulecia. Nowy, zakrojony na szeroką skalę projekt opublikowany w tym miesiącu w Nature (w którym miałem niewielki udział) przetestował setki artykułów z nauk społecznych: tylko około połowa statystycznie istotnych twierdzeń dała się zreplikować, a mediany wielkości efektów drastycznie się skurczyły. Badanie to potwierdza to, co odkryto w projekcie Open Science Collaboration z 2015 roku—przeprowadzonym wyłącznie w psychologii—gdzie około dwie trzecie wyników nie poddało się replikacji, i rozciąga to na wiele dziedzin.

Wcześniej nie nazywaliśmy tego „halucynacjami”. Nazywaliśmy to „nauką”. Jeśli się nad tym zastanowić, halucynacja i natchnienie faktycznie nie są tak różne, jak brzmią. Oba polegają na tworzeniu połączeń wykraczających poza dane wejściowe. Nazywamy to halucynacją, gdy wynik jest błędny, i przełomem, gdy jest trafny.

Tymczasem naukowcy rutynowo cytują artykuły, których nie czytali dalej niż streszczenie.4 Przynajmniej wskaźniki halucynacji AI są śledzone i ulegają poprawie. Ludzkie wskaźniki halucynacji w nauce nie są śledzone wcale. Nazywamy je po prostu „wkładem do literatury”. A jeśli jesteś recenzentem, nie musisz nawet sam halucynować: po prostu piszesz „proszę cytować moje prace” i idziesz dalej.

Część badań jest naprawdę doskonała. Ale zanim zaczniemy się martwić o oszukiwanie przy pomocy AI, rozliczmy się przez chwilę z ludzkim jego rodzajem. Diederik Stapel, Marc Hauser, Francesca Gino, Dan Ariely: lista głośnych przypadków oszustwa stale rośnie, a to tylko osoby, które zostały przyłapane. Poza bezpośrednią fabrykatem, p-hacking, HARKing (hipotezowanie po poznaniu wyników) i selektywne raportowanie były przez lata tak powszechne, że ledwo były traktowane jako uchybienia. Dokonaliśmy realnego postępu w rozumieniu tych praktyk, ale pozostają one na tyle powszechne, że kształtują to, co jest publikowane. Poza tym wszystkim starsi profesorowie zawsze podpisywali artykuły napisane głównie przez doktorantów, a całe książki były składane przez zespoły asystentów badawczych pracujących pod nazwiskiem sławnego uczonego. Nic z tego nie uważano za oszukiwanie—dopóki AI nie uczyniła tego procesu tańszym i bardziej widocznym.

23. Metafora „stochastycznej papugi” lepiej opisuje ludzi niż AI.

Jedno z najbardziej wpływowych haseł w debacie o AI5 zawsze funkcjonowało jako klisza kończąca myślenie. Jak zauważyła Cate Hall w tym wpisie, to potężne sformułowanie: przyjemne w wymowie, konceptualnie efektywne, które na trwałe skolonizowało umysły wielu ludzi—mimo że nie jest prawdziwe w odniesieniu do dzisiejszych modeli. Prawdziwe lingwistyczne dzieło sztuki. Jest też empirycznie fałszywe: każdy czołowy model od GPT-4 był trenowany na danych pozatekstowych, a logika oryginalnego argumentu wymaga, by działał wyłącznie w oparciu o trening na tekście.

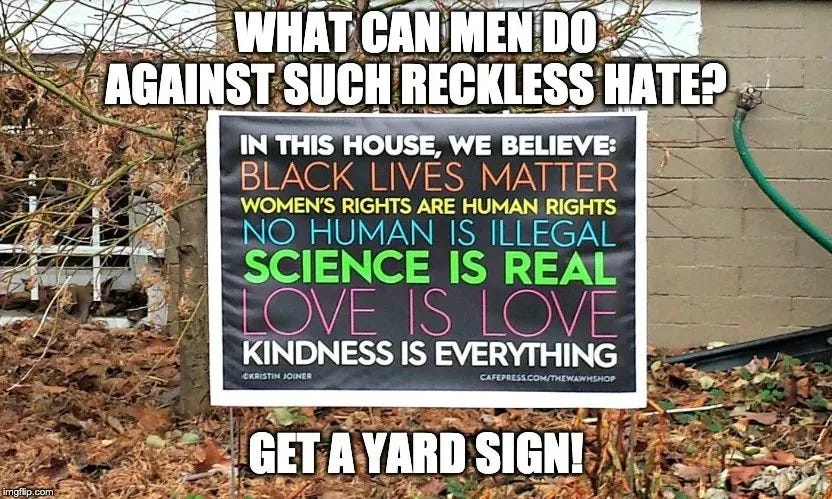

Teraz rozważmy coś zupełnie innego, a jednak wciąż bardzo znajomego: tabliczki na trawnikach „W tym domu wierzymy”. Nauka jest prawdziwa. Miłość jest miłością. Żaden człowiek nie jest nielegalny, itd. Możesz wierzyć w każde zdanie i nadal nie mieć żadnego spójnego stanowiska politycznego w żadnej z tych kwestii. Co „żaden człowiek nie jest nielegalny” oznacza dla polityki egzekwowania prawa: otwarte granice, amnestia, coś innego? Tabliczka tego nie mówi, bo powiedzenie tego wymagałoby zmierzenia się ze sprzecznościami. Jest przysięgą lojalności, nie argumentem.

Ludzie drwili z tej tabliczki od lat.

Głębsza kwestia jest jednak taka, że to jest dokładnie to, za co AI jest krytykowana: produkowanie płytkich, dobrze brzmiących stwierdzeń komunikujących przynależność, a nie sens. Okazuje się, że ludzie robią to z AI lub bez niej od tak dawna, odkąd mamy trawniki, na których można stawiać tabliczki.

Tabliczka na trawniku nie jest wyjątkiem. To jest to, jak większość ludzi wydaje się angażować w większość kwestii: przyjąć pozycję swojej grupy, powtarzać ją, iść dalej. Treść tego, co argumentujesz, ma znacznie większe znaczenie niż to, jak to kadryzujesz, ale kadryzowanie jest łatwiejsze, dlatego dominuje w dyskursie publicznym—od wątków na Twitterze po prezentacje konferencyjne.

Przekonałem się o tym osobiście na ISA, gdzie zatrudnieni na stałe współpracownicy prezentowali prace stanowiące akademicki odpowiednik tabliczki na trawniku—uzupełnionej o kilka błędnie zidentyfikowanych regresji, by nadać całości pozory nauki. Krytyka stochastycznej papugi miała umniejszyć AI. Okazała się jednak lepszym opisem ludzkiego życia intelektualnego, niż ktokolwiek zamierzał.

24. Tak, dorośli za wzajemną zgodą mogą używać AI do pisania. Ściganie tego nie działa.

W Części II zauważyłem, że detektory AI często nie są zbyt użyteczne i stwarzają więcej problemów, niż rozwiązują. Głębszy problem tkwi jednak w impulsu, który za nimi stoi: przekonaniu, że udział AI jest z natury skażający, niezależnie od tego, co wytwarza. Quinn Que przedstawia fascynujący argument, że obsesja na punkcie detektorów pisania AI jest analogiczna do egzekwowania „reguły jednej kropli” — zasady z XIX-wiecznej amerykańskiej klasyfikacji rasowej: jakikolwiek ślad udziału AI skażał całą pracę, niezależnie od jej jakości czy intencji autora.

Początkowo byłem sceptyczny wobec tej analogii, ale jest trafna. W oczach aktywistów anty-AI każde słowo, którego sam nie napisałeś, stanowi moralne skalanie. Choć używanie AI do pisania nie jest technicznie „nielegalne”, obowiązuje tu zasadniczo reguła jednej kropli regulująca, czy jesteś prawowitym pisarzem czy oszustem, dobrą czy złą osobą. Stąd potępienia i groźby śmierci wobec takich osób jak ja, które ujawniają swoje użycie AI za „przekazywanie myślenia maszynie”.

Jak argumentowałem w Części I, znaczna część opozycji wobec AI to ochrona statusu ubrana w zasady. Andy Masley idzie dalej, twierdząc, że moralna panika wokół chatbotów może mieć źródło poza projektem statusu. Tym źródłem jest coś bliższego przesądowi („chatboty są demoniczne”): poczucie, że tekst wytworzony przez AI jest duchowo skażony, że jest coś złego, a nawet diabolicznego w maszynie, która potrafi pisać, niezależnie od tego, co pisze.6

Nawet Megan McArdle, która niedawno honorowo ujawniła swoje użycie AI i wywołała wśród dziennikarzy tę samą debatę, którą naukowcy toczyli na Bluesky kilka miesięcy wcześniej, poczuła się zmuszona bronić się, nalegając, że „AI nie dotknęła żadnego tekstu końcowego”. Podziwiam ją za to, że zabrała głos. Ale dlaczego kwestia „tekstu końcowego” w ogóle powinna być problemem? Jeśli praca jest dobra i proces jest ujawniony, reszta to estetyczna preferencja udająca etykę. Gdzie zaczyna się nieczystość? Google? Autokorekta? Sprawdzanie pisowni? Transkrypcja?

I nawet abstrahując od tego wszystkiego: poza scenariuszem rodem z Dune, gdzie katastrofa AI zostaje pokonana, a ludzkość koordynuje się, by zakazać technologii, powszechne pisanie non-fiction wspomagane AI jest w równowadze niemal nieuniknione, biorąc pod uwagę istniejące bodźce. Warto też wspomnieć, że nawet jeśli uda ci się pisać dobrze całkowicie bez „skażenia AI”, nikt nie będzie cię za tę czystość nagradzał zbyt prędko.

25. Nieużywanie najnowszych narzędzi AI w badaniach i pisaniu to zaniedbanie.

Matthew Yglesias niedawno argumentował, że duże modele językowe są niedostatecznie wykorzystywane w dziennikarstwie. Jego punkt ma zastosowanie do naukowców: celem badań jest użyteczny wynik, a nie pośrednictwo człowieka w procesie. Rygoryzm powinien tkwić w myśleniu i weryfikacji, a nie w tym, czy człowiek czy maszyna wpisała zdania albo nacisnęła enter uruchamiając regresje w R. Jak dobrze ujęła to Hollis Robbins, profesorowie powinni zapewne testować modele AI przed śniadaniem (w zasadzie wzorować się na Scotcie Cunninghamie).

Najprostsze zastosowanie AI to wyłapywanie błędów. Weźmy nagłówek New York Timesa z 3 kwietnia 2026: „A North American Treaty Organization Without America?” Prawidłowa nazwa to oczywiście North Atlantic Treaty Organization. Times opublikował sprostowanie następnego dnia. Niektórzy spekulowali, że błąd był spowodowany przez AI. Nigdy tego nie wiemy, i szczerze, nie ma to znaczenia. Każdy wystarczająco inteligentny proces oparty na LLM wykryłby błąd w ciągu sekund. Prosta automatyczna rutyna dla wszystkich nagłówków—„Czy zawiera jakieś błędy? Zweryfikuj w dwóch niezależnych źródłach”—oszczędziłaby Timesowi cyklu wiadomości pełnego zakłopotania.

Ale weryfikacja faktów to podłoga, nie sufit. Ciekawsze zastosowanie polega na robieniu rzeczy, które wcześniej nie były możliwe. Moja obecna współautorka, Kelsey Piper, niedawno kazała Codexowi zbudować dla niej interaktywną stronę, by naprawdę zrozumieć artykuł z nauk politycznych, który recenzowała, a następnie sama wykonała zadanie tak, jak robili to uczestnicy badania. AI nie tylko kompresuje czas potrzebny do wytworzenia wyniku. Obniża koszt rodzaju aktywnego zaangażowania, który większość badaczy pomija: zbudowania czegoś samemu, przetestowania argumentu pod stresem, ponownego przeprowadzenia analizy tak jak robili to uczestnicy. Na tym właśnie polega głębsze zrozumienie.

To samo dotyczy nauki. Połowa prezentacji na ISA w Columbus, które widziałem, mogłaby zostać znacząco poprawiona przez pobieżne przejście przez ChatGPT: sprawdzenie gramatyki, zaostrzenie argumentów, wychwycenie luk logicznych. Te narzędzia są darmowe lub prawie darmowe. Decyzja o nieużywaniu ich to wybór dostarczenia gorszej pracy niż stać cię na, zwłaszcza gdy twoim powołaniem jest informowanie opinii publicznej. Ale dziennikarze i naukowcy nie powinni używać AI tylko do wyłapywania literówek w nagłówkach. Powinni jej używać do budowania interaktywnych wizualizacji, testowania argumentów pod stresem i naprawdę rozumienia skomplikowanych kwestii, o których piszą.

A co z samym pisaniem? Zapewne spotkałeś się ze zwykłą odpowiedzią na każdego, kto używa AI w pisaniu: „Dlaczego miałbym czytać artykuł, a nie prompt, który go spowodował?” Brzmi rozsądnie, prawda? Cóż, nie, jeśli pomyślisz o tym chwilę.

Po co jeść danie zamiast czytać listę zakupów? Po co patrzeć na wykres zamiast na skrypt ggplot? Po co czytać książkę zamiast notatek autora? Prompt nie daje nowej wiedzy. Wynik tak. Na tym polega cały sens. Jak argumentowałem w Części II, różne osoby z różną wiedzą, danymi i kontekstem (manifestującymi się w ich plikach claude.md) produkują zupełnie różne wyniki z tego samego promptu. To kwestia umiejętności.

Rozumiem: może dziwnie czuć się spędzać więcej czasu na czytaniu czegoś, niż autor spędził na tworzeniu. Ale już tu byliśmy. Wykres, który zajął sekundy do wygenerowania w R, może wymagać minut do uważnego odczytania. Nikt nie domaga się ani nie fantazjuje o samym kodzie zamiast wykresu. Oceniają wykres i to, co mówi—nową wiedzę niedostępną wcześniej.

26. LLM mogą rzeczywiście produkować nową wiedzę.

Jak niedawno udokumentował John Burn-Murdoch, chatboty AI konsekwentnie kierowały użytkowników ku consensusowi ekspertów—odwrotność tego, co robi media społecznościowe. Narzędzia nie tylko pomagają ci pisać lepiej. Używane aktywnie, pomagają myśleć staranniej.7 W ten sposób LLM mogą nawet odwrócić wzrost populizmu. Ale weryfikacja faktów to nie to samo co produkowanie nowej wiedzy.

Zanim zapytamy, czy LLM potrafią produkować naprawdę nowe idee (istnieją dobre przykłady tego), powinniśmy zapytać, ilu ludzi to robi. Większość naukowców spędza kariery na nieznacznych wariacjach recombinowania istniejących idei, stosując te same metody do nieco innych zbiorów danych, produkując przyrostowe prace, których nikt poza ich poddziedziny nigdy nie przeczyta. Oryginalne myślenie jest niezwykle trudne i rzadkie w każdym pokoleniu. Nie mówię tego jako zniewagę wobec żadnego z moich kolegów (ani siebie). Ale poprzeczka, którą LLM muszą przekroczyć, jest niższa, niż chcemy przyznać.8

Mój przyjaciel Robert Kubinec, znakomity metodolog polityczny i wydany autor fikcji9 na University of South Carolina, wydaje się dość sceptyczny wobec większości szumu wokół AI. Argumentuje, że „LLM nigdy nie tworzą wiedzy, [która] istnieje tylko w ludzkich mózgach. Mogą jedynie porównywać jeden zestaw wiedzy z innym”. Szanuję Boba, więc jest w porządku, jeśli się nie zgadzamy. Moja odpowiedź: Filozoficzne pytanie o samoświadomość jest realne, ale jest ortogonalne wobec praktycznego. Niezależnie od tego, czy model „rozumie” cokolwiek, wynik albo zawiera nowe informacje użyteczne dla ludzi, albo nie.10

Najbardziej sugestywnym niedawnym przykładem jest Claude Mythos, nowy model graniczny Anthropic. W ciągu kilku tygodni testów wykrył tysiące wcześniej nieznanych luk bezpieczeństwa w głównych systemach operacyjnych i przeglądarkach, w tym jedną, która przez 27 lat umykała uwadze. Jakkolwiek chcesz to nazwać, „porównywanie jednego zestawu wiedzy z innym” tego nie wyczerpuje.

Najlepsze teorie konceptualne w naukach społecznych są już recombinacjami istniejących idei. Anthony Downs zbudował swoją teorię racjonalnego wyboru, przeszczepiając mikroekonomiczną maksymalizację użyteczności do głosowania, dosłownie tytułując swą książkę An Economic Theory of Democracy. Baumgartner i Jones zapożyczyli równowagę przerywaną z biologii ewolucyjnej i zastosowali ją do polityki publicznej. Analiza sieci społecznych w całości importowała teorię grafów z matematyki. Axelrod połączył dylemat więźnia z selekcją ewolucyjnej sprawności. Alexander Wendt poszedł dalej i zastosował teorię kwantową do stosunków międzynarodowych w Quantum Mind and Social Science—krok, który wielu uznało (słusznie) za absurdalny, ale który Cambridge University Press i tak opublikowało. Nauki społeczne rzadko wymyślają od zera. Tłumaczą między dziedzinami, a tłumaczenie jest wkładem teoretycznym.

To jest strukturalnie identyczne z tym, co robią LLM: recombinują wzorce i koncepty w różnych kontekstach. Czasem wynik jest nonsensem. Czasem jest produktywny. To samo dotyczy ludzkiej recombinacji. Kwantowe stosunki międzynarodowe Wendta były krytykowane jako metafora udająca fizykę, ale jak wspomniano powyżej, Cambridge University Press to opublikowało. Jeśli to liczy się jako produkcja wiedzy, trudno zrozumieć, dlaczego LLM-generowane recombinacje nie miałyby się liczyć.

Warto zaznaczyć, że Bob przyznał praktyczny punkt, zachowując filozoficzny: „pytanie jest, jak używać tej zdolności do rozwijania wiedzy”. Dokładnie. Jak mówiłem w Części I, przestańcie debatować, czy LLM „naprawdę rozumieją”, podczas gdy osoby z największą stawką już używają tych narzędzi do poprawy swojej pracy.

27. Dla krytyków, model mentalny użytkownika AI tkwi w 2023 roku—a to epoka wstecz.

Pamiętajmy, jak w to wpadliśmy. Studenci entuzjastycznie zaadaptowali AI przed swoimi profesorami, używając pierwszych dostępnych publicznie, bezpłatnych modeli jak ChatGPT 3.5. W efekcie wielu profesorów i intelektualistów nadal wyobraża sobie typowego użytkownika AI jako studenta próbującego oszukiwać w eseju, albo asystenta polegającego na AI w składaniu slopu. To może nadal opisywać wiele przypadkowego użycia AI na świecie. Nie opisuje to sposobu, w jaki czołowi badacze w większości dziedzin pracują z tymi narzędziami, ani jak naprawdę działa ktokolwiek próbujący używać AI odpowiedzialnie i świadomie.

Stefan Schubert najlepiej to uchwycił: niedoceniamy racjonalności innych ludzi, zakładając, że stosują nowe narzędzia znacznie bardziej bezrefleksyjnie, niż naprawdę to robią. Istnieje ogromna przestrzeń między proszeniem ChatGPT o napisanie całej pracy a samodzielnym zapisywaniem każdego słowa. Kiedy piszesz „samodzielnie”, już używasz skrótów. Nie robisz głębokiego researchu każdego cytowania. Googlasz statystykę i ufasz nagłówkowi. Przeglądasz streszczenie i cytujesz artykuł. Jeśli masz zasoby, zlecasz weryfikację asystentowi badawczemu lub weryfikatorowi faktów. AI pozwala ci robić wiele z tego w bardziej systematyczny, zautomatyzowany i tańszy sposób.

Jak wielu, Derek Thompson słusznie uważa, że pisanie jest myśleniem i że zlecanie pełnego procesu pisania AI pozostawia umysł pusty. Jednak choć wiele pisania jest myśleniem, myślenie nie jest wyłącznie pisaniem. Tworzenie sztuki jest myśleniem. Mówienie też jest myśleniem. Jak argumentuje Dina Pisareva, tworzenie promptów jest też myśleniem, jeśli masz dobrego partnera sokratejskiego po drugiej stronie wymiany.

Thompson przyznaje też, że wszelkie pisanie zawsze polegało na sięganiu poza umysł autora po idee, fakty, redakcję i weryfikację. Granica między prawowitą pomocą a nielegalnym zlecaniem zawsze była rozmyta, a AI tej rozmytości nie stworzyła. Po prostu uczyniła ją niemożliwą do zignorowania. Własny wniosek Thompsona: „Powinniśmy być szczerzy i otwarci na tę rozmytość, zamiast ogłaszać każdego z otwartym oknem Claude’a częścią slopclass”.

Gdzie to pozostawia kwestię ujawniania? Wiele porządnych osób i czołowych czasopism akademickich proponuje pełne ujawnianie użycia AI jako rozwiązanie. Ale ujawnianie nie jest trwałe w sensie teoriogrywowym: ujawniający ponoszą koszty reputacyjne, podczas gdy tajni użytkownicy korzystają za darmo, więc równowaga skłania ku nieujawnianiu. Osoby takie jak Megan McArdle i ja jesteśmy żywym dowodem tego problemu. I lepsze ujęcie, jak formułuje to Ryan Briggs, polega na tym, że AI uzupełnia ekspertyzę: zautomatyzowane RA sprawdzające twoją pracę, formalizujące argumenty w trakcie, zbierające dane na żądanie. To mnożnik pozwalający zdolnym ludziom myśleć lepiej i szybciej.

Moje odczucie jest takie, że jedynym przypadkiem, gdzie ujawnianie jest naprawdę należne, jest sytuacja, gdy odbiorca ma uzasadnione oczekiwanie pracy w pełni wytworzonej przez człowieka i to oczekiwanie stanowi część tego, za co płaci. Najlepsza analogia to koncert na żywo w wąskim przypadku pisania osobistego lub twórczego: jeśli przychodzisz oczekując występu na żywo, a artysta śpiewa z playbacku, to jest uzasadniona skarga. Dokładniej: ujawnianie jest należne, gdy brak ujawniania wprowadziłby odbiorców w błąd co do tego, co otrzymują. Dziennikarz publikujący pod byline obiecuje odpowiedzialność i oryginalność, nie proweniencję naciśniętych klawiszy. Memuarysta obiecuje jedno i drugie. Test polega na tym, za co autor stawia swoje imię, nie na tym, czy użyto narzędzia.

Ale nauka i dziennikarstwo to nie spektakle na żywo. Chodzi w nich o odkrywanie i dzielenie się nową wiedzą. Nikt nie ujawnia, że użył sprawdzania pisowni, asystentów badawczych czy Google. Normy dla pisania twórczego i sztuki będą inne—słusznie, bo tam odbiorcy płacą częściowo za ludzkie doświadczenie tworzenia. Humanistyka prawdopodobnie wyląduje gdzieś pośrodku przez jakiś długotrwały i sporny proces, z wieloma zerwanym przyjaźniami. Ale dla badań i dziennikarstwa „ujawnij wszystko” nie prowadzi nas tam, gdzie musimy dotrzeć. Czytelnicy powinni zważać na trafność i czy autor bierze pełną odpowiedzialność za to, co jest na stronie. Proweniencja jest znacznie słabszym sygnałem niż jedno lub drugie.

28. Nikt nic nie wie, łącznie ze mną. To jest w porządku—razem to rozgryziemy.

Początkowo unikałem rozmów z dziennikarzami o AI, bo w żadnym sensownym sensie nie jestem w tej dziedzinie ekspertem. Coraz bardziej zdaję sobie jednak sprawę, że nikt nie jest ekspertem od czegokolwiek, czym to wszystko jest, naprawdę, i czekanie na pojawienie się takiej osoby to sposób na skończyć bez żadnych norm. Nadal unikam udzielania jakichkolwiek porad poza zainstalowaniem Claude Code (lub wybranego przez ciebie agentycznego narzędzia) i rozmową z nim, by rozwiązać bieżący problem.

Jak zwykle, Arthur Spirling był w tej kwestii bezpośredni: konta akademicko-AI, które nieustannie oferują „porady” kolegom i doktorantom, jakby byli w laboratoriach tworzących modele, są nudne. Są kibicami, jak reszta z nas.11 Nawet ludzie w laboratoriach nie mają pojęcia, jak dobre będą modele w perspektywie dłuższej niż kilka miesięcy.

Jesteśmy więc w niezręcznej sytuacji: ktoś musi zacząć ustanawiać normy nowego środowiska pracy, a ludzie to robiący będą nieuchronnie ludźmi, którzy nie w pełni rozumieją, dla czego tworzą normy. To jest dziwne i niewygodne. Tak właśnie prawdopodobnie działały większość innych przejść instytucjonalnych—tyle że w znacznie wolniejszym tempie.

Przeszliśmy przez wersję tego, co wydaje się wiecznością temu, gdy profesorowie musieli zaakceptować, że pełne i skrupulatne pilnowanie użycia AI przez studentów nie jest ani produktywne, ani możliwe. To samo dotyczy teraz badaczy. Możesz audytować części, które naprawdę mają znaczenie—jak kod replikacji—a LLM już to ułatwiają. Proweniencja to jedyna rzecz, której nie możesz audytować, i to jedyna rzecz, na której i tak nie powinniśmy marnować energii. Musisz podążać za bodźcami i budować systemy zapewniające dobre użycie narzędzi, a nie udawać, że w ogóle nie są używane.

Przy okazji, w kwestii nauczania: byłem na urlopie, więc tutaj też unikałem porad. Biorąc pod uwagę liczne pytania, jakie otrzymałem, jestem bardziej pesymistyczny co do wpływu AI na nauczanie niż na badania. Na przykład, choć otwarcie i szeroko używam AI w badaniach i pisaniu, planuję zakazać wszelkich urządzeń elektronicznych na moich zajęciach merytorycznych i przywrócić pisemne i ustne egzaminy na miejscu.

To nie są sprzeczne stanowiska. Sala wykładowa jest dokładnie miejscem, gdzie studenci muszą budować umiejętności kognitywne, które czynią późniejszą współpracę z AI produktywną. Nie możesz sensownie kierować narzędziem AI, jeśli nigdy nie nauczyłeś się myśleć bez niego. Troska o zanik umiejętności z Części II jest tu najbardziej zasadna: studenci muszą zinternalizować podstawy, zanim je outsourcują. Badania to miejsce, gdzie używasz najlepszych dostępnych narzędzi do osiągnięcia wartościowego wyniku. Nauczanie to miejsce, gdzie zapewniasz, że następne pokolenie faktycznie potrafi z tych narzędzi dobrze korzystać.12

29. Najlepsza praca powstaje, gdy ludzie i AI współpracują.

Nadal widzę wielu ludzi deklarujących, że nie będą używać AI w pisaniu. To mniej więcej równie sensowne, co deklarowanie, że nie będzie się przyjmować pomocy od asystentów badawczych ani współautorów. Deklaruję więc coś odwrotnego: będę używać najnowszych LLM—i wszelkich innych dostępnych narzędzi czy ludzkich współautorów—by jak najlepiej poprawić swoje badania lub sposób ich komunikowania. W ten sposób, jeśli moje imię jest na czymś podpisane, możesz być pewien, że odzwierciedla to mój własny najlepszy osąd.

Wielu naukowców, szczególnie w humanistyce, zdaje się nadal wierzyć, że ma znaczenie, ile czasu spędzasz na swojej pracy. Ale ludowa teoria wartości pracy jest błędna w ekonomii i jest błędna tutaj. Jeśli jesteś dziwakiem, który chce latami ręcznie uruchamiać wszystkie sprawdziany solidności z macierzami odwracanymi ręcznie zamiast kilku poleceń R, albo ręcznie tłumaczyć lub przepisywać oryginalne manuskrypty—twoja sprawa. Nie obchodziło mnie zbytnio, czy ci profesorowie studiów międzynarodowych na ISA spędzili 10 czy 100 godzin na swoich ludzkich slopowych prezentacjach. Praca albo jest dobra, albo nie.

Niemniej jednak warto ustanowić kilka norm. Kiedy piszesz „wierzę” lub „czuję”, to pierwszoosobowe sformułowanie powinno być naprawdę twoje. Zaimek „ja” niesie implicite obietnicę ludzkiego głosu za nim. Twierdzenie faktyczne—jak właściwa nazwa NATO—nie obchodzi kto je wpisał. Ale osobiste przekonanie owszem. Pomyśl o koncercie na żywo: publiczność płaci za prawdziwy występ, nie za playback. Kiedy używasz „ja”, czytelnik ma prawo oczekiwać, że masz to na myśli. Nie wymaga to dosłownego wpisywania (ani dyktowania) każdego słowa. Możesz kierować modelem, pracować ze swoich notatek i uważnie je przeczytać, ale wymaga to, by przekonanie było twoje.

Ten tekst, na przykład, był otwarcie i z dumą napisany przy użyciu iteracyjnej rozmowy z Claude Code, opartej na moich oryginalnych pomysłach, rozmowach z rówieśnikami i użytecznych sugestiach ludzkich kolegów akademickich i pozaakademickich.13 Część I eksperymentowała z możliwościami AI bez ludzkiej redakcji. Część II była pisana w 100% ludzkim głosem. Część III, którą czytasz, łączy mój głos z możliwościami AI, zamykając krąg. Pozwolę wam zdecydować, która była najlepsza.

Gdzie więc ludzie zachowują przewagę? Jak argumentuje Yiqing Xu, prawdopodobnie w otwartych środowiskach, gdzie dane treningowe jeszcze nie istnieją, i w zadaniach wymagających bezpośredniej interakcji z człowiekiem. To może się wkrótce zmienić. Ale wybraliśmy tę karierę, bo sens daje nam rozgryzanie rzeczy, nie tylko dlatego, że nadal jesteśmy w tym lepsi. Dlatego nie widzę żadnej sprzeczności w outsourcowaniu większości żmudnych czynności do AI (lub RA, jeśli masz tradycyjne wartości) i skupianiu się na tym, co daje nam największy sens—wymyślaniu ważnych pytań o świat i odpowiadaniu na nie najlepszymi dostępnymi narzędziami.

30. Prawdziwe ryzyko w nauce to ludzki slop z prędkością AI. Możemy temu jeszcze zapobiec.

AI wzmacnia to, co do niej wnosisz. Wnieś prawdziwą ciekawość i trudne pytania, a AI pomoże ci stworzyć coś wartego przeczytania. Nie wnoś nic, a stworzysz nic szybciej.

Jest jednak powód do optymizmu. Te same odkrycia Nature, które ujawniły, jak bardzo zepsuta jest reprodukowalność, pokazały też, że czasopisma z obowiązkowym udostępnianiem danych i kodu miały znacząco wyższe wskaźniki reprodukowalności. AI może już przyspieszyć ten proces: nic poza inercją nie stoi na przeszkodzie, by redaktorzy czasopism wprowadzili automatyczne sprawdzanie reprodukowalności i obowiązkową weryfikację kodu jako warunek składania tekstów. Systemy te można skonfigurować jako quasi-deterministyczne, z bardzo małą marginesem błędu, a autorzy zawsze mogą zakwestionować automatyczne odrzucenie, jeśli uważają, że wewnętrzny przepływ pracy agentycznego AI nie zdołał ustalić, jak reprodukować ich kod.

Ambitniej: AI obniża koszt prowadzenia pracy na dużą skalę, intensywnie opartej na danych, która kiedyś wymagała bycia Rajem Chetty z zespołem 30 asystentów badawczych i dostępem do każdego administracyjnego zestawu danych w kraju, albo bycia Daronem Acemoglu… z ołówkiem i papierem. Młody uczony z Codexem może teraz podejmować projekty, które logistycznie byłyby niemożliwe pięć lat temu. Poprzeczka dla tego, co jest publikowane, powinna rosnąć, bo poprzeczka dla tego, co można wyprodukować, już wzrosła.

Standard się nie zmienił: jeśli podpisujesz coś swoim imieniem, stoisz za tym. Oceniaj jakość wyniku, nie procesu. Rozmowa o AI slopie odwraca uwagę od trudniejszego pytania, które powinniśmy byli zadawać na długo przed pojawieniem się chatbotów: dlaczego przez tak długi czas tolerowaliśmy tyle ludzkiego slopu?

***

Moim celem, gdy publikowałem Część I, było proste: wprowadzenie rozmowy, która już toczyła się za zamkniętymi drzwiami i w wiadomościach prywatnych, do sfery publicznej. Nadal słyszę to samo od kolegów: „Alex, wiemy, że używasz AI, my też to robimy, ale czy nie mógłbyś po prostu o tym milczeć?”

Rozumiem obawę, że AI będzie używana nieodpowiedzialnie, produkując więcej slopu niż mu zapobiega. Ale jeśli się nad tym zastanowić, „milcz o tym” to po prostu opowiadanie się za powszechną hipokryzją jako normą zawodową. Chciałem, by niepewność, którą wszyscy odczuwają co do swoich przepływów pracy i przyszłości, osiągnęła bardziej stabilną równowagę. To wymaga szczerej rozmowy, a nie ciszy.

I już to się dzieje. Emily Oster niedawno podzieliła się radami Isaiahy Andrewsa dotyczącymi AI dla doktorantów MIT w ekonomii, nazywając to czymś, co powinno trafić do wszystkich roczników doktoranckich. Jak zauważył Andy Hall, najważniejszą rzeczą w tych radach nie były żadne konkretne sugestie same w sobie, ale wysłanie wyraźnego sygnału przez prominentnych pracowników naukowych: to jest coś, co musisz traktować poważnie. Nawet Dylan Matthews, jeden z najbardziej refleksyjnych ludzi w dziennikarstwie, niedawno przyznał, że zwolennicy AI mieli rację wiele razy.

Zmiana jest realna. Naukowcy są już w połowie przebudzeni i nie cofną się. Aspirujący doktoranci i młodzi uczeni powinni postępować ostrożnie, ale w pełni embracować uczenie się i używanie narzędzi AI. Uczeni, intelektualiści i pisarze odmawiający zaangażowania nie zostaną nagrodzeni za swą czystość. Zostaną po prostu przelicytowani przez kolegów przynoszących ten sam intelektualny rygor, tę samą ciekawość i lepsze narzędzia.

Powinienem przyznać, że łącznie te dwa posty stały się najczęściej czytaną rzeczą, jaką kiedykolwiek napisałem (z Claude’em lub bez niego). Ludzie na konferencjach dotyczących imigracji lub jakichkolwiek innych, nie mówiąc o administratorach uniwersyteckich z całego kraju, teraz proszą mnie o porady dotyczące AI zamiast o opinie na temat imigracji lub nauk politycznych. Mówi to coś o tym, jak poważnie traktujemy pewne rzeczy w tej dziedzinie, a także że powinienem zacząć pobierać więcej za prelekcje i konsulting. ↩

Nie chcę niesprawiedliwie wyróżniać ISA. Organizatorzy pracowali w realnych ograniczeniach, na konferencji było wiele świetnych paneli i poważnych uczonych, a gdzie indziej pisałem o konkretnych sposobach ulepszenia konferencji akademickich. ↩

To chyba twierdzenie, które spotkało się z największą reakcją zwrotną od pierwszych czytelników tego tekstu. Niektórzy argumentują, że moje użycie słowa „slop” rozciąga pojęcie zbyt daleko—że AI slop (nadprodukowany, dopracowany, ale pusty) i złe prace akademickie (niedbałe, niedopracowane) to różne tryby porażki. Normalnie szczerze abhoruję rozciąganie pojęć w piśmiennictwie naukowym, ale naprawdę nie sądzę, żeby to tu miało miejsce. To, co widziałem na ISA, to nadprodukowane, bezsensowne prace, które wyglądały naukowo, ale nic nie wnosiły do ludzkiej wiedzy. To jest „slop” w każdym sensie tego słowa. ↩

Mogę zaświadczyć, że wiele cytowań moich własnych prac było twórczymi reinterpretacjami tego, co faktycznie stwierdziłem: wyniki uproszczone, wnioski odwrócone—co niemal na pewno wskazuje, że cytujący nie czytali moich prac. ↩

„Stochastyczna papuga” pochodzi z artykułu z 2021 roku współautorstwa językoznawczyni Emily Bender, argumentującego, że duże modele językowe produkują tekst, przewidując prawdopodobne sekwencje słów bez rozumienia. ↩

Dean W. Ball idzie jeszcze dalej i argumentuje, że znaczna część lewicowego zaprzeczania AI opiera się na światopoglądzie, w którym przemysł technologiczny składa się z „płytkich głupców”, których osiągnięcia są zawsze powierzchowne, zawsze oparte na jakiejś wielkiej kradzieży. Ta heurystyka mogła działać w przypadku kryptowalut. Nie działa w przypadku narzędzi, których miliony badaczy i pisarzy po cichu używają do wykonywania lepszej pracy. ↩

Mówię „używane aktywnie”, bo istnieją realne dowody, że pasywne, bezkrytyczne poleganie na AI może osłabiać umiejętności krytycznego myślenia, szczególnie w przypadku rutynowych zadań. To jest realna obawa i dlatego poniżej argumentuję, że sala wykładowa to miejsce, gdzie studenci muszą budować podstawy, zanim je outsourcują. ↩

Jak Hollis Robbins argumentowała rok temu, jedynymi naukowcami, którzy zachowają wartość w erze AI, są ci pracujący na granicach wiedzy. Im więcej czasu mija, tym mniej szokujący wydaje się ten argument. ↩

Polecam sprawdzić the Bayesian Hitman. Na pewno wstrząśnie waszymi priorytetami. ↩

Jak Alison Gopnik i współpracownicy niedawno argumentowali w Science, LLM najlepiej rozumieć jako technologie kulturowe—jak pismo, druk i biblioteki—czyli narzędzia umożliwiające nowe formy produkcji wiedzy, nawet jeśli same nie „myślą”. ↩

Wyjątkiem potwierdzającym regułę są Aniket Panjwani i Scott Cunningham, którzy przez miesiące publikowali szczegółowe, bezpośrednie relacje z tego, jak faktycznie wygląda prowadzenie badań z Claude Code. Przynajmniej dla mnie tego rodzaju materiały były naprawdę użyteczne i instrumentalne w wydaniu mojej serii o AI. ↩

Jest tu ukryta, zasadna obawa: doktoranci próbujący nauczyć się podstaw teraz konkurują o miejsce w czasopismach z profesorami posiadającymi legiony agentów AI. To jest realne i dlatego odpowiedź w nauczaniu to nie „zakazać AI na zawsze”. Odpowiedzią jest rusztowanie—najpierw naucz się myśleć bez narzędzia, potem używaj go z rozeznaniem. ↩

Jestem szczególnie wdzięczny Stevenowi Adlerowi, Ryanowi Briggsowi, Tinie Marsh Dalton, Joshowi Gellersowi, Jimmy Alfonso Liconowi, Igorowi Logvinence, Ilii Murtazashvilemu, Kyle’owi Saundersowi, Dinie Pisarevej, Quinnowi Que, Benowi Radfordowi, Mike’owi Riggsowi, Hollis Robbins, Jimowi Walshowi, Seanowi Westwoodowi, Yiqingowi Xu i Emmie Zhang za ich pomocne sugestie i reakcję zwrotną. ↩